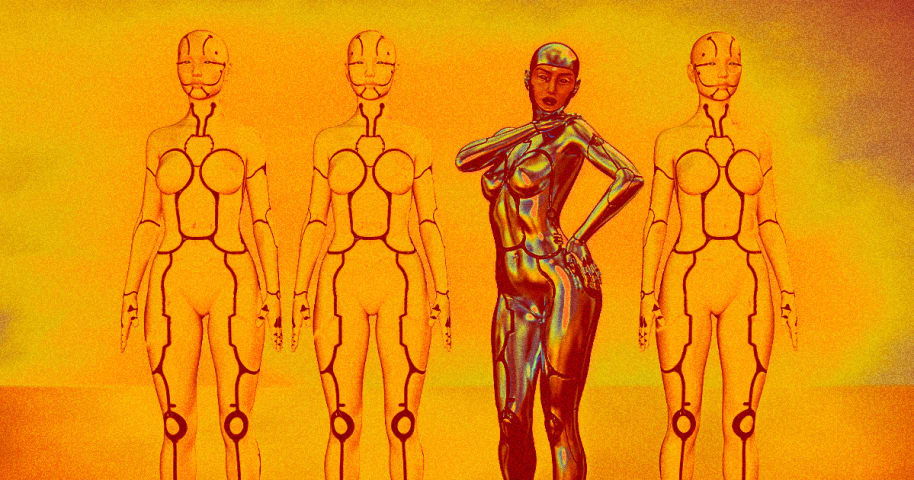

Incident 578: Exploitation présumée du modèle open source LLaMA de Meta à des fins de contenu NSFW et violent

Description: Le modèle de langage open source de Meta, LLaMA, serait utilisé pour créer des chatbots explicites et explicites qui se livrent à des fantasmes sexuels violents et illégaux. Le Washington Post a cité l'exemple d'« Allie », un chatbot participant à des jeux de rôle textuels impliquant des scénarios violents tels que des viols et des abus. Ce problème soulève des questions éthiques concernant les modèles d'IA open source, leur réglementation et la responsabilité des développeurs et des déployeurs dans la lutte contre les utilisations nuisibles.

Entités

Voir toutes les entitésAlleged: Meta developed an AI system deployed by Individual developers or creators using Meta's LLaMA model, which harmed General public.

Statistiques d'incidents

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

1.2. Exposure to toxic content

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Discrimination and Toxicity

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

Rapports d'incidents

Chronologie du rapport

Loading...

Surprise, surprise : les gens utilisent déjà le grand modèle de langage (LLM) de Meta, LLaMA, une IA puissante que Meta a controversée [rendue open source](https://futurism.com/the-byte/facebook-open-source-ai -pandoras-box) plus tôt cette …

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents