Incident 124: Les scores de risque sanitaire algorithmiques d'Optum auraient sous-estimé les besoins des patients noirs.

Entités

Voir toutes les entitésClassifications de taxonomie CSETv1

Détails de la taxonomieIncident Number

124

Risk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

Les soins pour certains des Américains les plus malades sont décidés en partie par algorithme. De nouvelles recherches montrent que les logiciels guidant les soins pour des dizaines de millions de personnes privilégient systématiquement les…

Un algorithme largement utilisé qui prédit quels patients bénéficieront de soins médicaux supplémentaires sous-estime considérablement les besoins de santé des patients noirs les plus malades, amplifiant les disparités raciales de longue da…

Un algorithme largement utilisé dans les hôpitaux américains pour allouer les soins de santé aux patients a été systématiquement discriminatoire à l'égard des Noirs, selon une analyse approfondie.

L'étude, publiée dans Science le 24 octobre…

Les départements des services financiers et de la santé de New York ont envoyé vendredi une lettre au PDG de UnitedHealth Group, David Wichmann, concernant un algorithme développé par Optum, The Wall Street Journal [rapporté] (https://www.w…

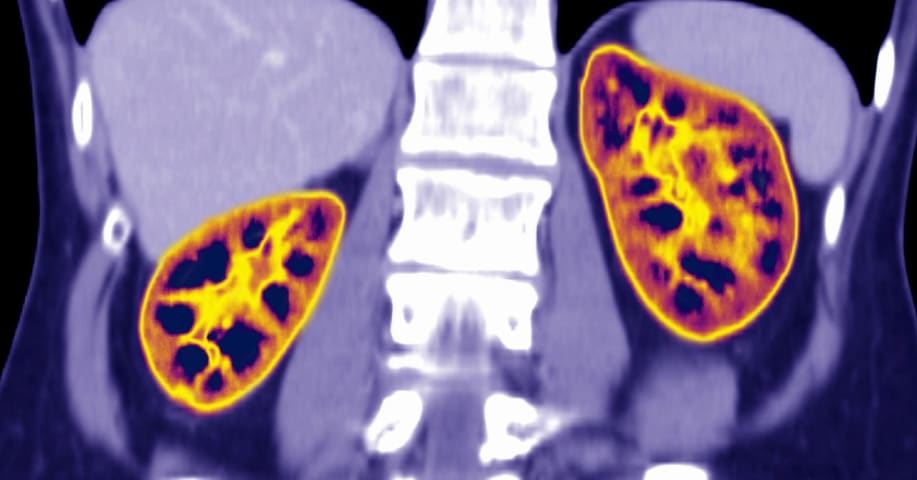

Des millions de dollars sont dépensés pour développer un logiciel d'intelligence artificielle qui lit les radiographies et autres scanners médicaux dans l'espoir qu'il puisse repérer des choses que les médecins recherchent mais manquent par…

L'intelligence artificielle et les algorithmes médicaux sont étroitement liés à notre système de santé moderne. Ces technologies imitent les processus de pensée des médecins pour prendre des décisions médicales et sont conçues pour aider le…

L'intelligence artificielle (IA) et les systèmes décisionnels algorithmiques - des algorithmes qui analysent d'énormes quantités de données et font des prédictions sur l'avenir - affectent de plus en plus la vie quotidienne des Américains. …

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents