Incident 592: La reconnaissance faciale identifie une femme enceinte de manière erronée, ce qui entraîne une fausse arrestation à Détroit

Outils

Entités

Voir toutes les entitésStatistiques d'incidents

Risk Subdomain

1.3. Unequal performance across groups

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

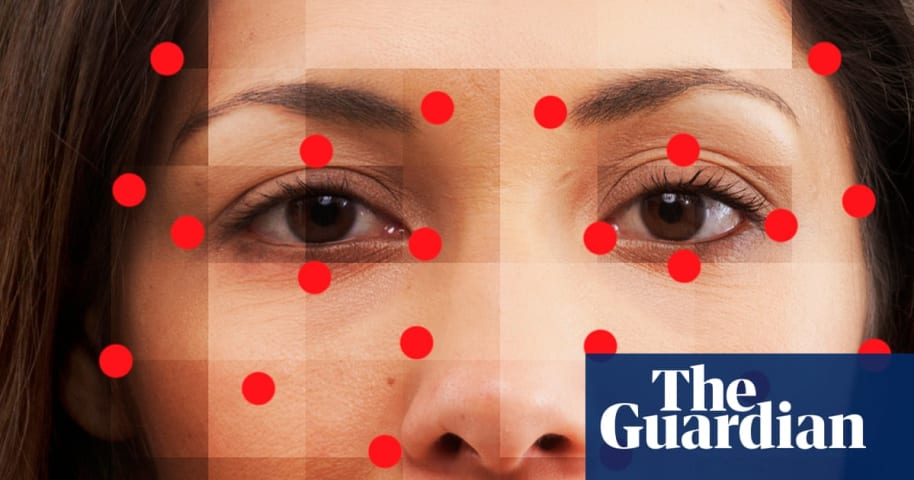

Une femme de Détroit poursuit la ville et un détective de police après avoir été faussement arrêtée en raison de la technologie de reconnaissance faciale alors qu'elle était enceinte de huit mois, selon des documents judiciaires.

Porcha Woo…

Porcha Woodruff était enceinte de huit mois lorsque la police de Détroit, dans le Michigan, est venue l'arrêter pour vol de voiture et vol. Elle préparait ses deux enfants pour l'école lorsque six policiers ont frappé à sa porte et lui ont …

In January 2020, Robert Williams spent 30 hours in a Detroit jail because facial recognition technology suggested he was a criminal. The match was wrong, and Mr. Williams sued.

On Friday, as part of a legal settlement over his wrongful arre…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents