Incident 538: Un professeur de l'université Texas A&M a utilisé ChatGPT pour détecter la génération de texte par l'IA dans les soumissions des étudiants.

Outils

Entités

Voir toutes les entitésStatistiques d'incidents

Risk Subdomain

7.3. Lack of capability or robustness

Risk Domain

- AI system safety, failures, and limitations

Entity

Human

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

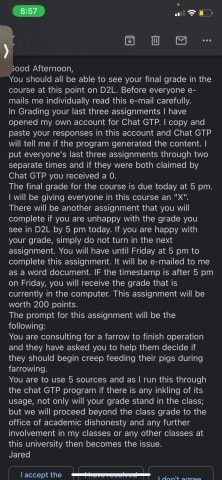

** Le professeur de commerce Texas A&M échoue à toute une classe de seniors les empêchant d'obtenir leur diplôme - affirmant qu'ils utilisent tous "Chat GTP" **

Le professeur a laissé des réponses à plusieurs étudiants notant des logiciels …

Un certain nombre de personnes âgées de la Texas A&M University–Commerce qui ont déjà foulé la scène à l'obtention du diplôme cette année se sont vu temporairement refuser leur diplôme après qu'un professeur ait mal utilisé AI logiciel pou…

Texas A&M University–Commerce a déclaré qu'elle enquêtait après qu'une capture d'écran du courrier électronique d'un instructeur – dans lequel il accusait les étudiants d'avoir utilisé l'intelligence artificielle lors de leurs derniers devo…

"Je ne noterai pas cette merde de chat Gpt", a écrit Jared Mumm, professeur de sciences agricoles et de ressources naturelles à la Texas A&M University–Commerce, à l'un de ses étudiants cette semaine, [selon](https://www.washingtonpost.com …

Récemment, M. Jared Mumm - professeur à l'Université Texas A&M (États-Unis), a mis l'essai de fin d'études de l'étudiant dans ChatGPT pour vérification. Le but de ce travail est de voir quels étudiants utilisent le chatbot d'OpenAI pour fai…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents