Incident 363: La modération automatisée de Facebook a signalé par erreur le nom de Landmark comme offensant

Description: Le système automatisé de Facebook a qualifié par erreur de misogynes les publications mettant en vedette le monument maritime Plymouth Hoe.

Entités

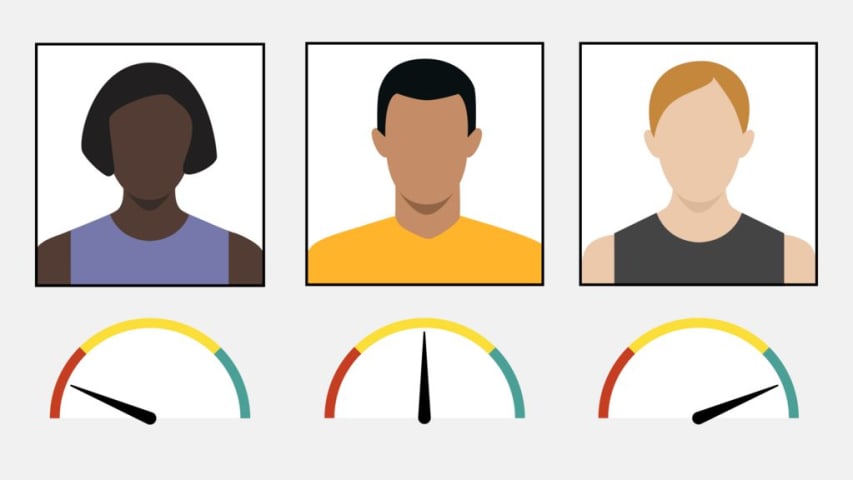

Voir toutes les entitésPrésumé : Un système d'IA développé et mis en œuvre par Facebook, a endommagé Facebook users posting about Plymouth Hoe , Facebook users in Plymouth Hoe et Plymouth Hoe residents.

Statistiques d'incidents

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

7.3. Lack of capability or robustness

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- AI system safety, failures, and limitations

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Unintentional

Rapports d'incidents

Chronologie du rapport

Loading...

Plymouth Hoe est l'un des sites les plus connus de l'histoire maritime du Royaume-Uni, l'endroit où Sir Francis Drake aurait terminé une partie de boules avant de partir combattre l'Armada espagnole.

Mais Facebook s'est retrouvé dans l'eau …

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents