Incident 282: L'algorithme de Facebook a confondu une publicité pour Onions avec un contenu à caractère sexuel

Entités

Voir toutes les entitésRisk Subdomain

7.3. Lack of capability or robustness

Risk Domain

- AI system safety, failures, and limitations

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

Les oignons les plus sexuellement provocateurs du Canada ont été retirés de Facebook après que le géant des médias sociaux a déclaré à une entreprise de produits que ses images allaient à l'encontre des directives publicitaires, a rapporté …

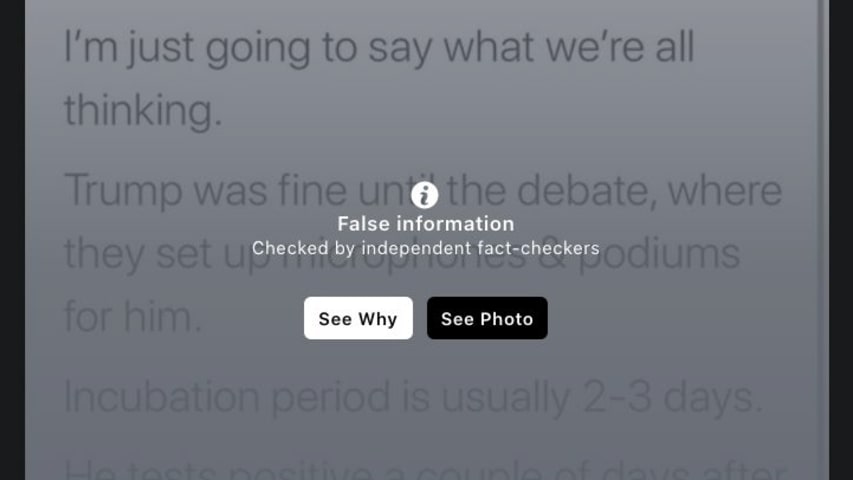

Les oignons sont-ils nus ou habillés dans leur forme naturelle ? L'intelligence artificielle (IA) de Facebook semble avoir du mal à faire la différence entre les images à connotation sexuelle faisant référence au corps humain et les légumes…

L'IA de Facebook a du mal à faire la différence entre les images sexuelles du corps humain et les légumes globulaires.

Une jardinerie de Terre-Neuve, au Canada, a reçu lundi un avis de Facebook concernant une annonce qu'elle avait télécharg…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents