Incident 281: Les algorithmes de YouTube n'ont pas réussi à supprimer les contenus illicites liés au suicide et à l'automutilation

Entités

Voir toutes les entitésClassifications de taxonomie CSETv1

Détails de la taxonomieIncident Number

281

Risk Subdomain

1.2. Exposure to toxic content

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

S'adressant à The Telegraph, une ancienne blogueuse de Tumblr, qui a demandé l'anonymat, a déclaré qu'elle devait arrêter son propre blog d'aide à la dépression et à l'anxiété après s'être retrouvée "tomber dans le terrier du lapin de conte…

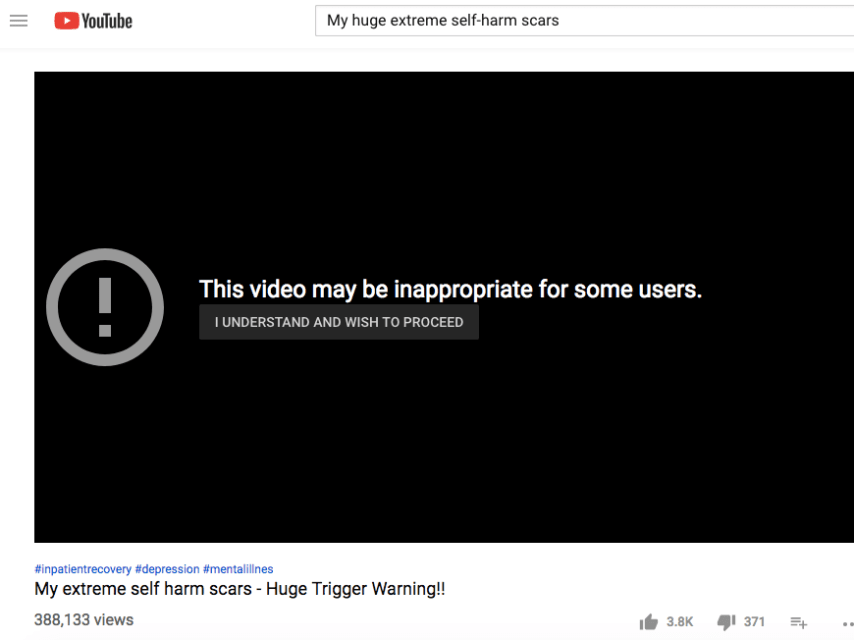

Des contenus potentiellement dangereux auraient à nouveau échappé aux algorithmes de modération sur YouTube.

Selon un rapport du Telegraph lundi, YouTube recommande des vidéos contenant des images graphiques d'automutilation aux utilisateur…

YouTube a été surpris en train de recommander des "dizaines" de vidéos graphiques relatives à l'automutilation des enfants.

L'application de partage de vidéos extrêmement populaire a été critiquée pour avoir fait la promotion de clips dange…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents