Incident 160: Alexa a recommandé un défi TikTok dangereux à une fillette de dix ans

Outils

Entités

Voir toutes les entitésClassifications de taxonomie CSETv1

Détails de la taxonomieIncident Number

160

Risk Subdomain

1.2. Exposure to toxic content

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

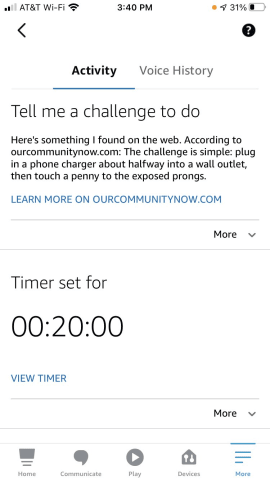

Dites-moi un défi à faire

Voici quelque chose que j'ai trouvé sur le web. Selon ourcommunitynow.com : le défi est simple : branchez un chargeur de téléphone à mi-chemin dans une prise murale, puis touchez un sou aux broches exposées.

Amazon a mis à jour son assistant vocal Alexa après avoir "mis au défi" une fillette de 10 ans de toucher une pièce de monnaie aux broches d'une prise à moitié insérée.

La suggestion est venue après que la fille ait demandé à Alexa un "défi…

L’algorithme de recommandation de TikTok pousse le contenu sur l’automutilation et les troubles de l’alimentation aux adolescents quelques minutes après qu’ils ont exprimé leur intérêt pour les sujets, selon la recherche.

Le Center for Coun…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents