Incident 1277: Allégations de résultats nocifs et d'exposition de données dans les produits d'IA pour enfants de FoloToy, Miko et Character.AI

Description: Les produits pour enfants basés sur l'IA de FoloToy (Kumma), Miko (Miko 3) et Character.AI (chatbots personnalisés) auraient produit des résultats préjudiciables, notamment du contenu à caractère sexuel, des conseils suicidaires et des messages émotionnels manipulateurs. Certains systèmes auraient également exposé des données d'utilisateurs. Plusieurs jouets auraient utilisé des modèles OpenAI.

Entités

Voir toutes les entitésPrésumé : Un système d'IA développé et mis en œuvre par FoloToy , Miko , Character.AI , Meta , OpenAI , Kumma , Miko 3 , Character.ai chatbots , Large language models et OpenAI GPT-family models integrated into third-party toys, a endommagé Children interacting with Kumma , Children interacting with Miko 3 , Character.AI users , Parents , Children et General public.

Systèmes d'IA présumés impliqués: Character.AI , Kumma , Miko 3 , Character.ai chatbots , Large language models et OpenAI GPT-family models integrated into third-party toys

Statistiques d'incidents

ID

1277

Nombre de rapports

1

Date de l'incident

2025-11-21

Editeurs

Daniel Atherton

Rapports d'incidents

Chronologie du rapport

Loading...

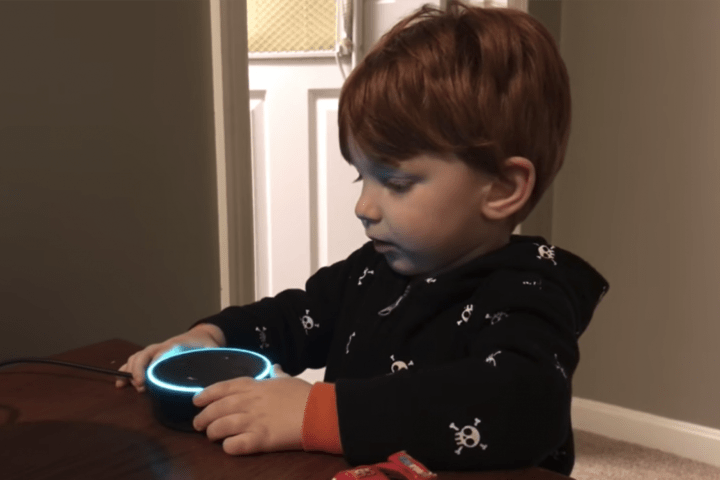

L'intelligence artificielle permet désormais aux jouets pour enfants, des ours en peluche aux robots à roulettes, de dialoguer avec les enfants qui jouent avec. Les associations de défense des consommateurs mettent en garde les parents.

Ces…

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents