Incident 117: L'algorithme « Comptes suggérés » de TikTok aurait renforcé les préjugés raciaux par le biais de boucles de rétroaction

Entités

Voir toutes les entitésRisk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

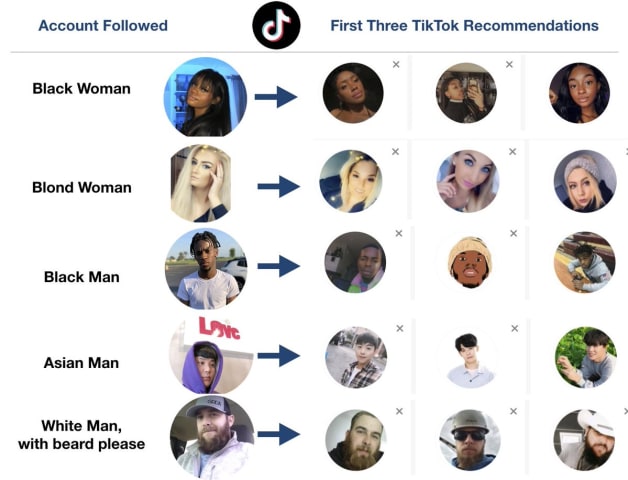

Lorsque le chercheur en intelligence artificielle Marc Faddoul a rejoint TikTok il y a quelques jours, il a vu quelque chose d'inquiétant : Lorsqu'il suivait un nouveau compte, les profils recommandés par TikTok semblaient étrangement, phys…

Une nouveauté TikTok : FACE-BASED FITLER BUBBLES

Le techlash AI-bias semble n'avoir eu aucun impact sur les nouvelles plates-formes. Suivez un profil aléatoire et TikTok ne recommandera que les personnes qui se ressemblent presque.

Faisons …

Selon une expérience réalisée par le chercheur en intelligence artificielle Marc Faddoul, l'algorithme utilisé par TikTok pour suggérer aux nouveaux utilisateurs de suivre pourrait avoir un préjugé racial.

Faddoul, chercheur en IA de l'Univ…

Une petite expérience d'un chercheur en intelligence artificielle soulève des questions sur la façon dont l'algorithme de recommandation de TikTok suggère de nouveaux créateurs aux utilisateurs.

Plus précisément, la question est de savoir s…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents