Incidente 343: Facebook, Instagram y Twitter no eliminaron de forma proactiva comentarios racistas específicos mediante sistemas automatizados

Descripción: La moderación automática de contenido de Facebook, Instagram y Twitter no eliminó de manera proactiva los comentarios y publicaciones racistas dirigidos a jugadores de fútbol negros después de la derrota en las finales, supuestamente basándose en gran medida en informes de acoso de los usuarios.

Entidades

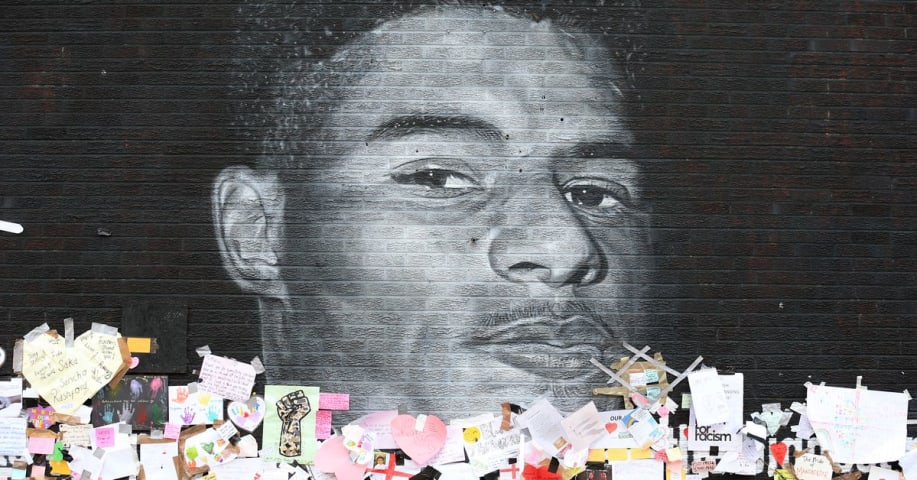

Ver todas las entidadesPresunto: un sistema de IA desarrollado e implementado por Facebook , Instagram y Twitter, perjudicó a Marcus Rashford , Jadon Sancho , Bukayo Saka , Facebook users , Instagram users y Twitter Users.

Estadísticas de incidentes

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

1.2. Exposure to toxic content

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Discrimination and Toxicity

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Unintentional

Informes del Incidente

Cronología de Informes

Loading...

No fue exactamente sorprendente que hordas de trolls en las redes sociales atacó a tres jugadores negros del equipo de fútbol de Inglaterra con comentarios racistas y emojis después de una derrota histórica el domingo 11 de julio. Lo inespe…

Loading...

Después de otro gran incidente de abuso racista en línea, dirigido a miembros del equipo de fútbol inglés, Facebook ha [proporcionado una nueva descripción general] (https://www.facebook.com/business/news/what-were-doing-to-tackle -online-h…

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents