Incidente 1013: Un hombre de Essex fue condenado a cinco años de prisión por generar y compartir pornografía deepfake de al menos 20 mujeres y un menor.

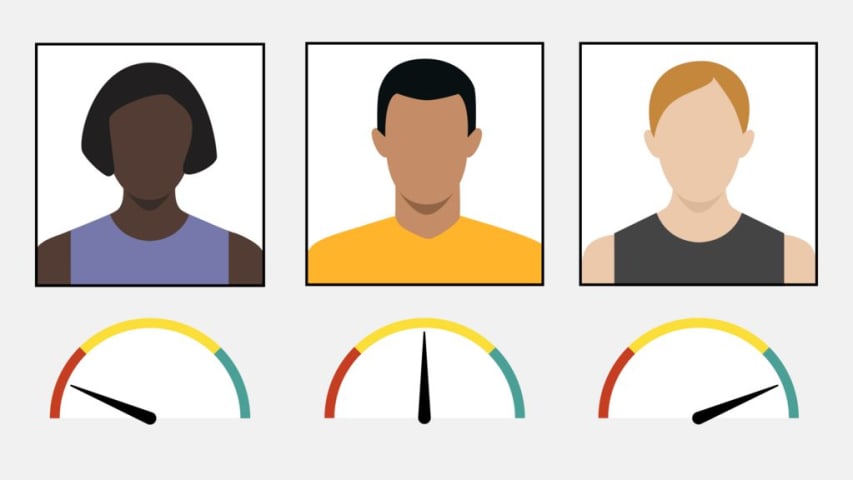

Descripción: Entre marzo de 2023 y mayo de 2024, Brandon Tyler, de Essex, utilizó IA para generar pornografía deepfake explícita de al menos 20 mujeres que conocía personalmente, incluida una joven de 16 años. Manipuló sus fotos en redes sociales y las compartió, junto con sus datos personales, en foros en línea que promovían la violencia sexual. Fue condenado a cinco años de prisión en abril de 2025 en virtud de la legislación penal del Reino Unido que prohíbe compartir deepfakes sexualmente explícitos, en lo que constituye uno de los primeros procesos judiciales importantes de este tipo.

Editor Notes: Notes on the timeline: Brandon Tyler's actions reportedly began sometime in March 2023 and continued until May 2024, which is when he was arrested. He was sentenced on April 4, 2025 (which is the incident date selected for this incident ID). It is also the date when reporting seemingly emerged for this incident.

Herramientas

Nuevo InformeNueva RespuestaDescubrirVer Historial

El Monitor de Incidentes y Riesgos de IA de la OCDE (AIM) recopila y clasifica automáticamente incidentes y riesgos relacionados con la IA en tiempo real a partir de fuentes de noticias reputadas en todo el mundo.

Entidades

Ver todas las entidadesAlleged: Unknown deepfake technology developers developed an AI system deployed by Brandon Tyler, which harmed Victims of Brandon Tyler y General public.

Sistema de IA presuntamente implicado: Unknown deepfake technology

Estadísticas de incidentes

ID

1013

Cantidad de informes

1

Fecha del Incidente

2025-04-04

Editores

Daniel Atherton

Applied Taxonomies

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

4.3. Fraud, scams, and targeted manipulation

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Malicious Actors & Misuse

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

Informes del Incidente

Cronología de Informes

Loading...

Un pervertido en línea que utilizó inteligencia artificial (IA) para crear pornografía deepfake de mujeres que conocía ha sido encarcelado durante cinco años.

Brandon Tyler, de 26 años, manipuló imágenes de redes sociales y las publicó en u…

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents