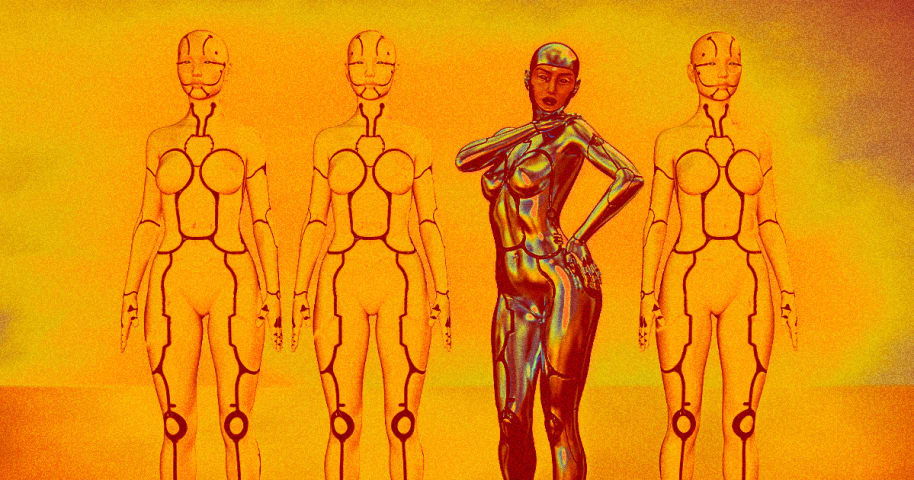

概要: Metaのオープンソース大規模言語モデルLLaMAは、暴力的または違法な性的空想に耽溺する、露骨で露骨なチャットボットの作成に利用されているとされています。ワシントン・ポスト紙は、テキストベースのロールプレイングゲームに参加するチャットボット「Allie」を例に挙げ、レイプや虐待といった暴力的なシナリオを扱ったとされています。この問題は、オープンソースAIモデル、その規制、そして有害な利用を軽減するための開発者と導入者の責任について、倫理的な問題を提起しています。

Alleged: Meta developed an AI system deployed by Individual developers or creators using Meta's LLaMA model, which harmed General public.

インシデントのステータス

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

1.2. Exposure to toxic content

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Discrimination and Toxicity

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

インシデントレポート

レポートタイムライン

Loading...

Surprise, surprise: people are already using Meta's large language model (LLM), LLaMA — a powerful AI that Meta controversially made open-source earlier this year — to create their own graphic, AI-powered sexbots, The Washington Post report…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents