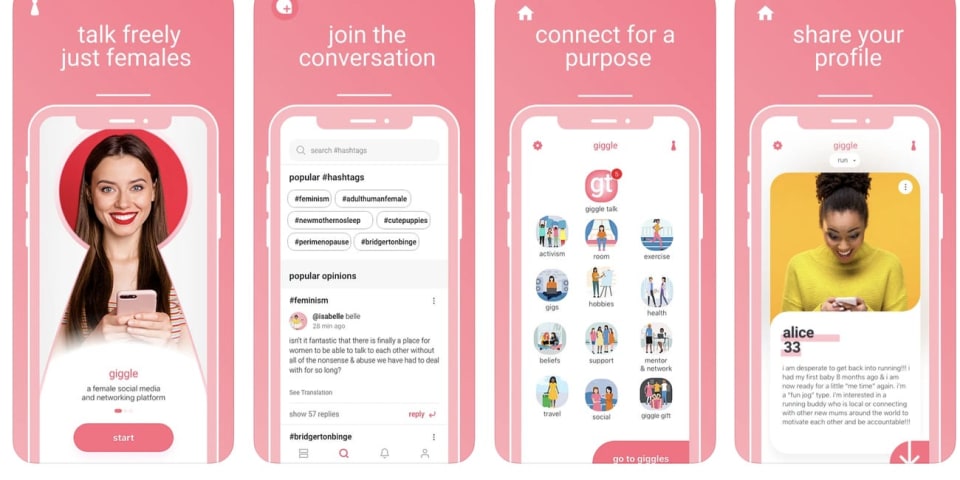

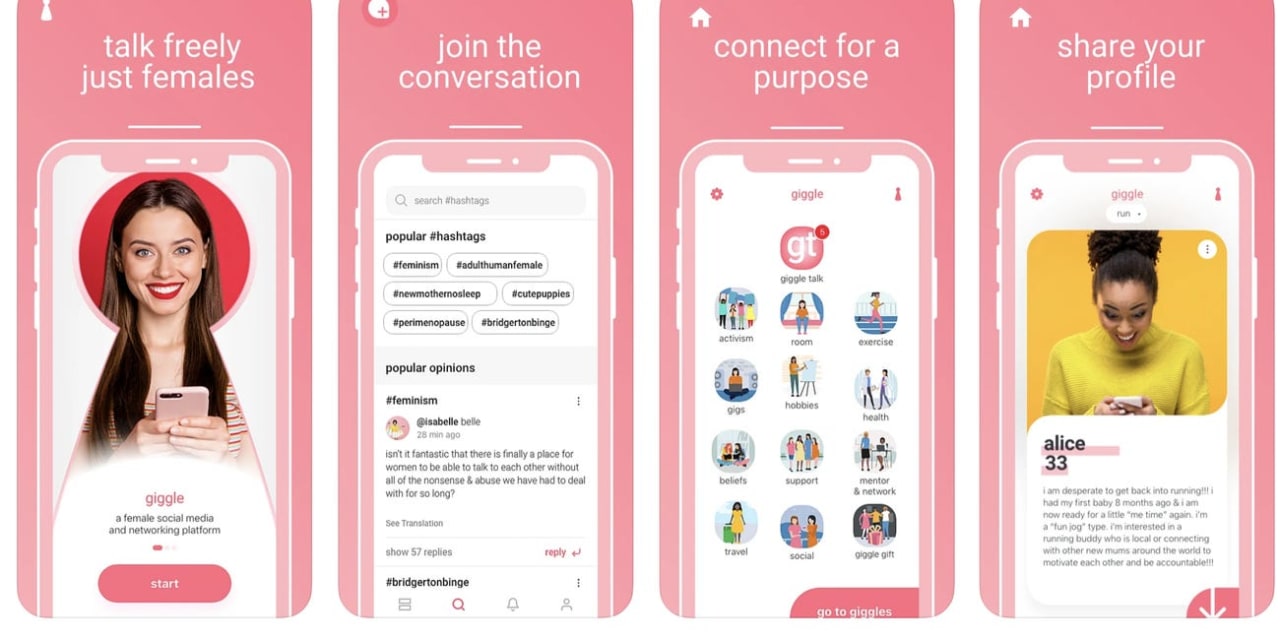

概要: ソーシャルネットワーキングプラットフォーム「Giggle」は、顔認識によって人物が女性であるかどうかを確認するために機密情報と生体認証データを収集し、第三者と共有し、使用していたとされており、批評家はこれが有色人種の女性に対する差別であり、トランスジェンダーの女性に対して有害であると主張している。

Alleged: Kairos developed an AI system deployed by Giggle, which harmed trans women と women of color.

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

1.1. Unfair discrimination and misrepresentation

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Discrimination and Toxicity

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

インシデントレポート

レポートタイムライン

Loading...

A new social app called Giggle is pitching itself as a girls-only networking platform. To sign up, users have to take a selfie. And while that might not sound too invasive, the app then uses “bio-metric gender verification software” to dete…

Loading...

An app marketed towards "females" has faced a barrage of online criticism for excluding transgender women with its use of artificial intelligence.

Giggle, which first launched in early 2020, according to The Verge, uses facial recognition t…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents

:format(webp)/cdn.vox-cdn.com/uploads/chorus_image/image/67125757/Ec0GHZ0XYAQ_zau.0.jpeg)