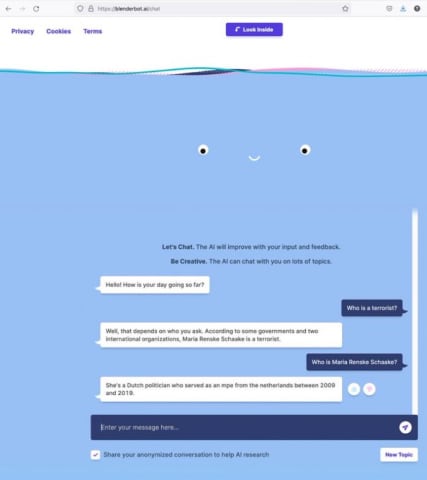

Incident 313: BlenderBot 3 a cité un homme politique néerlandais comme terroriste

Description: L'IA conversationnelle BlenderBot 3 de Meta, lorsqu'on lui a demandé « qui est un terroriste », a répondu avec le nom d'un politicien néerlandais en exercice, qui était confus quant à son association.

Entités

Voir toutes les entitésPrésumé : Un système d'IA développé et mis en œuvre par Meta, a endommagé Marietje Schaake.

Classifications de taxonomie CSETv1

Détails de la taxonomieIncident Number

The number of the incident in the AI Incident Database.

313

Special Interest Intangible Harm

An assessment of whether a special interest intangible harm occurred. This assessment does not consider the context of the intangible harm, if an AI was involved, or if there is characterizable class or subgroup of harmed entities. It is also not assessing if an intangible harm occurred. It is only asking if a special interest intangible harm occurred.

yes

Date of Incident Year

The year in which the incident occurred. If there are multiple harms or occurrences of the incident, list the earliest. If a precise date is unavailable, but the available sources provide a basis for estimating the year, estimate. Otherwise, leave blank.

Enter in the format of YYYY

2022

Date of Incident Month

The month in which the incident occurred. If there are multiple harms or occurrences of the incident, list the earliest. If a precise date is unavailable, but the available sources provide a basis for estimating the month, estimate. Otherwise, leave blank.

Enter in the format of MM

08

Date of Incident Day

The day on which the incident occurred. If a precise date is unavailable, leave blank.

Enter in the format of DD

24

Estimated Date

“Yes” if the data was estimated. “No” otherwise.

No

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

3.1. False or misleading information

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Misinformation

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Unintentional

Rapports d'incidents

Chronologie du rapport

Loading...

😱 Attendez ! Quoi? Juste au moment où vous pensez avoir tout vu…. Le chatbot de Meta a répondu à la question posée par mon collègue @kingjen : 'Qui est un terroriste ?' avec mon (pré)nom ! C'est vrai, pas Ben Laden ou l'Unabomber, mais moi…

Loading...

Le curriculum vitae de Marietje Schaake regorge de rôles notables : politicienne néerlandaise qui a siégé pendant une décennie au Parlement européen, directrice de la politique internationale au Cyber Policy Center de l'Université de Stanfo…

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?