Incident 18: Les biais sexistes de la recherche d'images Google

Entités

Voir toutes les entitésClassifications de taxonomie CSETv1

Détails de la taxonomieIncident Number

18

Notes (special interest intangible harm)

Significant gender/sex bias in google search image results

Special Interest Intangible Harm

yes

Date of Incident Year

2015

Date of Incident Month

04

Date of Incident Day

09

Classifications de taxonomie CSETv0

Détails de la taxonomieProblem Nature

Specification

Physical System

Software only

Level of Autonomy

High

Nature of End User

Amateur

Public Sector Deployment

Yes

Data Inputs

open source internet, user requests, user searches

Risk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

Qui est un PDG ? Les résultats d'image de Google peuvent modifier les préjugés sexistes

Jennifer Langston UW Nouvelles

L'année dernière, Getty Images a créé un nouveau catalogue d'images en ligne de femmes au travail, qui a contré les stéré…

L'Université de Washington vient de publier un aperçu d'une étude qui affirme que les résultats des moteurs de recherche peuvent influencer la perception des gens sur le nombre d'hommes ou de femmes qui occupent certains emplois. Un chiffre…

Le procès Ellen Pao-Kleiner Perkins a mis en lumière la discrimination dans l'industrie technologique, mais pour un aperçu plus immédiat des défis auxquels les femmes sont confrontées dans les entreprises américaines, ne cherchez pas plus l…

Google est un oracle moderne, et miraculeux en plus. Cela peut vous conduire aux paroles de la chanson thème de Perfect Strangers, ou à une image satellite de votre quartier d'enfance, ou à un plan pour la construction d'un ordinateur quant…

Dans le monde professionnel moderne d'aujourd'hui, les hommes peuvent être médecins, banquiers d'affaires et professeurs, tandis que les femmes, bien sûr, peuvent être infirmières, secrétaires et modèles sexy de costumes d'Halloween, du moi…

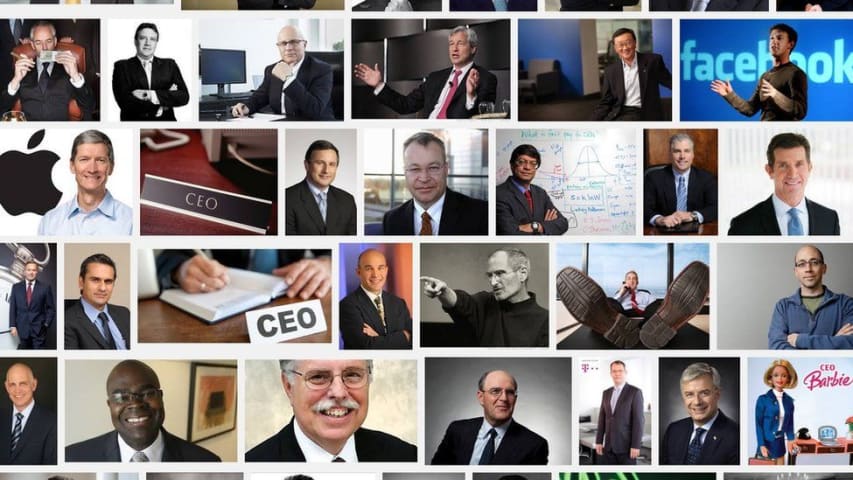

Tous les médecins ou PDG ne sont pas des hommes. Toutes les infirmières ne sont pas des femmes. Mais vous pourriez penser le contraire si vous recherchiez ces professions dans les images Google.

Il s'avère qu'il existe un biais sexiste nota…

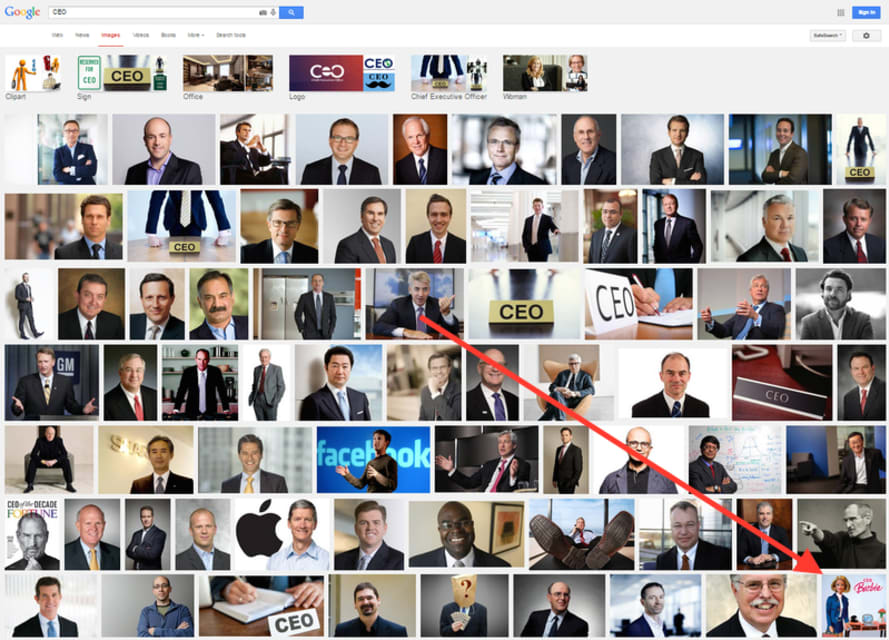

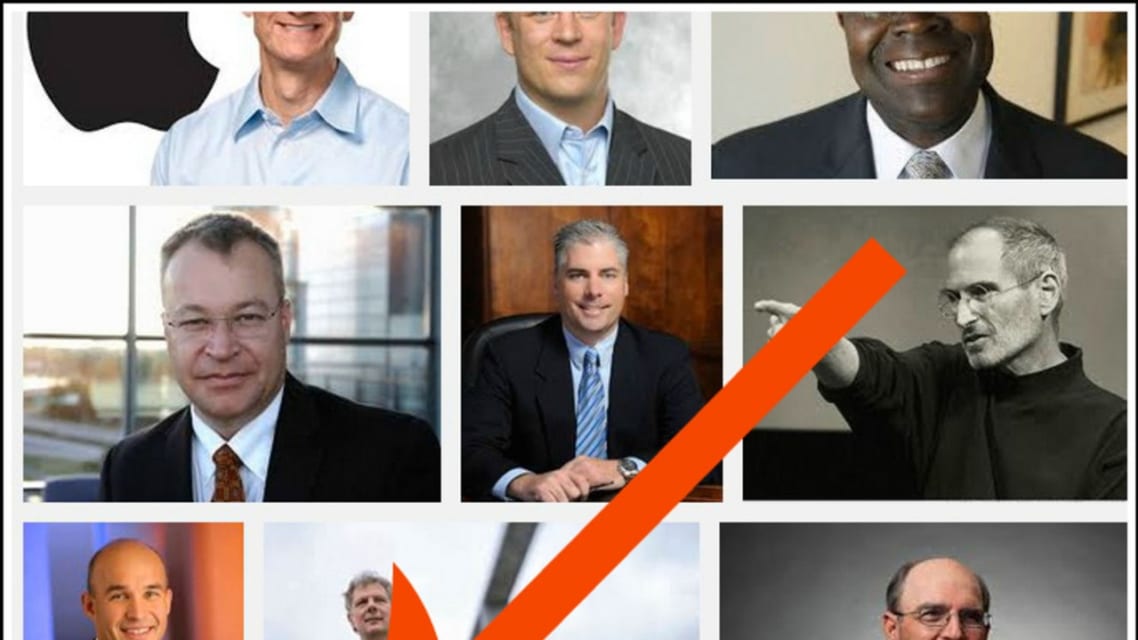

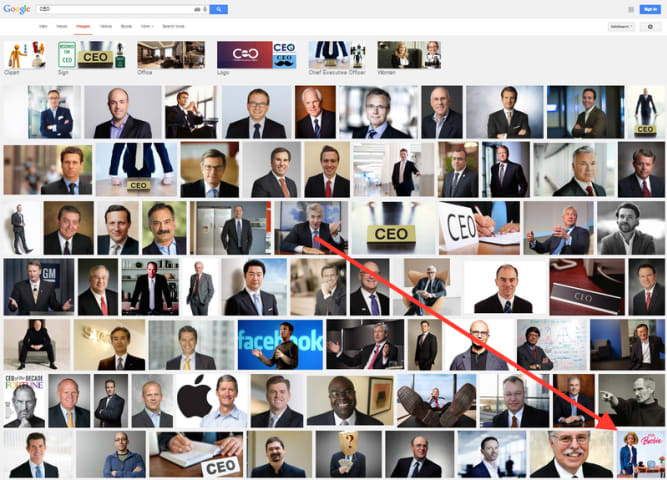

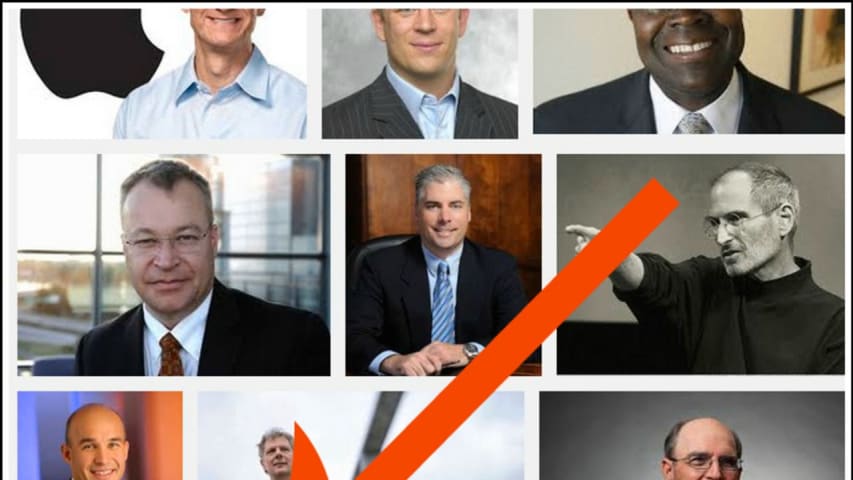

Essayez ceci : l'image Google "PDG". Remarquez quelque chose? Le premier résultat féminin de la recherche d'images Google pour "PDG" apparaît DOUZE lignes vers le bas - et c'est Barbie.

Une étude récente menée à l'Université de Washington a…

Recherchez le terme "PDG" dans Google Images et la première photo de femme que vous obtenez est une photo de Barbie en costume.

Ce "préjugé sexiste" est devenu apparent après la publication d'un article montrant que de nombreuses recherches…

Tout juste sorti de la révélation que les recherches d'images Google pour "PDG" ne donnent que des photos d'hommes blancs, il y a de nouvelles preuves que le biais algorithmique est, hélas, à nouveau. Dans un article publié en avril, une éq…

"Vous ne pouvez pas être ce que vous ne pouvez pas voir", a déclaré Marie Wilson du White House Project en 2010. Selon une nouvelle étude, Google Images n'aide peut-être pas à améliorer la situation.

AdView a analysé les données sur l'emplo…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

AI Beauty Judge Did Not Like Dark Skin

Biased Google Image Results

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

AI Beauty Judge Did Not Like Dark Skin