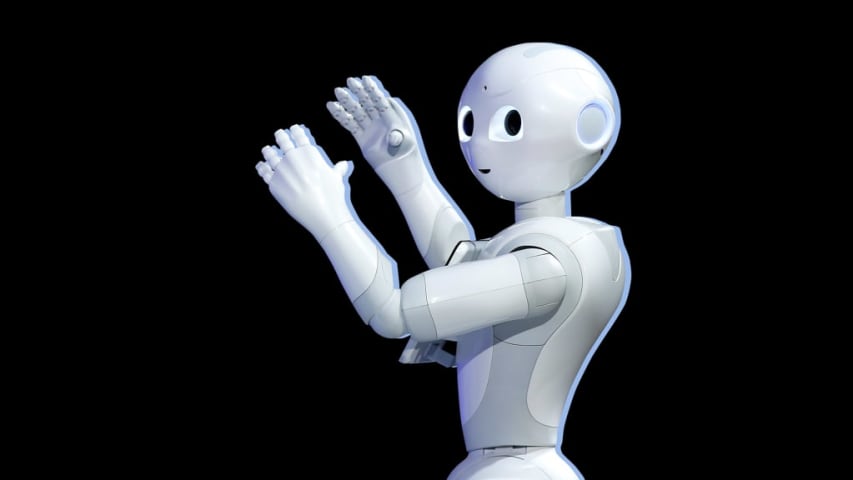

Incident 152: Pepper, le robot humanoïde de SoftBank, aurait fréquemment commis des erreurs, ce qui aurait entraîné son licenciement.

Entités

Voir toutes les entitésClassifications de taxonomie CSETv1

Détails de la taxonomieIncident Number

152

AI Tangible Harm Level Notes

Customers who purchased Pepper received a subpar product that did not meet their expectations or contractual terms. They, therefore incurred financial loss.

Special Interest Intangible Harm

no

Date of Incident Year

2014

Risk Subdomain

7.3. Lack of capability or robustness

Risk Domain

- AI system safety, failures, and limitations

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

TOKYO—Demander à un robot de lire les Écritures aux personnes en deuil semblait être une idée rentable pour les employés de Nissei Eco Co., un fabricant de plastiques actif dans le secteur funéraire.

L'entreprise a embauché Pepper, un robot…

Peut-être que les robots ne viennent pas encore pour vos travaux.

Pepper, un robot humanoïde de la soci�été japonaise de capital-risque SoftBank, a fait irruption sur la scène en 2014 avec une fanfare et une couverture médiatique considérabl…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents