Incident 103: L'outil de recadrage d'images de Twitter aurait révélé des préjugés sexistes et raciaux

Entités

Voir toutes les entitésClassifications de taxonomie GMF

Détails de la taxonomieKnown AI Goal Snippets

(Snippet Text: Twitter‘s algorithm for automatically cropping images attached to tweets often doesn’t focus on the important content in them. , Related Classifications: Image Cropping)

Classifications de taxonomie CSETv1

Détails de la taxonomieIncident Number

103

Special Interest Intangible Harm

yes

Notes (AI special interest intangible harm)

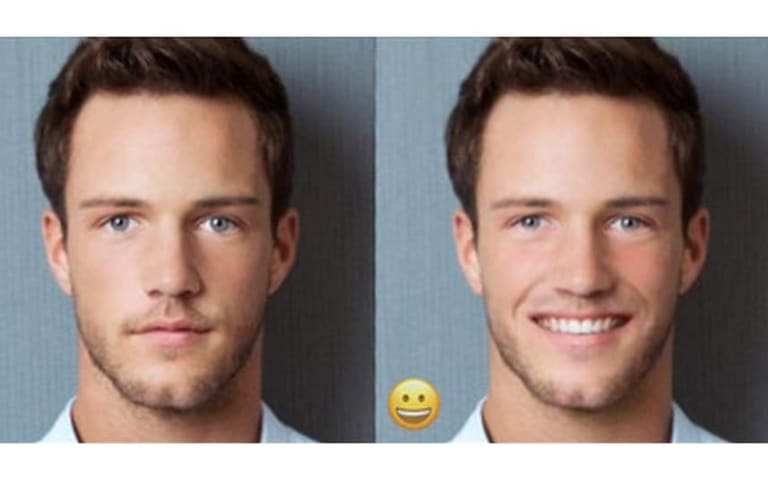

The cropping neutral network would crop the preview image in way that focused more on individuals with lighter completions, younger, female, or without disabilities.

Date of Incident Year

2020

Risk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

L'algorithme de Twitter pour recadrer automatiquement les images jointes aux tweets ne se concentre souvent pas sur le contenu important qu'ils contiennent. Un problème, bien sûr, mais cela semble mineur à la surface. Cependant, au cours du…

Une étude de 10 000 images a révélé un biais dans ce que le système choisit de mettre en évidence. Twitter a cessé de l'utiliser sur mobile et envisagera de l'abandonner sur le Web.

L'AUTOMNE DERNIER, l'étudiant CANADIEN Colin Madland a rem…

En octobre 2020, nous avons entendu des commentaires de personnes sur Twitter selon lesquels notre [algorithme de recadrage d'image](https: //blog.twitter.com/engineering/en_us/topics/infrastructure/2018/Smart-Auto-Cropping-of-Images.html) …

Twitter a présenté des plans pour un concours de primes de bogues avec une différence. Cette fois-ci, au lieu de payer les chercheurs qui découvrent des problèmes de sécurité, Twitter récompensera ceux qui trouveront des exemples de biais e…

Le premier [programme de primes pour le biais de l'IA] de Twitter (https://www.engadget.com/twitter-bug-bounty-contest-algorithm-bias-image-cropping-185634779.html) est terminé, et il y a déjà des problèmes que l'entreprise souhaite résoudr…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents