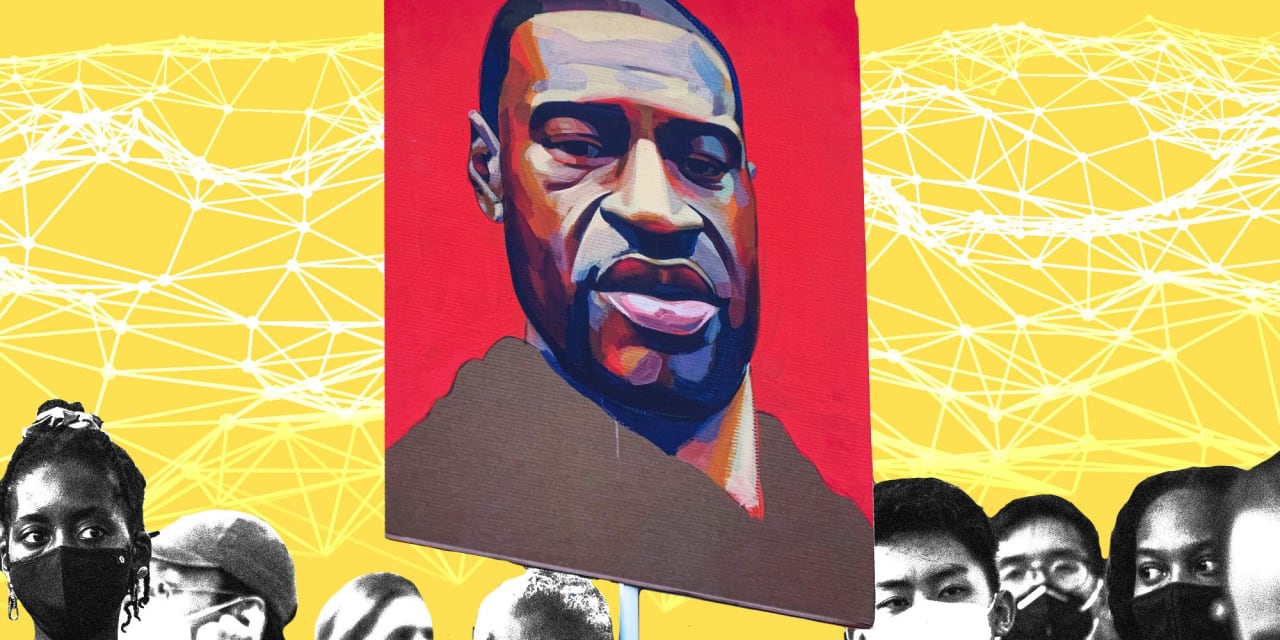

Incidente 850: Los chatbots de Character.ai supuestamente tergiversan la imagen de George Floyd en una plataforma generada por los usuarios

Descripción: Se crearon dos chatbots que emulaban a George Floyd en Character.ai, haciendo afirmaciones controvertidas sobre su vida y su muerte, incluyendo estar bajo protección de testigos y residir en el Cielo. Character.ai, ya criticado por otros incidentes de alto perfil, descartó los chatbots tras los informes de los usuarios.

Entidades

Ver todas las entidadesAlleged: Character.AI developed an AI system deployed by Character.AI users , @SunsetBaneberry983 y @JasperHorehound160, which harmed George Floyd y Family of George Floyd.

Sistema de IA presuntamente implicado: Character.AI

Estadísticas de incidentes

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

1.2. Exposure to toxic content

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Discrimination and Toxicity

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

Informes del Incidente

Cronología de Informes

Loading...

Un popular servicio en línea que utiliza inteligencia artificial (IA) para generar chatbots está viendo a personas crear versiones de George Floyd.

La empresa detrás del servicio, conocida como Character.AI, permite la creación de personaje…

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?

Incidentes Similares

Selected by our editors

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Selected by our editors

Did our AI mess up? Flag the unrelated incidents