Incidente 788: El algoritmo de Instagram habría recomendado contenido sexual a las cuentas de adolescentes.

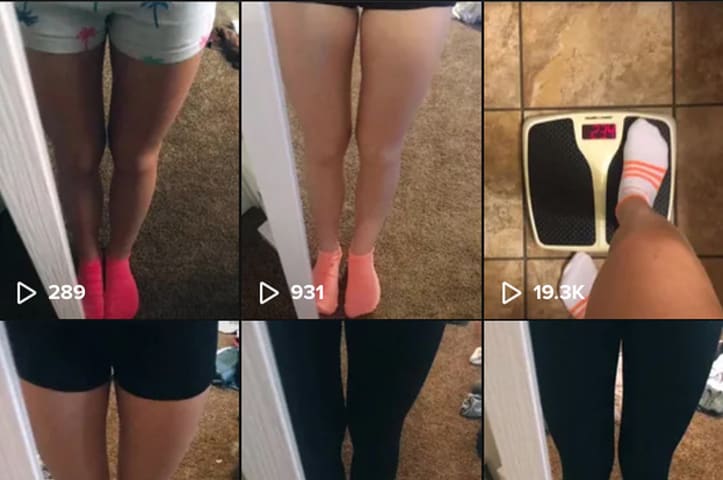

Descripción: Pruebas realizadas por The Wall Street Journal y un investigador revelaron que el algoritmo de Reels de Instagram, impulsado por IA, recomienda contenido sexualmente sugerente a cuentas con 13 años de antigüedad. A pesar del compromiso de Meta de restringir dicho contenido para menores, se publicaron videos explícitos a los pocos minutos de crear la cuenta, según los hallazgos.

Herramientas

Nuevo InformeNueva RespuestaDescubrirVer Historial

El Monitor de Incidentes y Riesgos de IA de la OCDE (AIM) recopila y clasifica automáticamente incidentes y riesgos relacionados con la IA en tiempo real a partir de fuentes de noticias reputadas en todo el mundo.

Entidades

Ver todas las entidadesPresunto: un sistema de IA desarrollado e implementado por Meta Platforms y Instagram, perjudicó a minors , Children , Instagram users y General public.

Estadísticas de incidentes

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

1.2. Exposure to toxic content

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Discrimination and Toxicity

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Unintentional

Informes del Incidente

Cronología de Informes

Loading...

Instagram recomienda regularmente videos sexuales a cuentas de adolescentes que parecen interesados en contenido subido de tono, y lo hace minutos después de que inician sesión por primera vez, según pruebas realizadas por The Wall Street J…

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents