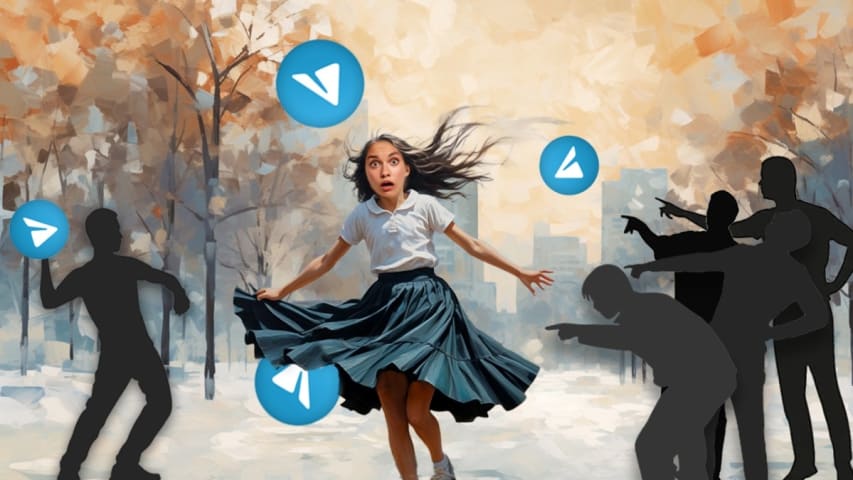

Incidente 782: Aplicaciones de inteligencia artificial 'Nudify' utilizadas como herramientas de chantaje y extorsión

Descripción: Las aplicaciones de IA para "desnudar" se utilizan para generar fotos hiperrealistas de desnudos no consentidos de personas, que luego se utilizan para extorsionar y acosar. Estas aplicaciones emplean IA generativa para eliminar la ropa de las imágenes y crear falsificaciones convincentes, que suelen distribuirse en plataformas como Telegram. Las víctimas son amenazadas o humilladas con estas imágenes generadas por IA, con pocas opciones para su eliminación o acciones legales.

Entidades

Ver todas las entidadesAlleged: Unknown deepfake creators developed an AI system deployed by Unknown deepfake creators y Extortionists, which harmed Women in India , Women y General public.

Estadísticas de incidentes

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

4.3. Fraud, scams, and targeted manipulation

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Malicious Actors & Misuse

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

Informes del Incidente

Cronología de Informes

Loading...

Más que cualquier otra cosa, la desesperación llevó a Rishabh a recurrir a aplicaciones que prometían préstamos rápidos: dinero fácil a sólo unos clics de distancia. Estaba en la ruina. Además, tenía que soportar la carga de préstamos con i…

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?