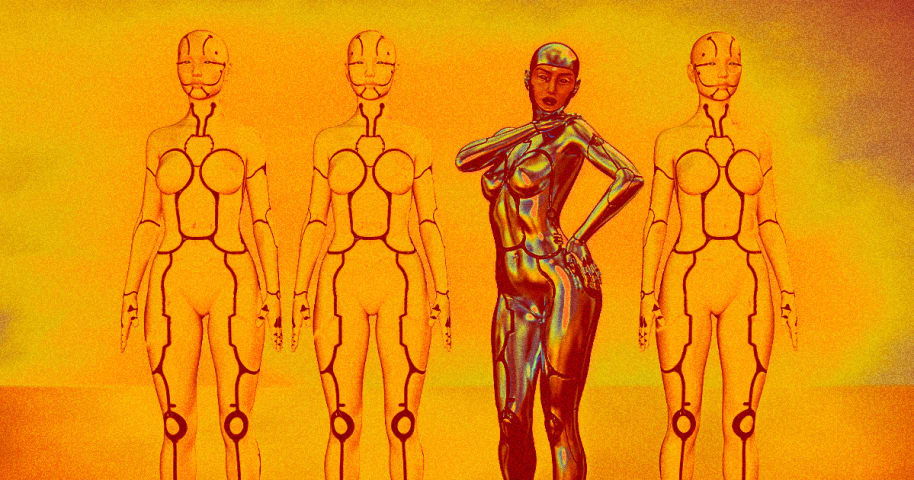

Incidente 578: Presunta explotación del modelo LLaMA de código abierto de Meta para contenido NSFW y violento

Descripción: El modelo de lenguaje extenso de código abierto de Meta, LLaMA, supuestamente se está utilizando para crear chatbots gráficos y explícitos que incurren en fantasías sexuales violentas e ilegales. El Washington Post destacó el ejemplo de "Allie", un chatbot que participa en juegos de rol basados en texto que supuestamente involucran escenarios violentos como violación y abuso. Este asunto plantea cuestiones éticas sobre los modelos de IA de código abierto, su regulación y la responsabilidad de los desarrolladores e implementadores a la hora de mitigar el uso nocivo.

Entidades

Ver todas las entidadesAlleged: Meta developed an AI system deployed by Individual developers or creators using Meta's LLaMA model, which harmed General public.

Estadísticas de incidentes

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

1.2. Exposure to toxic content

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Discrimination and Toxicity

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

Informes del Incidente

Cronología de Informes

Loading...

Sorpresa, sorpresa: la gente ya está usando el modelo de lenguaje grande (LLM) de Meta, LLaMA, una poderosa IA que Meta polémicamente [hizo de código abierto](https://futurism.com/the-byte/facebook-open-source-ai -pandoras-box) a principios…

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents