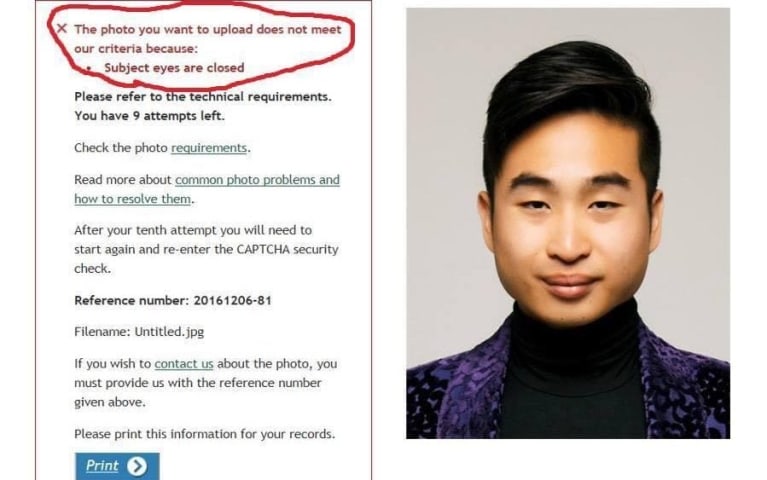

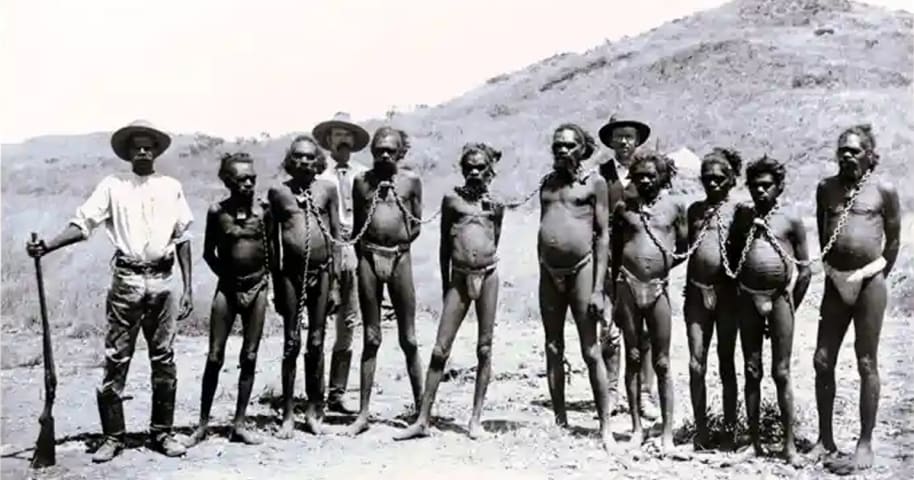

Incidente 275: El algoritmo de moderación de Facebook baneó a usuarios por evidencia histórica de esclavitud

Descripción: Un portavoz de la empresa reconoció que la moderación automática de contenido de Facebook censuró y prohibió erróneamente a usuarios australianos publicar un artículo que contenía una fotografía de 1890 de hombres aborígenes encadenados por la desnudez como evidencia histórica de la esclavitud en Australia.

Entidades

Ver todas las entidadesPresunto: un sistema de IA desarrollado e implementado por Facebook, perjudicó a Facebook users sharing photo evidence of slavery y Facebook users.

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

1.3. Unequal performance across groups

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Discrimination and Toxicity

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Unintentional

Informes del Incidente

Cronología de Informes

Loading...

Facebook eliminó una foto de hombres aborígenes utilizada para probar el racismo en Australia, después de afirmar que la foto incluía desnudez.

La imagen se compartió en línea para demostrar que el racismo había tenido lugar en Australia a …

Loading...

La publicación se hizo en el contexto de que el primer ministro australiano, Scott Morrison, afirmó que no había esclavitud en Australia. Antes de un día después, [retrocedió](https://www.theguardian.com/australia-news/2020/jun/12/scott-mor…

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Loading...

Defamation via AutoComplete

· 28 informes

Loading...

Amazon Censors Gay Books

· 24 informes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Loading...

Defamation via AutoComplete

· 28 informes

Loading...

Amazon Censors Gay Books

· 24 informes