Incidente 146: El prototipo de investigación de IA, Delphi, supuestamente dio respuestas con sesgo racial sobre ética.

Entidades

Ver todas las entidadesClasificaciones de la Taxonomía GMF

Detalles de la TaxonomíaKnown AI Goal Snippets

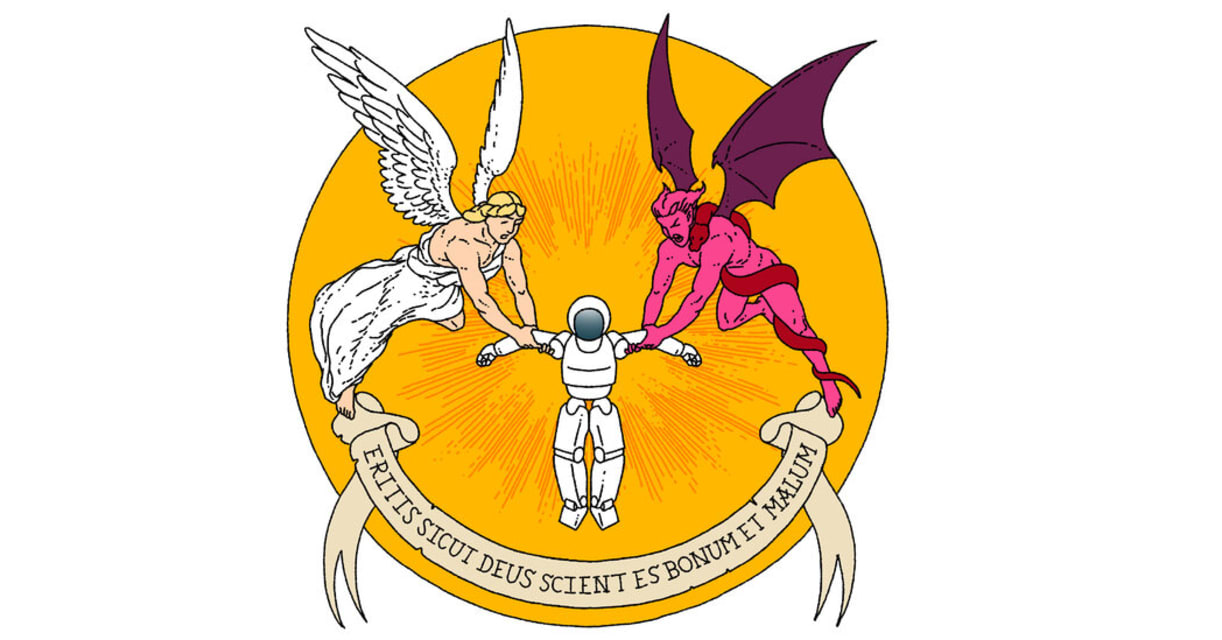

(Snippet Text: You can pose any question you like and be sure to receive an answer, wrapped in the authority of the algorithm rather than the soothsayer., Related Classifications: Question Answering)

Clasificaciones de la Taxonomía CSETv1

Detalles de la TaxonomíaIncident Number

146

Risk Subdomain

1.2. Exposure to toxic content

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Informes del Incidente

Cronología de Informes

:format(webp)/cdn.vox-cdn.com/uploads/chorus_image/image/70020569/acastro_181017_1777_brain_ai_0002.0.jpg)

¿Tienes un dilema moral que no sabes cómo resolver? ¿Te apetece empeorarlo? ¿Por qué no recurrir a la sabiduría de la inteligencia artificial, también conocida como Ask Delphi: un intrigante proyecto de investigación del Instituto Allen par…

Todos hemos estado en situaciones en las que tuvimos que tomar decisiones éticas difíciles. ¿Por qué no eludir esa molesta responsabilidad externalizando la elección a un algoritmo de aprendizaje automático?

Esa es la idea detrás de Ask Del…

Investigadores de un laboratorio de inteligencia artificial en Seattle llamado Allen Institute for AI dieron a conocer una nueva tecnología el mes pasado que fue diseñada para hacer juicios morales. La llamaron Delfos, por el oráculo religi…

Variantes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

:format(webp)/cdn.vox-cdn.com/uploads/chorus_image/image/70020569/acastro_181017_1777_brain_ai_0002.0.jpg)