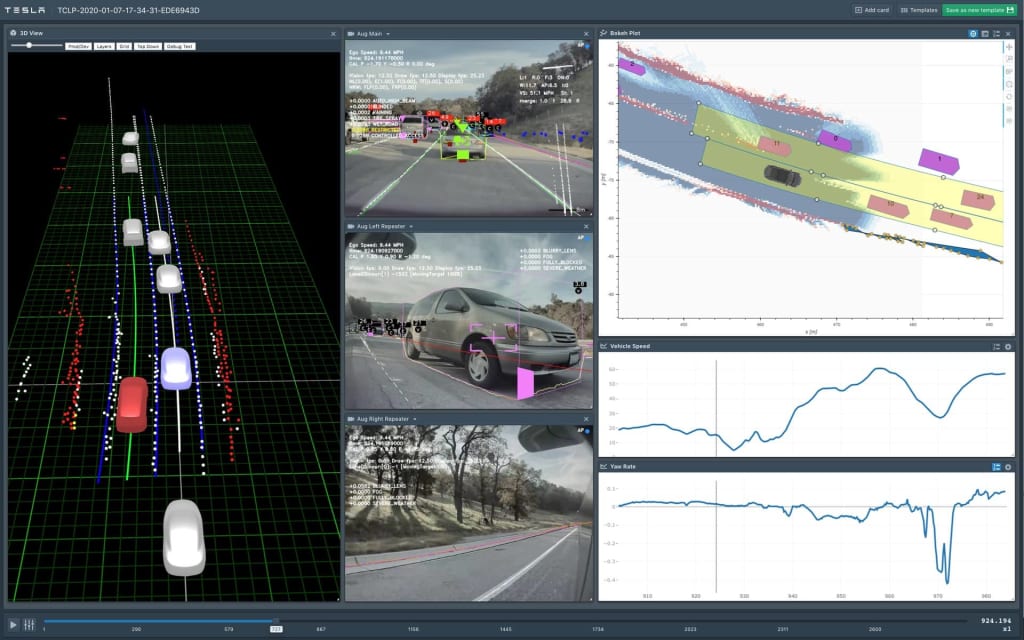

Incidente 145: El piloto automático de Tesla identificó erróneamente la Luna como una luz amarilla de freno

Entidades

Ver todas las entidadesClasificaciones de la Taxonomía CSETv1

Detalles de la TaxonomíaIncident Number

145

AI Tangible Harm Level Notes

Stopping incorrectly could cause accidents on the road.

Special Interest Intangible Harm

no

Date of Incident Year

2021

Date of Incident Month

07

Date of Incident Day

22

Risk Subdomain

7.3. Lack of capability or robustness

Risk Domain

- AI system safety, failures, and limitations

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Informes del Incidente

Cronología de Informes

Oye, @elonmusk, tal vez quieras que tu equipo mire hacia la luna engañando al sistema de piloto automático. El auto piensa que la luna es un semáforo en amarillo y quería seguir disminuyendo la velocidad. 🤦🏼 @Teslarati @teslaownersSV @Tes…

Un tuit viral mostró a un Tesla confundiendo la luna con un semáforo en amarillo.

La tecnología Full Self-Driving de la compañía ha cometido errores similares antes.

Los propietarios dicen que sus autos han sido engañados por vallas publici…

Washington, DC (CNN) — Cuando una docena de niños pequeños cruzaron frente a nuestro Tesla con “conducción totalmente autónoma”, tenía buenas razones para estar nervioso.

Hasta ahora había pasado la mañana en el asiento trasero del Model 3 …

Variantes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents