概要: 四川省では、AIツールが様々な都市で虚偽の報道を作成し、拡散していたと報じられています。その中には、土砂崩れ、地震、睨み合い、事故、健康被害に関する捏造情報などが含まれていました。これらのAIによる噂は、一般市民を誤解させ、不安と混乱を引き起こし、地方当局に負担をかけました。容疑者は、クリックベイトコンテンツを通じてソーシャルメディアでの反響と金銭的利益を得ようとしていました。四川省当局は最終的に、加害者に対して行政罰を科しました。

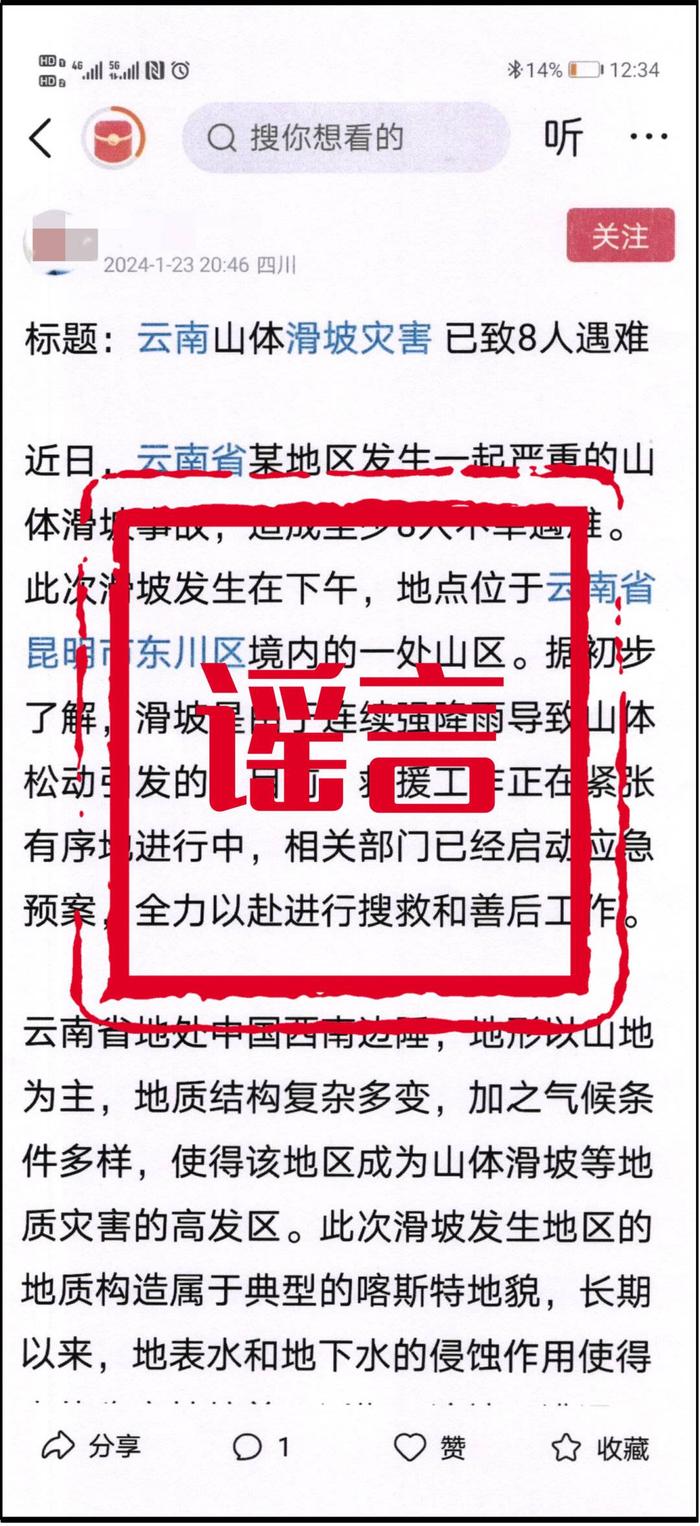

Editor Notes: Incident 836 presents an editorial challenge in that it is a composite of 10 discrete AI incidents that point to the possibility of other harm events (see Incidents 834 and 835 as well). "Moumou" and "Mou" refer to partially anonymized names in Chinese media. The following is a reconstruction of each incident outlined in this collective incident report; the majority (but not all) incidents were in Sichuan Province: (1) 11/20/2023 – Fabricated Chengdu Bus Accident: Chen Mou reportedly altered news of a bus crash in Chongqing to claim a similar incident occurred in Chengdu, alleging fatalities and severe impact. (2) 11/28/2023 – False Chengdu Construction Accident Report: Zhu Mou created a fake story about a construction accident in Chengdu’s Longquanyi District, falsely reporting multiple worker fatalities due to an electrical incident. (3) 12/27/2023 – Underground Pipeline Rupture Hoax in Xi’an: Wang Mou and Liu Mou allegedly spread a rumor about a broken underground heating pipeline in Xi’an, using AI to combine information with misleading images to attract attention. (4) 01/12/2024 – Fabricated Abandoned Infant Story in Guiyang: Zhou Mou reportedly used AI to create a story claiming a four-month-old infant was abandoned in Guiyang’s Huaxi District, falsely presenting a distressing social issue. (5) 01/23/2024 – Fabricated Landslide Fatalities in Yunnan: Yang Moumou allegedly spread a fake story claiming that a landslide in Yunnan resulted in eight deaths, using AI-generated information to amplify the incident’s impact (see Incident 835). (6) 04-05/2024 – False Banner and Ceremony Reports in Chengdu: Wang Mou allegedly created fake news about a banner encouraging second births, along with a fictional ceremony in Chengdu’s Pidu District, using AI to create convincing but false visuals. (7) 05/11/2024 – Heart Attack Incident in Xichang: Ji Moumou allegedly created a story about a man who reportedly died of a heart attack following a sex-related incident, spreading the rumor online to gain views. (8) 05/18/2024 – Bazhong Cash Transport Standoff: Shang Moumou allegedly fabricated a report about a standoff involving a cash transport vehicle in Bazhong, claiming a police-citizen confrontation for dramatic effect. (9) 06/09/2024 – Exaggerated Xide County Earthquake Report: Luo Moumou used AI tools to fabricate a story about an earthquake in Xide County, amplifying the damage and claiming casualties, despite the actual quake occurring in Muli County with minimal damage (see Incident 834). (10) 06/24/2024 – Elderly Abandonment Story in Chengdu: Zhang Mou reportedly created a false story of a 90-year-old man abandoned by his children, claiming he was found begging in Chengdu’s Xinjin District, using AI-generated visuals.

Alleged: Unknown deepfake technology developers と Unknown AI developers developed an AI system deployed by Zhu Mou , Zhou Moumou , Zhang Moumou , Yang Moumou , Wang Mou , Shang Moumou , Luo Moumou , Liu Mou , Ji Moumou と Chen Mou, which harmed Sichuan general public と Sichuan authorities.

インシデントのステータス

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

4.1. Disinformation, surveillance, and influence at scale

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Malicious Actors & Misuse

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

インシデントレポート

レポートタイムライン

Loading...

カバーニュース記者ゴ・チュン

近年、AI のテキストや画像の生成機能は、一部の犯罪者によって虚偽の情報を編集するために使用されており、犯罪者が噂を作成し広める敷居が低くなりました。 7月23日、取材記者は四川省公安部サ�イバーセキュリティ隊から、四川省インターネット警察がAI関連のネット上の噂を厳しく取り締まるために積極的な行動をとったことを知り、AIに関する噂の典型的な10件を発表した。物売り。

事例1:AIソフトを利用して「土砂崩れで8人死亡」というネット上のデマを捏造

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents