概要: Googleの検索AIは、アフリカの国名が「K」で始まる国がないと誤って判定したほか、地理や文字に基づく様々な質問に対しても誤判定を行い、不正確な強調スニペットでユーザーを誘導しました。このインシデントはChatGPTによって作成された投稿をGoogleが不正確にスクレイピングしたもので、AI生成コンテンツと検索結果における誤情報の問題を浮き彫りにし、情報源としてのGoogleの信頼性を損なうものです。

Editor Notes: Incident 609 is occasionally being referenced in reports associated with Incident 693.

インシデントのステータス

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

3.1. False or misleading information

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Misinformation

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Unintentional

インシデントレポート

レポートタイムライン

Loading...

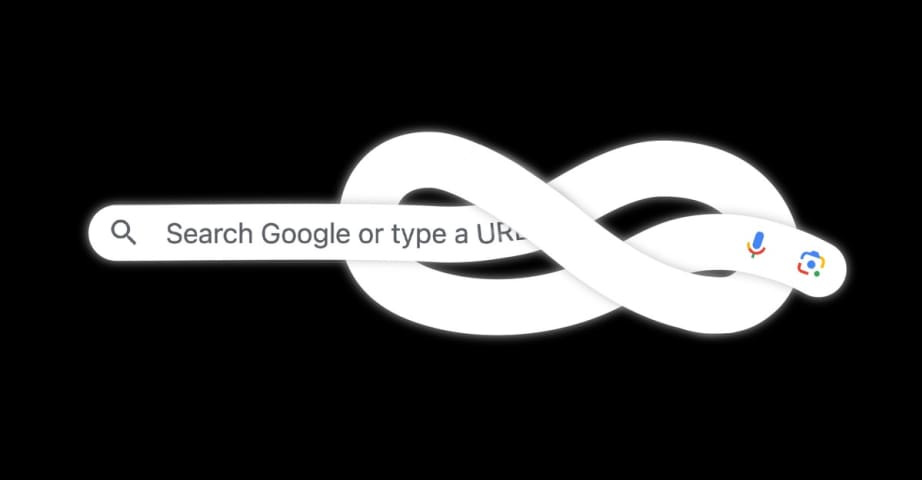

There is no easy way to explain the sum of Google’s knowledge. It is ever-expanding. Endless. A growing web of hundreds of billions of websites, more data than even 100,000 of the most expensive iPhones mashed together could possibly store.…

Loading...

Google's AI-powered search doesn't understand geography. Or, apparently, the alphabet. And definitely not both at the same time.

It all started when a Bluesky user declared that Google is now "dead." They included a screenshot of Google's f…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?