概要: オーストラリアのニューサウスウェールズ州警察は、シドニーの高校の女子生徒をAIが生成したとされる性的に露骨な画像がオンライン上に拡散されているという保護者からの通報を受け、捜査を開始した。ディープフェイクツールを用いて生徒の同意なしに作成されたとされるこれらの画像は、学校が介入し、こうしたコンテンツを禁止する新たな州法に基づき刑事捜査が行われた。

Alleged: Unknown deepfake technology developers developed an AI system deployed by Unknown actor(s) creating deepfake nudes of Sydney high school students, which harmed Unnamed Sydney high school students と Families of unnamed Sydney high school students.

関与が疑われるAIシステム: Unknown deepfake technology と Nudify apps

インシデントのステータス

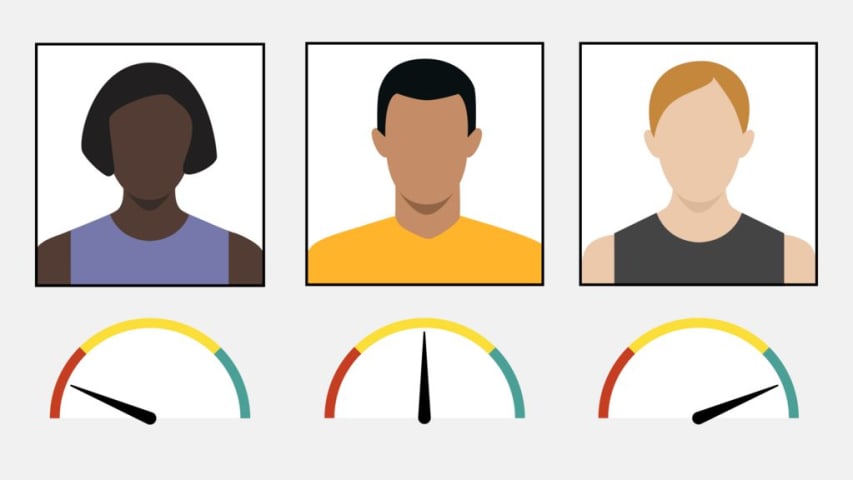

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

4.3. Fraud, scams, and targeted manipulation

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Malicious Actors & Misuse

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

インシデントレポート

レポートタイムライン

Loading...

警察は、シドニーの高校の女子生徒の顔写真を使ってデジタル加工されたわいせつな画像がオンライン上に拡散されているという通報を受け、捜査を行っている。

ABCは、水曜日の夜に複数の家族がイーストウッド警察署を訪れたと把握している。

警察は短い声明で、捜査中であることを確認した。

広報担当者は、「ライド警察管区司令部に所属する警察官が捜査を開始した」と述べた。

「捜査は継続中で、現時点ではこれ以上の情報はない。」

ABCは、画像が送られてきた男子生徒が学校に通報した後、保護…

Loading...

過去18ヶ月間で、オーストラリア国内におけるディープフェイク画像を利用した虐待の報告件数は倍増しており、毎週少なくとも1件の事件がオーストラリアの学校で発生している。

これらの数字は、オーストラリアのeSafetyコミッショナーによって金曜日に明らかにされた。これは、シドニー北部の高校で女子生徒が標的にされていた事件について、ABCが警察の捜査を暴露したことを受けてのものだ。

ジュリー・インマン・グラントコミッショナーは、オンライングループにおけるデジタル加工されたわいせつな…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents