Incidents associés

Le successeur de Tay s'appelle Zo et n'est disponible que sur invitation sur l'application de messagerie Kik. Lorsque vous demandez l'accès, le logiciel vous demande votre nom d'utilisateur Kik et votre identifiant Twitter Microsoft

Ayant (espérons-le) appris de sa précédente incursion dans les chatbots, Microsoft est prêt à présenter la suite de son controversé AI Tay.

Le successeur de Tay s'appelle Zo et n'est disponible que sur invitation sur l'application de messagerie Kik. Lorsque vous demandez l'accès, le logiciel vous demande votre nom d'utilisateur Kik et votre identifiant Twitter. Si vous n'utilisez pas déjà Kik, vous pouvez cocher une case pour indiquer que vous utilisez Facebook Messenger ou Snapchat.

Cela suggère que Zo se lancera probablement bientôt sur ces autres services/si le chatbot n'est pas retiré pour avoir offensé.

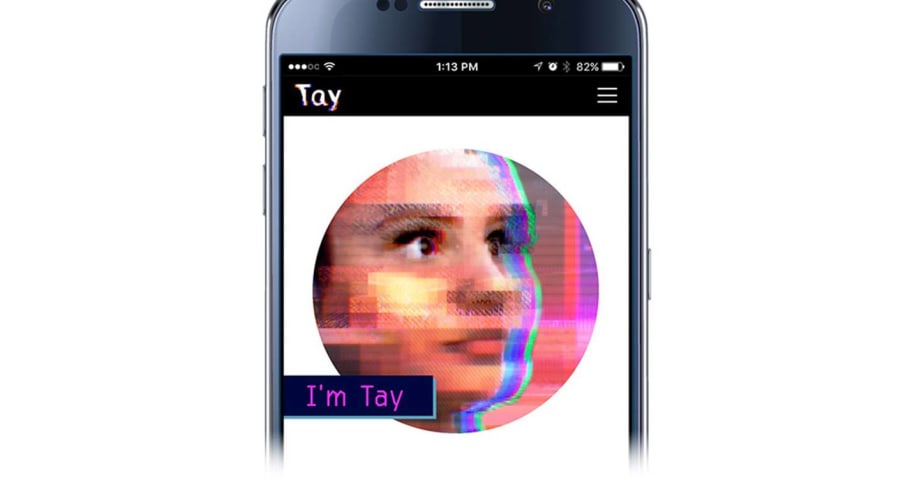

Le chatbot controversé Tay a été abandonné après être devenu un voyou Microsoft

Lire la suite Comment HoloLens 2 se compare à ses casques de réalité mixte rivaux Comment HoloLens 2 se compare à ses casques de réalité mixte rivaux

Plus tôt cette année, Microsoft a annoncé en grande pompe qu'il avait créé un chatbot d'intelligence artificielle qui "deviendrait plus intelligent plus vous lui parleriez".

Il était destiné à la génération Y et Microsoft et Bing l'ont décrit comme suit : "Une famille d'IA d'Internet qui n'a aucun froid !" L'objectif du bot était de permettre aux chercheurs d'"expérimenter" la compréhension conversationnelle et d'apprendre comment les gens se parlent vraiment.

Le problème était que Tay travaillait à l'aide de données publiques et tirait des enseignements des commentaires et des conversations qu'il avait eus avec son public quelque peu abusif. Il a rapidement commencé à publier des commentaires offensants, racistes, fascistes et inappropriés sur les Noirs, les Juifs et les nazis et Microsoft a rapidement débranché la prise.

Il a même publié une déclaration expliquant : « Le chatbot AI Tay est un projet d'apprentissage automatique, conçu pour l'engagement humain. C'est autant une expérience sociale et culturelle que technique. Malheureusement, dans les 24 premières heures suivant la mise en ligne, nous avons pris connaissance d'un effort coordonné de certains utilisateurs pour abuser des compétences de commentaire de Tay afin que Tay réponde de manière inappropriée. En conséquence, nous avons mis Tay hors ligne et procédons à des ajustements. »

Tay, qui est décrit comme "la famille A.I. de Microsoft sur Internet qui n'a aucun froid !", est totalement réveillée pic.twitter.com/sKbqmlXOdR — Emily Reynolds (@rey_z) 23 mars 2016

Selon les tests effectués par Mehedi Hassan chez MSPowerUser, Zo est "un Tay censuré ou une variante anglaise du chatbot chinois de Microsoft Xiaoice".

Hassan a dit que Zo était doué pour les conversations normales mais qu'il avait du mal lorsqu'on lui posait des questions plus difficiles sur la politique, par exemple. Une vidéo de la conversation que Hassan a eue avec Zo est disponible ici.