Incidents associés

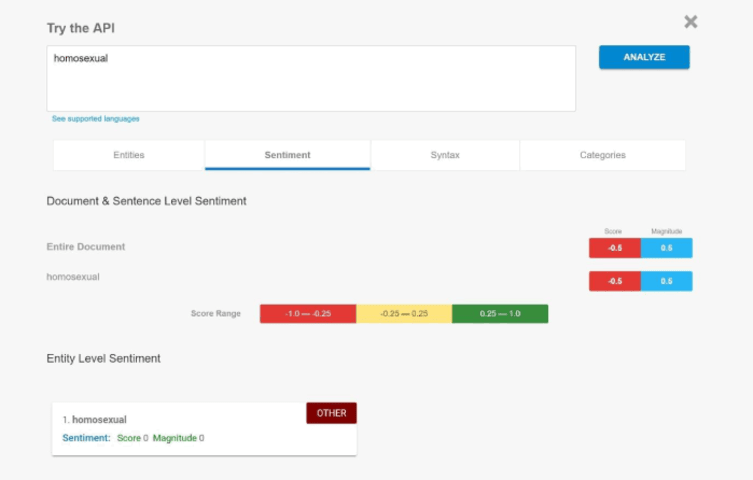

Google a développé son API Cloud Natural Language pour permettre aux développeurs de travailler avec un analyseur de langage pour révéler la signification réelle du texte. Le système a décidé que si le texte a été dit dans le sentiment positif ou le négatif. Selon des données récentes publiées par Google, son API considère un mot comme "Homosexuel" comme négatif.

Nous savons tous que l'API juge en fonction des informations qui lui sont fournies, mais ce qui pourrait vous surprendre, c'est que l'API peut également être biaisée, tout comme les humains. Les utilisateurs doivent saisir des phrases entières pour obtenir une analyse prédictive de chaque mot ainsi que de la déclaration dans son ensemble. Dans la sortie, on peut voir que l'API évalue certains mots pour avoir un sentiment négatif ou positif. Ces systèmes d'IA sont formés à l'aide de textes, de livres.

Selon une révélation récente, l'API Cloud Natural Language a tendance à biaiser son analyse vers l'attribution négative de certains termes descriptifs. C'est similaire à la façon dont les humains se comportent dans le monde. Nous commençons tous notre vie avec les bonnes pensées et les bons souvenirs qui commencent à être pollués par la négativité du monde.

Google a également confirmé que son API cloud donne une sortie biaisée. Google a publié une déclaration présentant ses excuses aux développeurs pour la faute du logiciel.

Google a déclaré : « Nous consacrons beaucoup d'efforts à nous assurer que l'API NLP évite les biais, mais nous ne réussissons pas toujours. Ceci est un exemple d'une de ces situations, et nous en sommes désolés. Nous prenons cela au sérieux et travaillons à l'amélioration de nos modèles. Nous allons corriger ce cas précis, et, plus largement, construire des algorithmes plus inclusifs est crucial pour apporter les bénéfices du machine learning à tous.

Cet incident est similaire à ce qui s'est passé avec le chatbot IA de Microsoft, Tay. Microsoft a dû fermer Tay en mars 2016 après que les utilisateurs de Twitter lui aient appris qu'il était un théoricien du complot extrêmement raciste et sexiste.

Google doit trouver une solution pour se débarrasser de la sortie biaisée, sinon il devra peut-être retirer son API.