Incidents associés

Ne blâmez pas l'algorithme - tant qu'il existe des disparités raciales dans le système judiciaire, les logiciels de détermination de la peine ne peuvent jamais être entièrement équitables.

Depuis des générations, les Massaïs d'Afrique de l'Est ont transmis l'histoire d'un vieil homme infatigable. Il vivait seul et sa vie n'était pas facile. Il passait chaque jour dans les champs - labourant la terre, s'occupant des animaux et recueillant de l'eau. Le travail était aussi nécessaire qu'épuisant. Mais le vieil homme s'estimait chanceux. Il a eu une belle vie et n'a jamais vraiment réfléchi à ce qui lui manquait. Un matin, le vieil homme fut accueilli avec une agréable surprise. Debout dans sa cuisine se tenait un jeune garçon, peut-être âgé de sept ou huit ans. Le vieil homme ne l'avait jamais vu auparavant. Le garçon sourit mais ne dit rien. Le vieil homme regarda autour de lui. Son petit-déjeuner du matin était déjà préparé, comme il l'aimait. Il a demandé le nom du garçon. "Kileken," répondit le garçon. Après quelques incitations, le garçon expliqua qu'avant de préparer le petit-déjeuner, il avait terminé tout le travail du vieil homme pour la journée. Incrédule, le vieil homme sortit. En effet, les champs avaient été labourés, les animaux soignés et l'eau recueillie. L'étonnement se lisant sur son visage, le vieil homme recula en titubant dans la cuisine. "Comment est-ce arrivé? Et comment puis-je te rembourser ? Le garçon sourit à nouveau, cette fois avec dédain. "Je n'accepterai aucun paiement. Tout ce que je demande, c'est que tu me laisses rester avec toi. Le vieil homme savait qu'il ne fallait pas regarder un cheval cadeau dans la bouche. Kileken et le vieil homme devinrent bientôt inséparables, et la ferme devint luxuriante et abondante comme jamais auparavant. Le vieil homme pouvait à peine se rappeler à quoi ressemblait la vie avant l'arrivée de son jeune camarade. Il ne pouvait y avoir aucun doute : avec l'aide mystérieuse de Kileken, le vieil homme prospérait. Mais il n'a jamais vraiment compris pourquoi, ni comment, c'était arrivé.

Dans une mesure que nous n'avons pas pleinement reconnue, les algorithmes de prise de décision sont devenus le Kileken collectif de notre société. Ils se présentent à l'improviste et là où nous les attendons le moins, promettent et livrent souvent de grandes choses, et sont rapidement considérés comme indispensables. Leur portée ne peut être surestimée. Ils indiquent aux commerçants quelles actions acheter et vendre, déterminent combien coûte notre assurance automobile, influencent les produits qu'Amazon nous montre et combien nous sommes facturés pour eux, et interprètent nos recherches Google et classent leurs résultats.

Ces algorithmes améliorent l'efficacité et la précision des services sur lesquels nous comptons tous, créent de nouveaux produits que nous n'aurions jamais pu imaginer auparavant, soulagent les gens d'un travail fastidieux et sont un moteur de croissance économique apparemment illimitée. Ils imprègnent également des domaines de la prise de décision sociale qui ont traditionnellement été laissés au jugement humain direct, comme le jumelage romantique et la condamnation pénale. Pourtant, ils sont en grande partie cachés, restent opaques même lorsque nous sommes invités à les examiner et sont rarement soumis aux mêmes freins et contrepoids que les décideurs humains.

Pire encore, certains de ces algorithmes semblent nous renvoyer les pires préjugés de la société. En avril dernier, par exemple, nos flux Facebook - organisés par un labyrinthe d'algorithmes - ont été inondés d'histoires sur FaceApp, un programme qui appliquait des filtres aux photos téléchargées afin que l'utilisateur paraisse plus jeune ou plus âgé ou plus attrayant. Au début, cette application semblait être juste un autre argument intelligent pour la génération Snapchat. Mais les choses se sont rapidement détériorées lorsque les utilisateurs ont découvert que le filtre "chaud" de l'application - qui prétendait transformer les Joes et Jills ordinaires en beaux Adonises et Aphrodites - rendait la peau plus claire, les yeux plus ronds et le nez plus petit. L'application semblait assimiler l'attrait physique aux traits du visage européens. La réaction a été rapide, impitoyable et apparemment bien méritée. L'application - et, par la suite, l'algorithme dont elle dépendait - semblait être raciste. La société a d'abord renommé le filtre "chaud" pour "exclure toute connotation positive qui lui est associée", avant de le retirer sans ménagement de l'application.

Le filtre chaud de FaceApp était loin d'être le premier algorithme à être accusé de racisme, et ne sera certainement pas le dernier. La fonction de saisie semi-automatique de Google - qui repose sur un algorithme qui analyse les recherches précédentes des autres utilisateurs pour essayer de deviner votre requête - est régulièrement réprimandée pour avoir braqué les projecteurs sur les sentiments racistes, sexistes et autres sentiments régressifs qui, autrement, resteraient cachés dans les coins les plus sombres de l'Internet et notre psychisme.

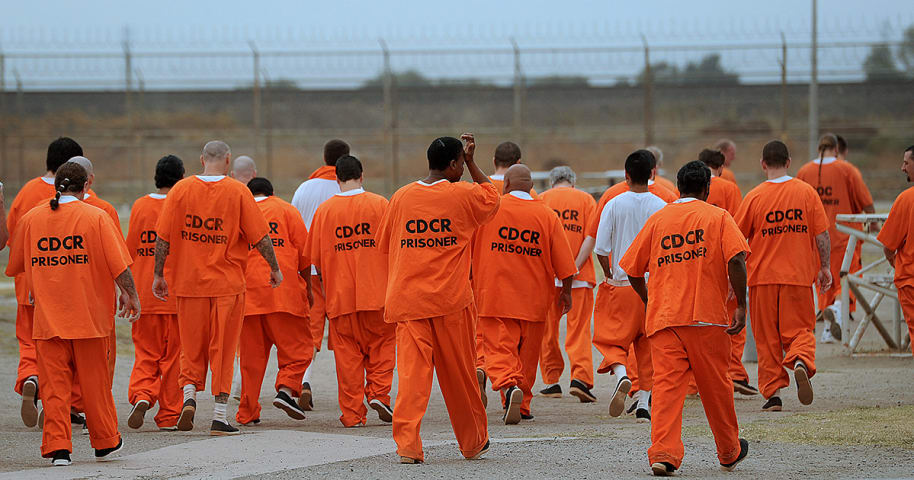

Mais alors que les applications malveillantes ou les suggestions de saisie semi-automatique déconcertantes sont à la fois éphémères et potentiellement sensibles au tollé public, on peut difficilement en dire autant de l'empiétement insidieux des algorithmes de prise de décision dans le fonctionnement de notre système juridique, où ils jouent souvent un rôle essentiel dans la détermination le sort des accusés – et, comme FaceApp, affichent souvent une préférence pour les sujets blancs. Mais le problème est plus que superficiel. Le problème est que nous ne pouvons pas échapper au long bras de l'h