Incidents associés

Se confronter à un algorithme était une bataille sans précédent à laquelle Larkin Seiler avait été confronté.

En raison de sa paralysie cérébrale, cet homme de 40 ans, qui travaille dans une société d'ingénierie environnementale et adore assister à des matchs sportifs de presque tous les types, dépend de l'aide de son aide-soignant à domicile pour des choses que la plupart des gens tiennent pour acquises, comme les repas et baignade.

Chaque matin, l’intervenante de Seiler le sort du lit, le place dans son fauteuil roulant et l’aide à s’habiller pour la journée de travail à venir. Le travailleur revient à l'heure du déjeuner pour aider à déjeuner et à aller aux toilettes, puis revient le soir.

Mais lorsque l’Idaho, l’État d’origine de Seiler, a créé un système automatisé – un algorithme – pour répartir l’aide aux soins à domicile pour les personnes handicapées en 2008, cela a réduit de moitié son budget pour les soins à domicile. Il était confronté au fait de ne même pas pouvoir utiliser les toilettes à des intervalles raisonnables.

«C'était horrible», a déclaré Seiler, qui craignait d'être placé de force dans une institution. « Je ne peux même pas me lever le matin si je n’ai pas d’aide. Cela prendrait toute ma liberté et mon indépendance.

Comme Seiler, des milliers de personnes handicapées et âgées dans plus d’une douzaine d’États ont dû lutter contre des décisions prises par un algorithme pour obtenir les services de soutien dont elles ont besoin pour rester chez elles au lieu d’être institutionnalisées.

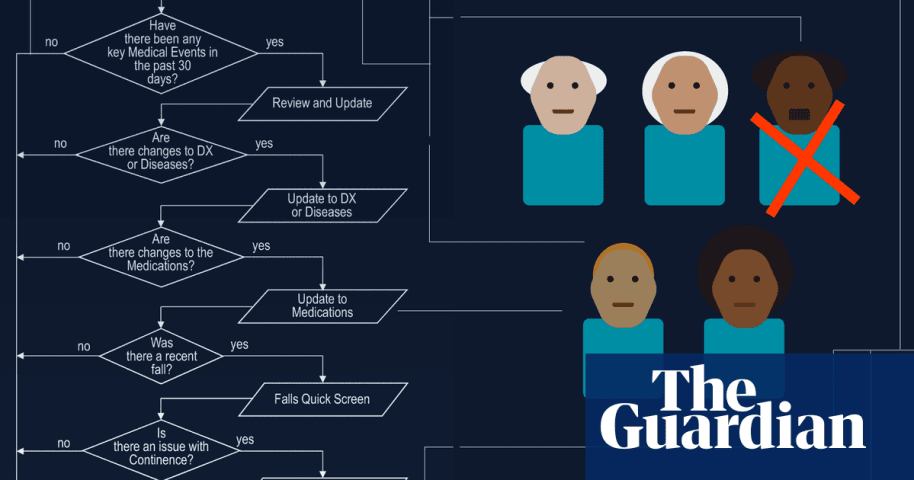

Les coupes ont touché les personnes âgées à faible revenu et les personnes handicapées en Pennsylvanie, en Iowa, à New York, au Maryland, au New Jersey, en Arkansas et dans d'autres États, après que les algorithmes soient devenus les arbitres de la manière dont leurs soins de santé à domicile étaient alloués – remplaçant ainsi les jugements qui étaient auparavant principalement réalisés par des infirmières et des travailleurs sociaux.

Larkin Seiler, atteint de paralysie cérébrale, dépend de l'aide de sa personne de soutien à domicile pour les choses que la plupart des gens tiennent pour acquises, comme les repas et le bain. Photographie : Le Gardien

À Washington DC, « au pire, nous avons eu des clients qui sont décédés parce que leurs services ont été supprimés et qu'ils ne recevaient pas les soins dont ils avaient besoin », a déclaré Tina Smith Nelson, avocate superviseure chez AARP Legal Counsel for the Elderly. sur les effets d'un nouveau système algorithmique introduit en 2018. Plus de 300 personnes âgées ont dû déposer un recours administratif après que leurs soins à domicile ont été supprimés par un nouveau système algorithmique.

"Je pense qu'en tant que société, nous évoluons dans un territoire troublant lorsque nous comptons uniquement sur des algorithmes et des données pour déterminer les besoins en matière de soins de santé", a déclaré Nelson. « Nous réduisons l’humanité d’une personne à un nombre. »

Kevin De Liban, un avocat de l'Aide juridique de l'Arkansas, a commencé à lutter contre les coupes budgétaires après que des patients gravement handicapés ont commencé à appeler « en masse » en 2016. « La souffrance humaine était tout simplement immense », a-t-il déclaré. « Il y avait des gens qui gisaient dans leurs propres déchets. Il y avait des gens qui avaient des escarres parce qu’il n’y avait personne pour les soigner. Il y avait des gens qui étaient enfermés, des gens qui sautaient des repas. C’était tout simplement une souffrance humaine incalculable.

Pour Tammy Dobbs, résidente de l'Arkansas, la vie est devenue presque insupportable après que son État a introduit un algorithme qui a décimé la quantité de soins qu'elle a reçus en 2016.

Dobbs, 61 ans, a besoin d'aide pour monter dans son fauteuil roulant et n'a plus l'usage de ses mains à cause de paralysie cérébrale, mais tout à coup, personne n'était là pour l'aider à utiliser les toilettes.

«Les choses étaient difficiles parce que je devais me programmer pour aller aux toilettes à certaines heures», a déclaré Dobbs. « J’ai dû retarder la prise d’un bain tous les jours parce que je n’avais pas le temps. C'était juste mauvais.

La situation reflète une réalité qui affecte de plus en plus tous les utilisateurs des soins de santé américains : des algorithmes – allant des graphiques rudimentaires de type « si-alors » aux systèmes sophistiqués d’intelligence artificielle – sont déployés pour prendre toutes sortes de décisions concernant les personnes qui reçoivent des soins.

Les responsables gouvernementaux ont présenté les systèmes de prise de décision algorithmiques comme un moyen de garantir que les prestations soient réparties de manière équitable, d’éliminer les préjugés humains et d’éradiquer la fraude.

Mais les défenseurs affirment que le fait que des programmes informatiques décident du niveau d’aide que les personnes vulnérables peuvent obtenir est souvent arbitraire – et dans certains cas carrément cruel.

Le problème sous-jacent, disent les experts, est que ni les États ni le gouvernement fédéral ne fournissent suffisamment de fonds pour permettre aux personnes ayant besoin d’une assistance médicale de rester en sécurité chez elles – même si ces programmes finissent généralement par être beaucoup moins coûteux que le placement des personnes en institution. Les algorithmes ont recours à la répartition des miettes disponibles.

L’expérience de Dobbs en Arkansas a révélé la prise de décision arbitraire qui peut affecter les soins de santé de millions d’Américains lorsque des algorithmes sont utilisés sans examen minutieux.

Pendant des années, elle a reçu huit heures d'aide par jour d'une aide-ménagère pour tout, depuis le lever du lit jusqu'aux repas.

Malgré sa paralysie cérébrale, Dobbs a réussi à vivre seule et à rester active en écrivant de la poésie, en jardinant et en pêchant.

Mais, en 2016, un évaluateur des besoins en soins de santé s’est présenté avec un ordinateur portable et a tapé les réponses de Dobbs à une longue batterie de questions. Elle a ensuite consulté l'ordinateur et informé superficiellement Dobbs qu'elle ne recevrait qu'environ quatre heures d'aide par jour.

«J'ai juste commencé à devenir fou furieux», a déclaré Dobbs, dont l'histoire a été précédemment rapportée par le bord. « J’ai dit ‘Non, non, je ne peux pas faire ça !’ »

"Mais l'intervieweur a dit : "Désolé, c'est ce que l'ordinateur me montre"", a-t-elle déclaré.

Dobbs a déclaré qu'elle craignait de finir par être institutionnalisée.

« J’ai connu des gens qui ont été placés dans des maisons de retraite et j’ai vu comment ils étaient traités, et je n’y vais pas », a-t-elle déclaré.

Ce n’est que lorsque De Liban a commencé à démêler le nouveau programme informatique derrière les coupes dans les soins de santé qu’il est devenu clair qu’un algorithme était en jeu.

Chaque année, une infirmière se rendait au domicile de chaque patient pour administrer une évaluation informatisée : 286 questions couvrant tout, de la santé mentale à l'aide dont ils ont besoin dans leurs activités quotidiennes comme manger ou gérer leurs finances personnelles.

Ensuite, un outil algorithmique a classé les patients selon différents niveaux de besoins. Chaque niveau s'est vu attribuer un nombre standard d'heures de soins.

L’équipe juridique de De Liban a révélé des failles dans l’algorithme devant le tribunal. Il s’est avéré, a déclaré De Liban, que les calculs n’avaient pas pris en compte des éléments tels que le fait qu’un patient souffrait de paralysie cérébrale ou de diabète.

Un seul point dans le système de notation – par exemple un point ajouté parce que le patient a eu de la fièvre au cours des trois derniers jours ou des escarres ouvertes – pourrait faire une énorme différence dans le nombre d’heures qu’il a reçues pour l’année entière.

Il est difficile de faire en sorte que les machines prennent des décisions équitables concernant la vie des gens

D'autres problèmes provenaient d'erreurs commises par les évaluateurs. Dans un cas, une personne doublement amputée a été considérée comme n'ayant pas de problème de mobilité, car elle pouvait se déplacer en fauteuil roulant.

« Lorsque l’algorithme fonctionnait, il était, à nos yeux, assez irrationnel », a déclaré De Liban.

Les responsables de l’État de l’Arkansas n’ont pas répondu à une demande de commentaires.

Le concepteur de l’algorithme, le professeur émérite Brant Fries de l’Université du Michigan, a reconnu que le système n’est pas conçu pour calculer le nombre d’heures de soins dont les gens ont réellement besoin. Au lieu de cela, il a déclaré qu’il avait été scientifiquement calibré pour allouer équitablement des ressources rares.

« Nous disons que nous prendrons quelle que soit la taille du gâteau et que nous le diviserons de la manière scientifique, de la manière la plus équitable possible, pour les individus concernés », a-t-il expliqué. "... Nous ne disons pas que la taille du gâteau est correcte."

Fries, qui a commencé à développer l’algorithme il y a plus de 30 ans, a reconnu que les programmes ne répondent pas à ce que beaucoup considèrent comme une sous-utilisation chronique des États-Unis dans les maisons de retraite et les soins à domicile pour les populations à faible revenu, âgées et handicapées.

« Si vous n’avez pas assez de ressources, alors ces gens n’auront pas assez d’argent et ils porteront peut-être des vêtements sales – mais tout le monde aussi », a-t-il déclaré. « Une vérole sur votre maison si vous ne prodiguez pas suffisamment de soins. Mais quel que soit l’argent disponible, je le divise de manière plus équitable.

Après des années de batailles judiciaires, l'utilisation du système algorithmique par l'Arkansas a finalement été rejetée en 2018. Une décision de la Cour suprême de l'État a déclaré que cela causait aux participants un « préjudice irréparable » et qu'ils « ne se sont pas baignés, ont manqué des traitements et des tours, ont été confrontés à un risque accru de chute, sont devenus plus isolés et ont souffert de conditions médicales aggravées en raison de leur manque de soins ».

Dobbs a donc pu obtenir les soins dont elle a besoin pour rester dans la joyeuse maison en planches blanches qu'elle loue dans un quartier boisé du village de Cherokee, en Arkansas.

« Il est difficile de faire en sorte que les machines prennent des décisions équitables concernant la vie des gens », a-t-elle déclaré. «C'est juste un ordinateur. Il ne voit pas notre situation. Il ne voit pas l’individu.

Mais dans tout le pays, la bataille continue.

À Washington DC, en Pennsylvanie et dans l'Iowa, les avocats des services juridiques sont confrontés à des appels de personnes âgées se plaignant d'avoir perdu leurs soins à cause des algorithmes récemment adoptés dans ces États. Dans quelques cas en Pennsylvanie, les patients se sont retrouvés avec si peu d'aide qu'il a fallu faire appel aux services de protection pour s'assurer qu'ils n'étaient pas négligés, selon Laval Miller-Wilson, directeur du [Health](https:// www.theguardian.com/society/health) Projet de droit.

Dans le Missouri, les tentatives visant à recueillir l'avis du public pour développer un nouveau système durent depuis des années, les défenseurs des personnes handicapées craignant que des milliers de personnes ne perdent leur éligibilité. Après des années de travail sur le développement d'un algorithme permettant de décider qui est éligible aux soins à domicile, l'État a décidé de conserver essentiellement les clients existants pour les deux prochaines années, a déclaré Melanie Highland, directrice des services aux personnes âgées et aux personnes handicapées de l'État. Mais elle a reconnu que certains pourraient finir par perdre leur éligibilité aux services après cette période.

Les défenseurs des personnes handicapées affirment que la décision algorithmique en matière de soins ne tient pas compte des subtilités de la situation des individus. Ils craignent que les décisions soient prises dans une boîte noire, sans que les patients n'aient aucun moyen de savoir pourquoi, ce qui rendrait les décisions difficiles à contester.

"L'idée d'une machine libérée des scrupules personnels des individus peut sembler séduisante", a déclaré Lydia XZ Brown, avocate et militante des droits des personnes handicapées au Center for Democracy and Technology, également autiste. "Cependant, ce que les gens oublient, c'est que lorsque vous faites confiance à une machine, vous faites toujours confiance aux personnes qui la conçoivent et à celles qui l'utilisent pour agir de manière appropriée, éthique ou responsable."

L’algorithme qui a supprimé les soins de Seiler en 2008 a été déclaré inconstitutionnel par le tribunal en 2016, mais Seiler et d’autres militants du handicap sont toujours engagés dans un processus supervisé par le tribunal pour tenter de le remplacer.

Et depuis le début du procès, le budget des soins à domicile de Seiler a été ramené à son niveau initial et y est gelé. Pour l’instant, il est en mesure d’embaucher l’assistance dont il a besoin. Il craint que sa situation de vie ne soit à nouveau menacée par le nouvel algorithme que l'Idaho développe.

« L’idée de devoir aller dans une maison de retraite est la pire des choses », a-t-il déclaré. "C'est un cauchemar."

- The Guardian souhaite remercier Elizabeth Edwards du National Health Law Program, Richard Eppink de l'Idaho ACLU, Michele Gilman de l'Université de Baltimore et autres professionnels de l'aide juridique qui ont aidé à la couverture de cette histoire.