Incidents associés

Porcha Woodruff était enceinte de huit mois lorsque la police de Détroit, dans le Michigan, est venue l'arrêter pour vol de voiture et vol. Elle préparait ses deux enfants pour l'école lorsque six policiers ont frappé à sa porte et lui ont présenté un mandat d'arrêt. Elle pensait que c'était une farce.

« Vous plaisantez, détournement de voiture ? Voyez-vous que je suis enceinte de huit mois ? » lit-on dans le procès intenté par Woodruff contre la police de Détroit. Elle a envoyé ses enfants à l’étage pour dire à son fiancé que « maman va en prison ».

Elle a été détenue et interrogée pendant 11 heures, puis libérée moyennant une caution de 100 000 $. Elle s'est immédiatement rendue à l'hôpital, où elle a été soignée pour déshydratation.

Woodruff a découvert plus tard qu'elle était la dernière victime d'une fausse identification par reconnaissance faciale. Après que son image ait été incorrectement associée à une séquence vidéo d'une femme à la station-service où le carjacking a eu lieu, sa photo a été montrée à la victime dans une séance de photos. Selon le procès, la victime aurait choisi la photo de Woodruff comme étant la femme associée à l’auteur du vol. Nulle part dans le rapport de l’enquêteur il n’est indiqué que la femme dans la séquence vidéo était enceinte.

Un mois plus tard, les accusations ont été abandonnées faute de preuves suffisantes.

Porcha Woodruff, faussement arrêtée, début août. Photographie : Carlos Osorio/AP

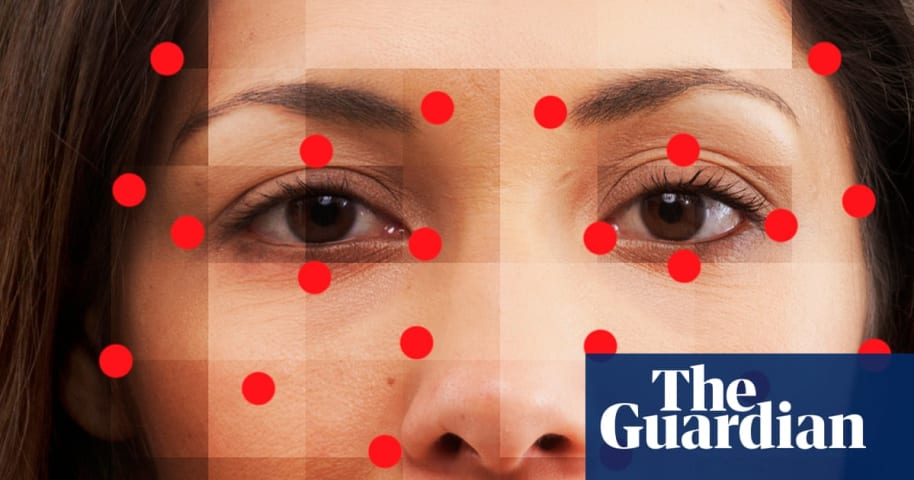

L’affaire Woodruff est le troisième cas connu d’arrestation effectuée en raison d’une fausse reconnaissance faciale par la police de Détroit – et le sixième cas aux États-Unis. Les six personnes faussement arrêtées sont noires. Pendant des années, les experts et défenseurs de la vie privée ont tiré la sonnette d’alarme sur l’incapacité de la technologie à identifier correctement les personnes de couleur et ont mis en garde contre les violations de la vie privée et les dangers d’un système qui prétend identifier toute personne par son image ou son visage. Pourtant, les forces de l'ordre et les agences gouvernementales aux États-Unis et dans le monde continuent de conclure des contrats avec diverses sociétés de reconnaissance faciale de [Amazon's Rekognition](https://www.theguardian.com/technology/2020/jun/10/amazon-rekognition- software-police-black-lives-matter) à Clearview AI.

Des pays comme la France, l’Allemagne, la Chine et l’Italie ont utilisé une technologie similaire. En décembre, il a été révélé que la police chinoise avait utilisé des données mobiles et des visages pour suivre les manifestants. Plus tôt cette année, les législateurs français ont adopté un projet de loi donnant à la police le pouvoir d'utiliser l'IA dans les espaces publics avant les Jeux olympiques de Paris 2024, ce qui en fait le premier pays de l'UE à approuver l'utilisation de la surveillance par l'IA ([bien qu'elle l'interdise](https : //www.theguardian.com/world/2023/may/18/french-courts-approval-of-olympics-ai-surveillance-plan-fuels-privacy-concerns) l'utilisation de la reconnaissance faciale en temps réel). Et l'année dernière, Wired a fait état de propositions controversées visant à permettre aux forces de police de l'UE de partager des bases de données de photos contenant des images de visages des gens – décrit par un conseiller politique en matière de droits civiques comme « l'infrastructure de surveillance biométrique la plus étendue que nous ayons jamais vue dans le monde ».

À Detroit, le procès de Woodruff a suscité de nouveaux appels aux États-Unis en faveur d’une interdiction totale de l’utilisation de la reconnaissance faciale par la police et les forces de l’ordre. La police de Détroit a déployé de nouvelles limitations sur l'utilisation de reconnaissance faciale dans les jours qui ont suivi le dépôt de la plainte, notamment en interdisant l'utilisation d'images de reconnaissance faciale dans une file d'attente et en exigeant qu'un détective non impliqué dans l'affaire se charge de montrer les images à la personne à qui l'on demande d'identifier une personne. Mais les activistes estiment que cela ne suffit pas.

"La seule politique qui empêchera les fausses arrestations par reconnaissance faciale est une interdiction totale", a déclaré Albert Fox Cahn du Surveillance Technology Oversight Project, une organisation à but non lucratif. « Malheureusement, pour chaque erreur de reconnaissance faciale dont nous avons connaissance, il y a probablement des dizaines d’Américains qui restent accusés à tort et n’obtiennent jamais justice. Ces systèmes racistes et sujets aux erreurs n’ont tout simplement pas leur place dans une société juste.

La police a utilisé la technologie de reconnaissance faciale pour surveiller et identifier les manifestants de Black Lives Matter. Photographie : Kathy Willens/AP

Alors que les gouvernements du monde entier s’attaquent à l’IA générative, les méfaits de longue date de l’utilisation actuelle de l’IA, comme ceux des systèmes de surveillance, sont souvent passés sous silence ou totalement laissés de côté. Même dans le cas de la loi européenne sur l’IA, qui a été introduite avec plusieurs clauses proposant des limitations aux utilisations à haut risque de l’IA comme la reconnaissance faciale, [selon certains experts](https://www.theguardian.com/technology/2023/jun /13/artificial-intelligence-us-regulation), le battage médiatique autour de l’IA générative a en partie détourné l’attention de ces discussions. "Nous avons eu beaucoup de chance d'avoir mis beaucoup de ces choses à l'ordre du jour avant ce battage médiatique sur l'IA et l'IA générative, le boom de ChatGPT", m'a dit Sarah Chander, conseillère politique principale à l'organisation internationale de défense des droits numériques européens, m'a dit en juin. . "Je pense que ChatGPT brouille beaucoup les choses en termes de types de préjudices dont nous parlons réellement ici."

Tout comme d’autres formes de systèmes basés sur l’IA, la reconnaissance faciale est aussi efficace que les données qui y sont introduites et, en tant que telle, reflète et perpétue souvent les préjugés de ceux qui les construisent – un problème, comme l’a noté Amnesty International, car les images utilisés pour entraîner de tels systèmes sont majoritairement composés de visages blancs. Les systèmes de reconnaissance faciale ont les [taux de précision les plus faibles](https://sitn.hms.harvard.edu/flash/2020/racial-discrimination-in-face-recognition-technology/#:~:text=Face%20recognition%20algorithms %20se vantent%20élevé et%2018%2D30%20ans%20vieux.) lorsqu'il s'agit d'identifier les personnes noires, de sexe féminin et âgées de 18 à 30 ans, alors que les faux positifs « existent largement », selon une étude du Institut national des normes et de la technologie. En 2017, le NIST a examiné 140 algorithmes de reconnaissance faciale et a constaté que « les taux de faux positifs sont les plus élevés chez les populations d’Afrique de l’Ouest et de l’Est et d’Asie de l’Est, et les plus faibles chez les individus d’Europe de l’Est. Cet effet est généralement important, avec un facteur 100 de faux positifs supplémentaires entre les pays.

Mais même si la technologie de reconnaissance faciale était exactement précise, elle ne serait pas plus sûre, affirment les critiques. Les groupes de défense des libertés civiles affirment que la technologie peut potentiellement créer un réseau de surveillance vaste et illimité qui brise tout semblant d'intimité dans les espaces publics. Les gens peuvent être identifiés partout où ils vont, même si ces endroits sont ceux où ils pratiquent des comportements protégés par la Constitution, comme les manifestations et les centres religieux. À la suite de l'inversion des protections fédérales contre l'avortement par la Cour suprême des États-Unis, il est récemment dangereux pour ceux qui recherchent des soins reproductifs. Certains systèmes de reconnaissance faciale, comme Clearview AI, utilisent également des images récupérées sur Internet sans consentement. Ainsi, les images des réseaux sociaux, les portraits professionnels et toute autre photo diffusée dans les espaces numériques publics peuvent être utilisés pour former des systèmes de reconnaissance faciale qui sont à leur tour utilisés pour criminaliser les personnes. Clearview a été interdit dans plusieurs pays européens, dont l'Italie et l'Allemagne, et il lui est interdit de vendre des données de reconnaissance faciale à des entreprises privées aux États-Unis.

Quant à Woodruff, elle réclame des dommages et intérêts financiers. Le chef de la police de Détroit, James E White, a déclaré que le département était en train d'examiner le procès et qu'il était « très préoccupant ».

"Je ne pense pas que quiconque devrait subir quelque chose comme ça, être faussement accusé", a déclaré Woodruff [au Washington Post](https://www.washingtonpost.com/nation/2023/08/07/michigan- porcha-woodruff-arrestation-reconnaissance-faciale/). "Nous ressemblons tous à quelqu'un."