Incidents associés

Prédire l'avenir n'est pas seulement l'affaire des diseurs de bonne aventure ou des experts des médias. Les algorithmes prédictifs, basés sur de vastes ensembles de données et de statistiques, ont dépassé les opérations de vente en gros et au détail, comme le savent tous les acheteurs en ligne. Et au cours des dernières années, des algorithmes ont été utilisés pour automatiser la prise de décision concernant les prêts bancaires, les admissions à l'école, l'embauche et, tristement célèbre, pour prédire la récidive - la probabilité qu'un accusé commette un autre crime au cours des deux prochaines années.

COMPAS, qui signifie Correctional Offender Management Profiling for Alternative Sanctions, est un tel programme et a été désigné par ProPublica plus tôt cette année comme étant raciste. COMPAS utilise 137 variables dans son algorithme de notation exclusif et non publié ; la race ne fait pas partie de ces variables. ProPublica a utilisé un ensemble de données d'accusés dans le comté de Broward, en Floride. Les données comprenaient des données démographiques, des antécédents criminels, un score COMPAS [1] et les actions criminelles au cours des deux années suivantes. ProPublica a ensuite croisé ces données avec la race des accusés. Leurs conclusions sont généralement acceptées par toutes les parties

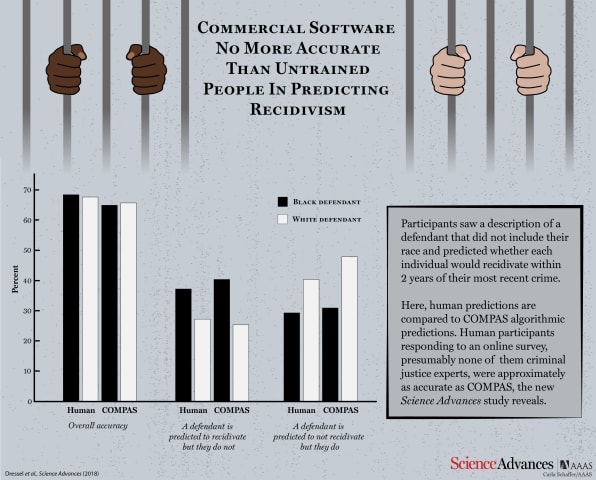

COMPAS est modérément précis dans l'identification de la récidive blanche et noire environ 60 % du temps.

Les erreurs de COMPAS reflètent des préjugés raciaux apparents. Les Noirs sont plus souvent identifiés à tort comme des risques de récidive (statistiquement un faux positif) et les Blancs plus souvent à tort identifiés comme n'étant pas à risque (un faux négatif).

La « pénalité » pour être classé à tort comme un risque plus élevé est plus susceptible d'être une punition plus sévère. Être classé à tort comme un risque plus faible, c'est comme une carte «Sortez de prison».

Comme vous pouvez vous en douter, une importante controverse s'en est suivie, principalement dans une bataille académique sur les mesures statistiques ou les calculs qui décrivaient plus précisément le biais. Une étude dans Science Advances revisite la discussion et arrive à une conclusion différente.

L'étude

Dans la présente étude, l'évaluation par les humains a été comparée à celle de COMPAS en utilisant cet ensemble de données du comté de Broward. Les humains ont été trouvés sur Amazon's Mechanical Turk [2], ont payé un dollar pour participer et un bonus de 5 $ s'ils étaient précis plus de 60% du temps.

Les humains étaient tout aussi précis que l'algorithme (62 contre 65 %)

Les erreurs de l'algorithme et des humains étaient identiques, surestimant (faux positifs) la récidive pour les accusés noirs et sous-estimant (faux négatifs) pour les accusés blancs.

Humains COMPAS Noir % Blanc % Noir % Blanc % Précision* 68,2 67,6 64,9 65,7 Faux positifs 37,1 27,2 40,4 25,4 Faux négatifs 29,2 40,3 30,9 47,9

- La précision est la somme des vrais positifs et des vrais négatifs statistiquement parlant

Les évaluateurs humains n'ont utilisé que sept variables, et non les 137 de COMPAS. [3] Cela suggère que l'algorithme était inutilement complexe, du moins pour déterminer le risque de récidive. En fait, les chercheurs ont découvert que seules deux variables, l'âge du défendeur et le nombre de condamnations antérieures, étaient aussi précises que les prédictions de COMPAS.

Plus intéressante est la découverte que lorsque les évaluateurs humains ont reçu les informations supplémentaires concernant la race du défendeur, cela n'a eu aucun impact. Ils étaient tout aussi précis et démontraient la même disparité raciale dans les faux positifs et négatifs. La race était un facteur de confusion associé, mais ce n'était pas la cause de la différence statistique. Le récit de ProPublica sur les préjugés raciaux était incorrect.

Les algorithmes sont des modèles statistiques impliquant des choix. Si vous optimisez pour trouver tous les vrais positifs, vos faux positifs augmenteront. Réduisez votre taux de faux positifs et les faux négatifs augmenteront. Voulons-nous incarcérer plus ou moins ? Le MIT Technology Review le dit ainsi.

« Sommes-nous principalement intéressés à prendre le moins de chances possible que quelqu'un saute la caution ou récidive ? Quels compromis devrions-nous faire pour garantir la justice et réduire les énormes coûts sociaux de l'emprisonnement ? »

COMPAS est destiné à servir d'aide à la décision. Le but des 137 variables est de créer une variété d'échelles décrivant la toxicomanie, l'environnement, les opportunités criminelles, les associés, etc. Son rôle est d'aider les humains de notre système judiciaire à déterminer une peine appropriée. [4] Aucune des études, à ma connaissance, ne s'est penchée sur les peines prononcées. La recherche actuelle se termine ainsi :

"Lorsque vous envisagez d'utiliser un logiciel tel que COMPAS pour prendre des décisions qui affecteront de manière significative la vie et le bien-être des accusés, il est utile de se demander si nous mettrions ces décisions entre les mains de personnes aléatoires qui répondent à une enquête en ligne parce que, Au final, les résultats de ces deux approches semblent indiscernables.

La réponse est non. COMPAS et les algorithmes similaires sont des outils, pas un remplacement POUR le jugement humain. Ils facilitent mais n'automatisent pas. ProPublica a raison de dire que les décisions algorithmiques doivent être comprises par leurs utilisateurs humains et nécessitent une validation et un raffinement continus. Mais le récit de ProPublica, selon lequel les forces du mal étaient responsables d'un algorithme raciste, n'est pas vrai.

[1] COMPAS est noté sur une échelle de 1 à 10, avec des scores plus