Incidents associés

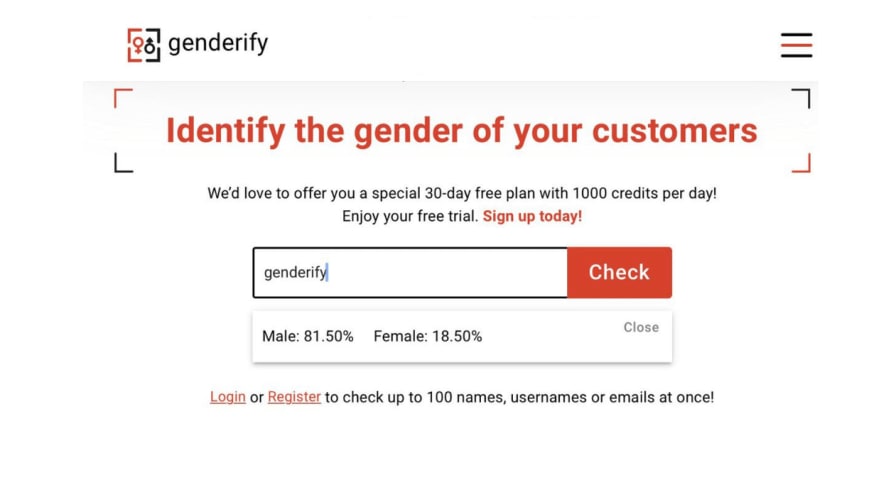

Quelques heures seulement après avoir fait des vagues et déclenché une réaction violente sur les réseaux sociaux, Genderify – un outil alimenté par l'IA conçu pour identifier le sexe d'une personne en analysant son nom, son nom d'utilisateur ou son adresse e-mail – a été complètement fermé.

Lancée la semaine dernière sur le site Web de présentation de nouveaux produits Product Hunt, la plate-forme a été présentée comme une "solution unique qui est la seule de son genre disponible sur le marché", permettant aux entreprises "d'obtenir des données qui vous aideront avec l'analyse, l'amélioration de votre données client, segmentation de votre base de données marketing, statistiques démographiques », selon le créateur de Genderify Arevik Gasparyan.

Les critiques animées de Genderify ont rapidement décollé sur Twitter, beaucoup décriant ce qu'ils percevaient comme des préjugés intégrés. Entrer le mot « scientifique », par exemple, a donné une probabilité de 95,7 % pour que la personne soit un homme et seulement 4,3 % pour une femme. Ali Alkhatib, chercheur au Center for Applied Data Ethics, a tweeté que lorsqu'il a tapé "professeur", Genderify a prédit une probabilité de 98,4% pour les hommes, tandis que le mot "stupide" a renvoyé une prédiction de 61,7% pour les femmes. Dans d'autres cas, l'ajout d'un préfixe "Dr" aux noms féminins fréquemment utilisés a entraîné des évaluations biaisées par les hommes.

Le site Web Genderify comprenait une section expliquant comment il recueillait ses données à partir de sources telles que des informations gouvernementales et des réseaux sociaux. Avant la fermeture, l'équipe de Genderify a tweeté "Depuis que l'IA s'est entraînée sur les données existantes, c'est un excellent exemple pour montrer à quel point les données disponibles autour de nous sont biaisées."

Les problèmes liés au genre et à d'autres préjugés dans les systèmes d'apprentissage automatique (ML) ne sont pas nouveaux et ont soulevé des inquiétudes, car de plus en plus de systèmes potentiellement biaisés sont transformés en applications du monde réel. La co-fondatrice de l'AI Now Institute, Meredith Whittaker, a semblé choquée que Genderify soit parvenue à une publication publique, tweetant : « Putain de moyen. Sommes-nous trollés ? Est-ce un psyop destiné à distraire le monde de la technologie et de la justice ? Est-ce déjà le jour du poisson d'avril de la technologie grincheuse? Ou est-ce que nommer le problème encore et encore ne le résout pas automatiquement si le pouvoir et le profit dépendent du fait qu'il reste non résolu ? »

Le mois dernier, la directrice de la recherche sur l'apprentissage automatique chez NVIDIA et la professeure de l'Institut de technologie de Californie Anima Anandkumar ont tweeté ses inquiétudes lorsque l'institut de recherche OpenAI basé à San Francisco a publié une API qui exécute des modèles GPT-3 qui, selon elle, produisaient des textes « scandaleusement biaisés ». ”

OpenAI a répondu que «les modèles génératifs peuvent afficher des sorties nuisibles manifestes et diffuses, telles que des propos racistes, sexistes ou autrement pernicieux», et que «c'est un problème à l'échelle de l'industrie, ce qui permet aux organisations individuelles d'abdiquer ou de différer facilement leurs responsabilités. ” La société a souligné que "OpenAI ne le fera pas" et a publié des directives d'utilisation de l'API avec des heuristiques pour développer des applications en toute sécurité. L'équipe OpenAI s'est également engagée à examiner les candidatures avant leur mise en ligne.

Il y a un adage dans la communauté informatique : « Garbage in, garbage out ». Les modèles alimentés par des données biaisées auront tendance à produire des prédictions biaisées, et le problème est que nombre de ces modèles défectueux peuvent être transformés en applications et mis sur le marché sans examen approprié.

À la suite de la débâcle de Genderify, de nombreux membres de la communauté ML réfléchissent à ce qui n'a pas fonctionné et à la manière d'y remédier. Le programmeur de recherche de l'Université de Californie du Sud, Emil Hvitfeldt, a lancé un projet GitHub, Genderify Pro, qui soutient que "l'attribution des sexes est intrinsèquement inexacte" et "s'il est important de connaître le sexe de quelqu'un, demandez-lui".