Incidents associés

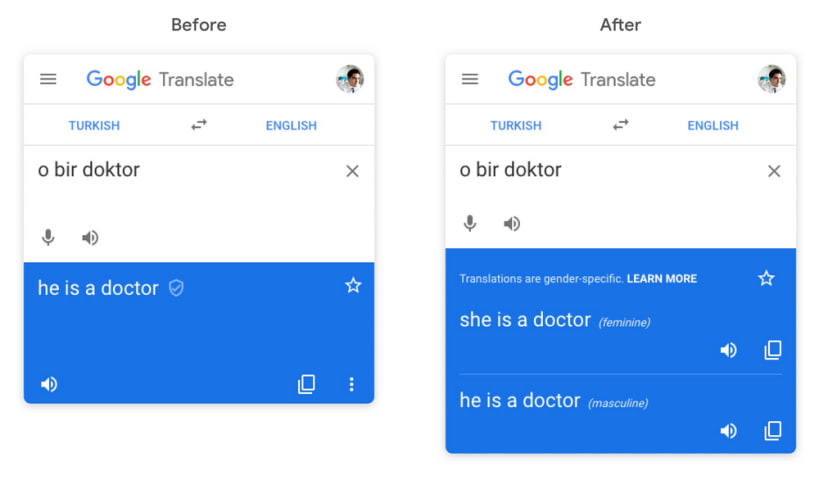

Google s'efforce de réduire les préjugés sexistes perçus dans Google Translate, a-t-il annoncé aujourd'hui. À partir de cette semaine, les utilisateurs qui traduisent des mots et des phrases dans les langues prises en charge obtiendront des traductions féminines et masculines ; « o bir doktor » en turc, par exemple, donne désormais « she is a doctor » et « he is a doctor » en anglais.

Actuellement, les traductions de l'anglais vers le français, l'italien, le portugais ou l'espagnol sont prises en charge. Les traductions de phrases et de phrases du turc vers l'anglais, comme dans l'exemple ci-dessus, montreront également les deux équivalents de genre. (En turc, le pronom "o" couvre tous les types de troisième personne du singulier.)

James Kuczmarski, chef de produit chez Google Translate, a déclaré que le travail avait déjà commencé sur les traductions de genre non binaires.

"Au cours de cette année, Google s'est efforcé de promouvoir l'équité et de réduire les biais dans l'apprentissage automatique", a-t-il écrit dans un article de blog. "À l'avenir, nous prévoyons d'étendre les traductions sexospécifiques à d'autres langues, de les lancer sur d'autres surfaces de traduction comme nos applications iOS et Android, et de lutter contre les préjugés sexistes dans des fonctionnalités telles que la saisie semi-automatique des requêtes."

L'annonce d'aujourd'hui intervient peu de temps après que Google a bloqué Smart Compose, une fonctionnalité de Gmail qui suggère automatiquement des phrases aux utilisateurs au fur et à mesure qu'ils tapent, en suggérant des pronoms basés sur le genre. Et cela fait suite à des publications sur les réseaux sociaux prétendant montrer les préjugés sexistes des applications de traduction automatique.

Les utilisateurs ont noté que des mots comme "ingénieur" et "fort" dans certaines langues étrangères étaient plus susceptibles d'être associés à des mots masculins correspondants en anglais - "o bir muhendis" dans Google Translate est devenu "il est ingénieur", tandis que "o bir hemsire » a été traduit par « elle est infirmière ».) C'est loin d'être le seul exemple — les claviers prédictifs d'Apple et de Google proposent le « policier » genré pour compléter « police » et « vendeur » pour « ventes ». Et quand Bing de Microsoft traduit « la table est molle » en allemand, elle revient au féminin « die Tabelle », qui fait référence à une table de chiffres.

C'est un problème d'entraînement à l'IA, a expliqué Kuczmarski. L'incorporation de mots - une technique de formation algorithmique courante qui consiste à lier des mots à un vecteur utilisé pour calculer la probabilité d'une paire de langues d'un mot donné - capte inévitablement, et au pire amplifie, les biais implicites dans le texte source et le dialogue. Une étude de 2016 a révélé que les intégrations de mots dans les articles de Google Actualités avaient tendance à présenter des stéréotypes de genre féminins et masculins.

"Google Translate apprend à partir de centaines de millions d'exemples déjà traduits sur le Web", a écrit Kuczmarski. « Historiquement, il n'a fourni qu'une seule traduction pour une requête, même si la traduction pouvait avoir une forme féminine ou masculine. Ainsi, lorsque le modèle a produit une traduction, il a reproduit par inadvertance des préjugés sexistes qui existaient déjà. Par exemple : le masculin serait biaisé pour des mots comme « fort » ou « docteur » et le féminin pour d'autres mots, comme « infirmière » ou « beau ». »

Une approche non sexiste de la traduction linguistique fait partie des efforts plus larges de Google pour atténuer les préjugés dans les systèmes d'IA. La société Mountain View utilise des tests développés par son équipe d'éthique de l'IA pour découvrir les préjugés, et a interdit les jurons, les insultes raciales et les mentions de rivaux commerciaux et d'événements tragiques de ses technologies prédictives.