Incidents associés

Amazon Alexa arrive sur une liste coquine avec NSFW Tirade devant un enfant

proche

Tout ce qu'il voulait, c'était entendre une chanson enfantine.

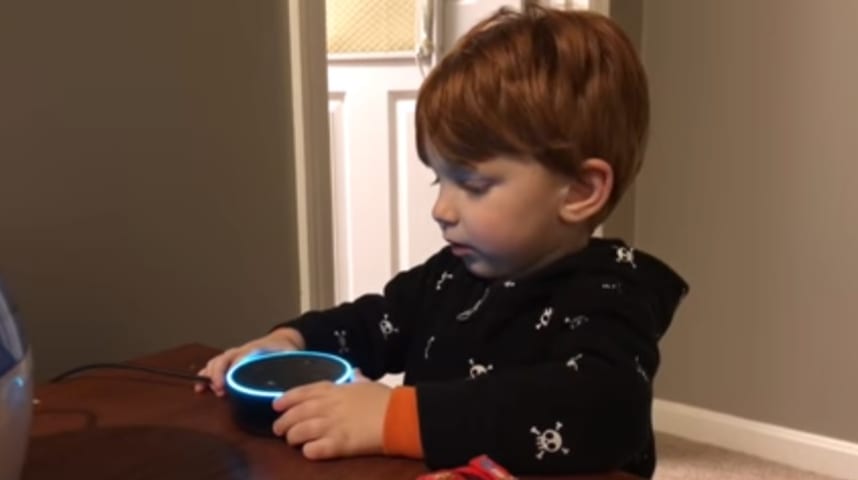

Une vidéo YouTube publiée le 29 décembre dernier est devenue virale avec 1,2 million de vues à ce jour. La vidéo montre un petit garçon parlant à un Amazon Echo Dot et demandant à Alexa de jouer une chanson pour enfants.

Ce qu'il a obtenu était une bouchée de mots NSFW.

Dans la vidéo, le jeune garçon demande à Alexa de jouer une comptine ou une chanson qui ressemble à "Digger, Digger". Ma meilleure supposition est qu'il veut écouter Hickory Dickory Duck. Le simple fait de regarder le titre de la comptine vous donnera une idée de la raison pour laquelle Alexa a pensé avoir entendu un mot qui rime avec "rapide". Comme dans "Vite, éteignez ce satané truc !"

Maintenant, Alexa n'est pas complètement à blâmer ici. Elle est juste un bon soldat car elle fait ce qu'on lui dit... ou pense qu'on lui a dit. Bien sûr, il est difficile de pointer un doigt accusateur vers le tout-petit qui apprend à parler. Comme pour tout le monde à son âge, son discours était un peu brouillé. Même les adultes qui ont un peu trop bu ne peuvent pas parler franchement, alors l'enfant de la vidéo obtient un laissez-passer cette fois.

Parcourez la section des commentaires du message et vous trouverez de nombreuses réactions et accusations amusantes. Au moins une personne a blâmé de façon hilarante le père du garçon pour le bobo.

Vous voyez, Alexa enregistre ce qu'elle entend et utilise les données pour personnaliser sa réaction avec l'utilisateur. C'est la même raison pour laquelle les autorités policières tentent d'amener Amazon à leur fournir les données d'un certain appareil Echo qui a été trouvé sur une scène de crime.

Maintenant, si Alexa débite des mots sexuellement explicites, il est facile de dire que cela a quelque chose à voir avec les données qu'elle a déjà recueillies. Dans ce cas, "c'était l'histoire de surf de son père" comme l'a souligné un commentateur.

Mais ils viennent juste d'avoir l'appareil, vous dites ?

Un autre commentateur a expliqué que l'Echo Dot est connecté à son compte Amazon, donc malgré sa sortie récente de la boîte, il a déjà des données collectées via le compte.

La leçon ici est d'être prudent lorsqu'il s'agit de technologie, surtout s'il y a des enfants dans la maison. Bien que cet incident puisse être considéré comme quelque chose dont on peut se moquer, il peut y avoir des répercussions. Pour éviter tout incident fâcheux comme un enfant qui regarde accidentellement de la pornographie, utilisez des filtres et prenez les autres mesures nécessaires pour protéger les enfants des effets négatifs de la technologie.

Ce que cela prouve, c'est qu'Alexa sait beaucoup de choses. Donnons-lui ça.

Maintenant que c'est réglé...

Savez-vous que vous pouvez apprendre à Alexa à dire tout ce que vous voulez ?

Amazon a récemment informé les propriétaires de ses haut-parleurs intelligents qu'ils peuvent faire répéter à Alexa les mots qu'ils disent. Le propriétaire n'a qu'à dire "Alexa, Simon dit" suivi du ou des mots de son choix. Heureusement, Alexa est assez intelligente pour émettre des gros mots.

Alexa a également désormais une prise en charge limitée des commandes vocales pour Spotify, Pandora et iTunes. Ceci s'ajoute à la prise en charge intégrée d'Amazon Music Services, iHeartRadio et TuneIn.

ÉTIQUETTE Amazon, Alexa, NSFW

Inscrivez-vous à la newsletter ITECHPOST Recevez les histoires iTechPost les plus populaires dans une newsletter hebdomadaire

© 2019 ITECHPOST, Tous droits réservés. Ne pas reproduire sans permission.