Outils

Entités

Voir toutes les entitésStatistiques d'incidents

Risk Subdomain

3.1. False or misleading information

Risk Domain

- Misinformation

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

/cdn.vox-cdn.com/uploads/chorus_asset/file/25448029/Screenshot_2024_05_14_at_1.08.35_PM.png)

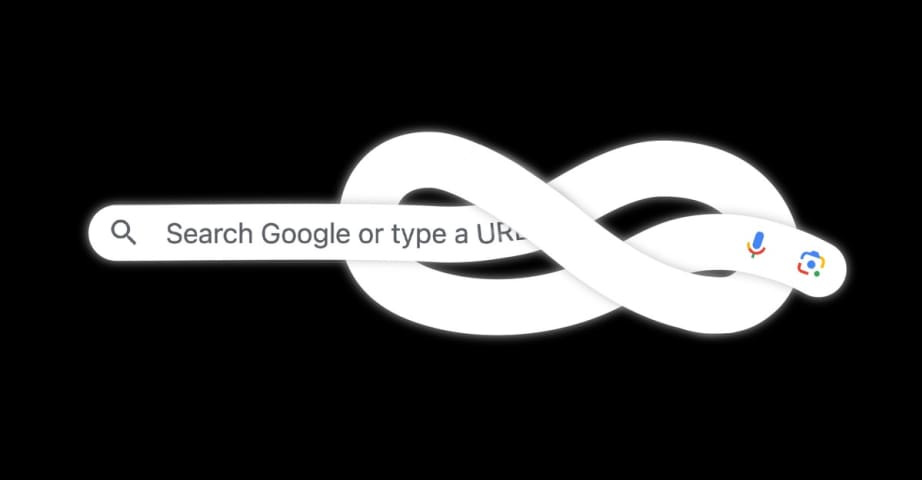

Google a fait beaucoup de bruit à propos de sa Gemini AI prenant en charge la recherche lors de son Conférence I/O aujourd'hui, mais l'une de ses démos les plus flashy a été une nouvelle fois marquée par le jamais - présente le défaut fatal…

/cdn.vox-cdn.com/uploads/chorus_asset/file/25362061/STK_414_AI_CHATBOT_R2_CVirginia_D.jpg)

Imagine this: you've carved out an evening to unwind and decide to make a homemade pizza. You assemble your pie, throw it in the oven, and are excited to start eating. But once you get ready to take a bite of your oily creation, you run int…

La nouvelle fonctionnalité de recherche de Google, AI Overviews, semble mal fonctionner.

L'outil, qui donne des résumés des résultats de recherche générés par l'IA, semblait demander à un utilisateur de mettre de la colle sur la pizza lorsq…

Google's AI search, which swallows up web results and delivers them to users in a regurgitated package, delivers each of its AI-paraphrased answers to user queries in a concise, coolly confident tone. Just one tiny problem: it's wrong. A lo…

Vous avez probablement le sentiment que les nouvelles formes d’intelligence artificielle peuvent être stupides comme de la pierre.

Des informations hilarantes et erronées provenant de la nouvelle IA de Google vous montrent à quel point c'es…

La semaine dernière, Google a dévoilé son plus grand changement en matière de recherche depuis des années présentant de nouvelles capacités d'intelligence artificielle qui répondre aux questions des gens dans le cadre de la tentative de l'e…

When Sundar Pichai, Google's chief executive, introduced a generative artificial intelligence feature for the company's search engine last month, he and his colleagues demonstrated the new capability with six text-based queries that the pub…

/cdn.vox-cdn.com/uploads/chorus_asset/file/25448029/Screenshot_2024_05_14_at_1.08.35_PM.png)

/cdn.vox-cdn.com/uploads/chorus_asset/file/25362061/STK_414_AI_CHATBOT_R2_CVirginia_D.jpg)