Incident 603: L'allocation algorithmique des ressources dans les soins de santé pour les personnes handicapées et les personnes âgées porterait préjudice aux patients

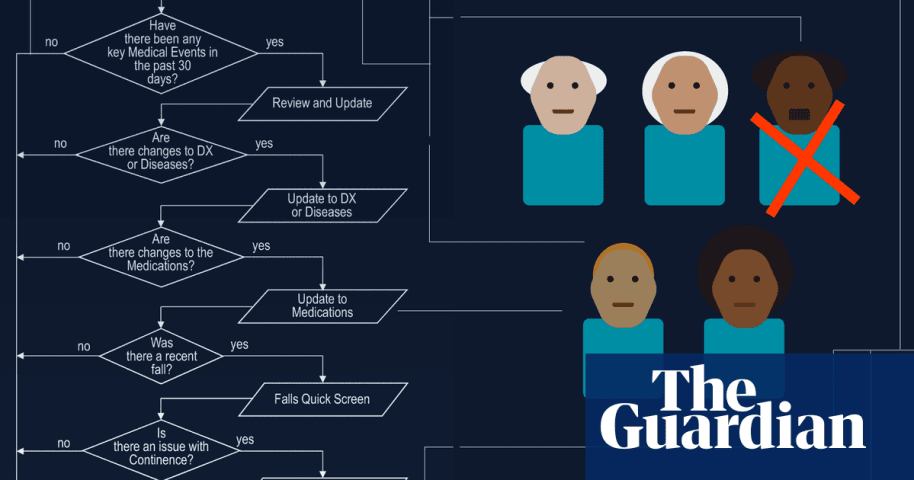

Description: Un algorithme de soins de santé conçu pour répartir équitablement les ressources de soins a considérablement réduit les heures de soins pour les personnes handicapées et âgées, entraînant des difficultés et des préjudices considérables. Initialement conçu pour une répartition équitable des ressources, ce système a finalement fait l'objet de contestations judiciaires en raison de son incapacité à évaluer précisément les besoins individuels, ce qui a entraîné une réduction des soins essentiels et soulevé des questions éthiques quant à l'utilisation de l'IA dans la prise de décision en matière de soins de santé.

Entités

Voir toutes les entitésAlleged: State governments et Brant Fries developed an AI system deployed by State governments , Idaho state government , Arkansas state government , Washington DC government , Pennsylvania state government , Iowa state government et Missouri state government, which harmed Disabled people , Elderly people , Low-income people , Larkin Seiler et Tammy Dobbs.

Classifications de taxonomie CSETv1

Détails de la taxonomieIncident Number

The number of the incident in the AI Incident Database.

603

Notes (special interest intangible harm)

Input any notes that may help explain your answers.

4.2 - The algorithm that cut Seiler's care in 2008 was declared unconstitutional by the court in 2016.

Special Interest Intangible Harm

An assessment of whether a special interest intangible harm occurred. This assessment does not consider the context of the intangible harm, if an AI was involved, or if there is characterizable class or subgroup of harmed entities. It is also not assessing if an intangible harm occurred. It is only asking if a special interest intangible harm occurred.

yes

Date of Incident Year

The year in which the incident occurred. If there are multiple harms or occurrences of the incident, list the earliest. If a precise date is unavailable, but the available sources provide a basis for estimating the year, estimate. Otherwise, leave blank.

Enter in the format of YYYY

2008

Date of Incident Month

The month in which the incident occurred. If there are multiple harms or occurrences of the incident, list the earliest. If a precise date is unavailable, but the available sources provide a basis for estimating the month, estimate. Otherwise, leave blank.

Enter in the format of MM

Date of Incident Day

The day on which the incident occurred. If a precise date is unavailable, leave blank.

Enter in the format of DD

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

7.3. Lack of capability or robustness

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- AI system safety, failures, and limitations

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

Rapports d'incidents

Chronologie du rapport

Loading...

Se confronter à un algorithme était une bataille sans précédent à laquelle Larkin Seiler avait été confronté.

En raison de sa paralysie cérébrale, cet homme de 40 ans, qui travaille dans une société d'ingénierie environnementale et adore as…

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents