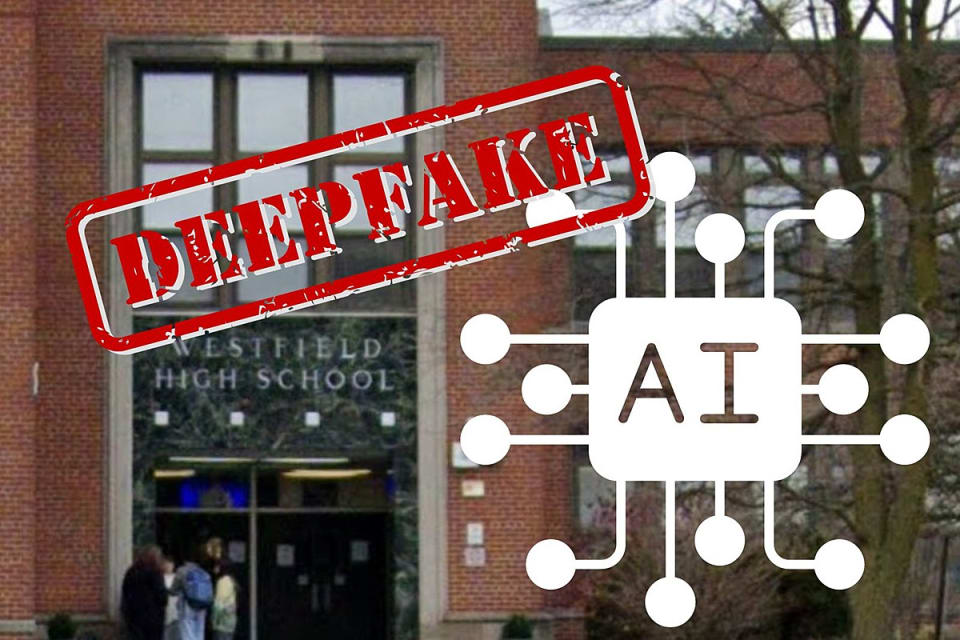

Incident 597: Des étudiantes du lycée Westfield, dans le New Jersey, auraient été la cible de photos de nus deepfake.

Outils

Entités

Voir toutes les entitésStatistiques d'incidents

Risk Subdomain

4.3. Fraud, scams, and targeted manipulation

Risk Domain

- Malicious Actors & Misuse

Entity

Human

Timing

Post-deployment

Intent

Intentional

Rapports d'incidents

Chronologie du rapport

WESTFIELD, NJ --- Mary Asfendis, directrice de l'école secondaire de Westfield, a envoyé une lettre aux parents vendredi après-midi au sujet de ce qu'elle a qualifié de "désinformation généralisée" qui a suscité "une inquiétude et une inqui…

"Des images pornographiques d'IA de votre fille de 14 ans ont circulé", m'a informé le directeur du WHS [vendredi](https://www.tapinto.net/towns/westfield/sections/education/articles/westfield-high- le directeur de l'école s'adresse aux par…

Lorsque des filles du lycée Westfield, dans le New Jersey, ont découvert que des garçons partageaient des photos d'elles nues lors de discussions de groupe, elles ont été choquées, et pas seulement parce qu'il s'agissait d'une atteinte à le…

WESTFIELD, N.J. -- Les parents et les élèves de la Westfield High School, dans le New Jersey, affirment que les élèves ont utilisé une application ou un site Web pour créer des images pornographiques de leurs camarades de classe générées pa…

WESTFIELD, N.J. - Des rapports indiquent que des étudiants de sexe masculin de Westfield High School ont utilisé l'[Intelligence artificielle](https : //www.fox5ny.com/tag/technology/artificial-intelligence) pour produire des images explici…

WESTFIELD, NJ --- Les parents, les élèves et les membres de la communauté de Westfield exigent des mesures après que la nouvelle ait été entendue à l'école secondaire de Westfield qu'au moins un garçon de l'école avait créé et partagé des i…

En octobre dernier, des garçons de la Westfield High School dans le New Jersey ont commencé à se comporter de manière « bizarre », selon le Wall Street Journal [rapporté](https://www.wsj.com/tech/fake-nudes-of-real-students-cause-an -tumult…

Des images pornographiques générées par l'IA d'étudiantes d'un lycée du New Jersey ont été diffusées par des camarades de classe masculins, déclenchant le tollé des parents et une enquête policière, selon un rapport.

Étudiants de la Westfie…

WESTFIELD, NJ — Les élèves de la Westfield High School ont créé et distribué de fausses images pornographiques d'autres étudiantes de l'école, suscitant l'inquiétude de certains parents et incitant les autorités à enquêter sur ces allégatio…

Un lycée du New Jersey a été plongé dans la crise après que des étudiants de sexe masculin ont été surpris en train de partager des nus générés par l'IA de leurs camarades de classe.

Certains étudiants de sexe masculin de la deuxième classe…

Une enquête est en cours après que des adolescentes d'un lycée du New Jersey ont découvert que leurs camarades de classe masculins avaient utilisé des sites Web d'intelligence artificielle pour créer de faux nus d'elles, que les adolescents…

NEW YORK (1010 WINS/WCBS 880) – Des garçons du lycée Westfield du New Jersey ont partagé de fausses photos nues générées par l'IA de camarades de classe lors de discussions de groupe au cours de l'été, a confirmé 1010 WINS/WCBS 880.

Selon l…

L'école secondaire Westfield à Westfield, dans le New Jersey, remonte à 1864, mais elle est présente sur Dorian Road depuis 1951. Avec près de 2 000 étudiants inscrits aujourd'hui, le district a été confronté à toutes sortes de problèmes au…

Des photos pornographiques d'élèves d'un lycée du New Jersey générées par l'IA et distribuées à leurs camarades de classe masculins ont suscité l'indignation des parents et des responsables de l'école et ont donné lieu à une enquête de la p…

Un téléphone, quelques photos et l'intelligence artificielle ont suscité la controverse et brisé la vie privée de plusieurs adolescents d'un lycée du New Jersey après avoir appris que des images nues d'eux - créées via l'IA - ont circulé da…

Les dangers de la technologie de l’intelligence artificielle ont été mis en évidence à Westfield après la diffusion de fausses images pornographiques d’étudiantes dans le lycée local.

Les images ont été créées à partir de vraies photos prov…

Les élèves d'un lycée du New Jersey(https://lawandcrime.com/tag/new-jersey/) sont terrifiés après avoir appris qu'un de leurs camarades de classe aurait utilisé l'IA pour créer des images sexuellement explicites d'eux sans leur permission.

…

Un incident très médiatisé au cours duquel des lycéens ont partagé des images pornographiques génér�ées par l'intelligence artificielle de [mineurs](https://washingtonexaminer.com/tag /adolescents) camarades de classe a attiré l'attention su…

/cloudfront-us-east-1.images.arcpublishing.com/gray/OI5GJYGAMJHGJFZJECCEKJAPT4.png)

WESTFIELD, N.J. (WCBS) – Certains lycéens du New Jersey sont accusés d’avoir partagé des photos nues de leurs camarades de classe générées par l’IA.

L'incident s'est produit au cours de l'été, mais a récemment été porté à l'attention des ad…

Une communauté scolaire du New Jersey a été choquée lorsque des images d'élèves nues ont commencé à circuler au lycée de Westfield. Encore plus choquant, quelqu'un avait créé des photos pornographiques à l'aide d'images IA. Des garçons de d…

(NewsNation) — Une [polémique sur les photos nues](https://www.newsnationnow.com/us-news/ap-us-news/ap-ai-generated -des-images-d'abus-sexuels-d'enfants-pourraient-inonder-Internet-un-chien-de-garde-appelle-à-l'action/) a une communauté du …

Après que des nus d'adolescentes générés par l'IA ont commencé à circuler dans un lycée du New Jersey, ni les parents, ni les responsables de l'école, ni même les forces de l'ordre locales n'ont été en mesure de comprendre comment y faire f…

Le partage d'images explicites d'élèves du secondaire générées par l'IA a déclenché un tollé dans une banlieue aisée de New York et a laissé les adolescents, les parents, l'école et la police se demander comment ils peuvent remédier aux vio…

Des adolescents ont utilisé l'intelligence artificielle (IA) pour créer de fausses photos nues de leurs camarades de classe dans un lycée aux États-Unis.

Une enquête est actuellement en cours après que des adolescentes du lycée Westfield Hi…

Le scandale de l'IA dans les lycées déclenche une enquête policière et des appels à une réforme juridique

POINTS SAILLANTS

-

De faux nus générés par l'IA dans un lycée du New Jersey déclenchent une enquête policière et des poursuites judici…

(Daily Caller News Foundation) – Les filles du lycée Westfield, dans le New Jersey, ont été choquées lorsqu'elles ont découvert que des garçons faisaient circuler de fausses photos nues d'elles, selon un rapport publié jeudi par le Wall Str…

Un étudiant d'un lycée du New Jersey demande une législation fédérale pour lutter contre les images pornographiques générées par l'IA après avoir déclaré que des photos d'elle et d'autres camarades de classe avaient été manipulées et éventu…

Le porno deepfake est endémique et un lycée du New Jersey est l'un des derniers épicentres.

La police [enquête](https://www.wsj.com/tech/fake-nudes-of-real-students-cause-an-uproar-at-a-new-jersey-high-school-df10f1bb?mod= hp_trending_now_a…

WESTFIELD, NJ — Un groupe d'élèves du lycée de Westfield fait l'objet d'une enquête en cours après que des allégations ont fait surface selon lesquelles ils utiliseraient l'intelligence artificielle pour créer et distribuer des images porno…

Les parents et les élèves de Westfield High dans le New Jersey s'expriment après qu'un ou plusieurs élèves de sexe masculin auraient utilisé une [IA](https://globalnews.ca/ tag/ai) pour créer de fausses images de nus en utilisant les visage…

Alessandra Kellermann est conseillère en santé mentale, spécialiste du comportement et propriétaire de Gentle Insight, LLC.

Avant de perdre un autre élève par suicide, affrontons la crise de santé mentale et les problèmes qui surviennent, d…

WESTFIELD, NJ — Un élève du lycée de Westfield accusé d'avoir utilisé l'intelligence artificielle pour [créer de fausses images pornographiques](https://patch.com/new-jersey/westfield/fake-nude-photos-westfield-hs-students-spark- rapport d'…

Une adolescente et sa mère s'expriment après qu'un lycéen aurait utilisé l'intelligence artificielle pour créer des images nues d'elle et d'autres filles, qui ont ensuite été partagées avec un groupe de camarades de classe.

Francesca Mani, …

Un lycée du New Jersey a été secoué par un scandale après que des étudiants auraient utilisé l'IA pour créer de fausses photos nues d'étudiantes.

Le mois dernier, des adolescentes du Westfield High School ont appris que de fausses images nu…

Les responsables de l'école secondaire Westfield High School à Westfield, dans le New Jersey, tentent de découvrir qui se cache derrière des photos « deepfake » censées ressembler à des photos nues d'élèves féminines. Les images générées pa…

WESTFIELD, N.J. (WCBS/CNN/CNN Newsource/WKRC) – Des lycéens ont été accusés d'avoir fait circuler des photos explicites de leurs camarades de classe générées par l'IA.

L'incident s'est produit au cours de l'été à Westfield, dans le New Jers…

La semaine dernière, un nombre non divulgué de filles d'un lycée du New Jersey ont appris qu'un ou plusieurs élèves de leur �école avaient utilisé un outil d'intelligence artificielle pour générer ce qui semblait être des images d'elles nues…

Francesca Mani, une élève du New Jersey Westfield High School, s'est manifestée avec sa mère, Dorota, pour dénoncer les images pornographiques générées par l'IA qui, selon elle, ont été manipulées et partagées d'elle et d'autres camarades d…

Aux États-Unis, les adolescentes qui sont de plus en plus ciblées ou menacées par de fausses photos nues créées avec l'intelligence artificielle ou d'autres outils disposent de moyens limités pour demander des comptes ou des recours, alors …

A mother and her 14-year-old daughter are advocating for better protections for victims after AI-generated nude images of the teen and other female classmates were circulated at a high school in New Jersey.

Meanwhile, on the other side of t…

Une mère et sa fille de 14 ans plaident pour une meilleure protection des victimes après AI-generated images nues de l'adolescente et d'autres camarades de classe ont été diffusés dans un lycée du New Jersey.

Pendant ce temps, de l’autre cô…

Partager des images nues de personnes réelles modifiées numériquement pourrait éventuellement constituer un crime fédéral.

Le représentant Joseph Morelle (Démocrate, New York) a proposé mardi à nouveau la « Loi sur la prévention des Deepfak…

A teenage victim of nonconsensual sexually explicit deepfakes joined Rep. Joe Morelle, D-N.Y., on Tuesday to advocate for a bipartisan bill that would criminalize sharing such material at the federal level.

In May, Morelle introduced the P…

“Imagine a girl waking up and finding an explicit photo or video that looks like her but it isn’t her,” Dorota Mani told The Post.

That’s what happened to Mani’s 14-year-old daughter, Francesca, who discovered in October that classmates at …

WESTFIELD, NJ --- Les institutions gouvernementales, y compris la police, n'ont pas réussi à protéger les filles du lycée de Westfield contre les «violations et l'exploitation» par l'utilisation de l'intelligence artificielle (IA) pour crée…

WASHINGTON, DC --- Francesca Mani, une élève de deuxième année du lycée de Westfield qui milite pour des lois plus strictes concernant la pornographie générée par l'IA, a assisté au discours sur l'état de l'Union du président Biden jeudi so…

En octobre dernier, Francesca Mani est rentrée de l’école dans la banlieue du New Jersey avec une nouvelle dévastatrice pour sa mère, Dorota.

Plus tôt dans la journée, la jeune fille de 14 ans avait été convoquée dans le bureau du directeur…

Le 20 octobre 2023, une élève de 14 ans du lycée du New Jersey a appris que l'une de ses camarades de classe avait utilisé un service en ligne pour créer une image générée artificiellement de son visage sur le corps d'une femme nue. Et elle…

Westfield Public Schools held a regular board meeting in late March at the local high school, a red brick complex in Westfield, N.J., with a scoreboard outside proudly welcoming visitors to the "Home of the Blue Devils" sports teams.

But it…

Veuillez consulter la source originale du reportage vidéo.

Les victimes de la pornographie deepfake par IA Elliston Berry et Francesca Mani racontent comment elles ont été victimes de fausses images diffusées en ligne et comment cela a eu u…

En octobre dernier, Franceseca Mani, une lycéenne de 15 ans du New Jersey, a appris que des garçons de sa classe avaient utilisé un logiciel d'intelligence artificielle pour fabriquer des images sexuellement explicites de Mani et de ses cam…

WESTFIELD, NJ --- L'adversité donne des opportunités, a dit un jour Benjamin Franklin, et aujourd'hui, une adolescente de Westfield prouve une fois de plus cet adage : Francesca Mani, une élève de deuxième année du lycée de Westfield qui mi…

WESTFIELD — Une lycéenne du New Jersey victime de deepfakes pornographiques est désormais l'une des personnes les plus influentes dans le domaine de l'intelligence artificielle, selon Time.

Francesca Mani est une élève de 15 ans en deuxième…

Note de la rédaction du Korea Times : cet article est le deuxième d'une série en trois parties sur les crimes sexuels deepfake dans les écoles. Ces crimes, qui impliquent la manipulation de photos et de vidéos pour créer du contenu explicit…

Francesca Mani, une lycéenne de Westfield High School, dans le New Jersey, a été victime d'une nouvelle forme de cybercriminalité impliquant l'intelligence artificielle (IA) et la technologie deepfake en octobre 2023. La jeune fille de 14 a…

Alors que des membres du Parlement britannique lancent une initiative visant à interdire légalement les smartphones dans les écoles, afin de protéger les enfants des dangers potentiels des réseaux sociaux, une adolescente américaine partage…

La loi TAKE IT DOWN Act, une loi sur la sécurité en ligne, gagne du terrain à Washington, D.C., la Première dame Melania Trump ayant exprimé son soutien lundi.

Vue d'ensemble : Ce projet de loi bipartisan vise à renforcer la protection cont…

Variantes

Incidents similaires

Selected by our editors

Did our AI mess up? Flag the unrelated incidents

Uber AV Killed Pedestrian in Arizona

Wikipedia Vandalism Prevention Bot Loop

Incidents similaires

Selected by our editors

Did our AI mess up? Flag the unrelated incidents

Uber AV Killed Pedestrian in Arizona

/cloudfront-us-east-1.images.arcpublishing.com/gray/OI5GJYGAMJHGJFZJECCEKJAPT4.png)