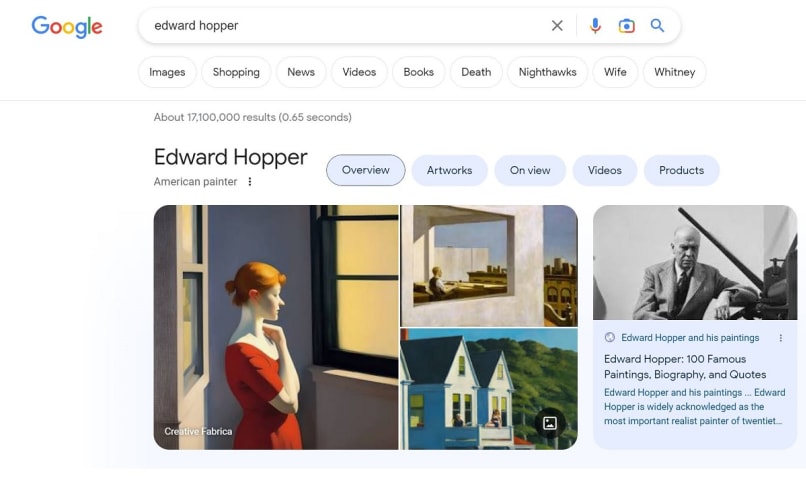

Incident 553: Panneau de présentation de Google pour l'image vedette de l'artiste Edward Hopper générée dans son style par l'IA

Description: Le panneau de connaissances de Google pour l'artiste américain Edward Hopper présentait une image générée par l'IA qui était censée être créée dans le style de l'artiste mais qui n'était pas l'une de ses œuvres, dont l'image a été supprimée peu de temps après.

Outils

Nouveau rapportNouvelle RéponseDécouvrirVoir l'historique

Le Moniteur des incidents et risques liés à l'IA de l'OCDE (AIM) collecte et classe automatiquement les incidents et risques liés à l'IA en temps réel à partir de sources d'information réputées dans le monde entier.

Entités

Voir toutes les entitésPrésumé : Un système d'IA développé et mis en œuvre par Google, a endommagé Google users.

Statistiques d'incidents

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

3.1. False or misleading information

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Misinformation

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Unintentional

Rapports d'incidents

Chronologie du rapport

Loading...

Si vous ne pensez pas que l'IA visuelle est un problème, c'est ce qui apparaît lorsque vous @Google Edward Hopper.

Loading...

L'IA est déjà en train de réécrire l'histoire de l'art.

Lorsque vous avez recherché sur Google le célèbre artiste réaliste Edward Hopper cette semaine, la première image présentée qui est apparue était suffisamment convaincante. Une femme s…

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?