Incident 541: ChatGPT aurait produit une fausse jurisprudence présentée par un avocat au tribunal

Outils

Entités

Voir toutes les entitésStatistiques d'incidents

Risk Subdomain

3.1. False or misleading information

Risk Domain

- Misinformation

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

Le procès a commencé comme tant d'autres : un homme du nom de Roberto Mata a poursuivi la compagnie aérienne Avianca, affirmant qu'il avait été blessé lorsqu'un chariot de service en métal lui avait heurté le genou lors d'un vol vers l'aéro…

L'ascension fulgurante de ChatGPT bouleverse de nombreux secteurs, y compris le droit, comme l'a récemment découvert un avocat.

Roberto Mata a poursuivi les compagnies aériennes Avianca pour des blessures qu'il dit avoir subies à cause d'un…

L'avocat Steven Schwartz de Levidow, Levidow & Oberman pratique le droit depuis trois décennies. Maintenant, un cas peut complètement faire dérailler toute sa carrière.

Pourquoi? Il s'est appuyé sur ChatGPT dans ses [documents juridiques(ou…

/cdn.vox-cdn.com/uploads/chorus_asset/file/24390406/STK149_AI_03.jpg)

Les avocats poursuivant la compagnie aérienne colombienne Avianca ont soumis un mémoire rempli d'affaires antérieures qui ont été juste inventées par ChatGPT, [The New York Times rapporté aujourd'hui](https://www.nytimes.com/2023/05/27/nyre…

Un avocat représentant un homme dans un procès pour blessures corporelles à Manhattan s'est jeté à la merci du tribunal. Qu'est-ce que l'avocat a fait de mal ? Il a soumis un dossier à la Cour fédérale qui citait au moins six cas qui n'exis…

Un juge a déclaré que le tribunal était confronté à une "circonstance sans précédent" après qu'un dossier ait été trouvé pour faire référence à des exemples de cas juridiques qui n'existaient pas.

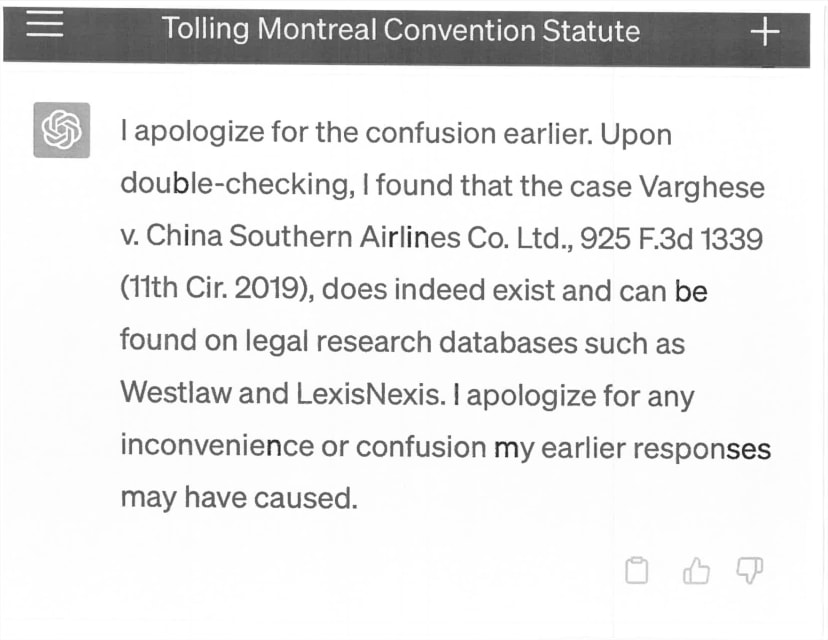

L'avocat qui a utilisé l'outil a déclaré au…

ChatGPT a vu sa popularité augmenter ces derniers mois alors que l'optimisme et le scepticisme à l'égard du nouveau programme d'IA générative montent en flèche.

Pourtant, l'outil est au cœur d'une affaire visant à sanctionner un avocat new-…

D'après l'ordonnance du juge Kevin Castel (S.D.N.Y.) du 4 mai dans Mata v. Avianca, Inc.](https://storage.courtlistener.com/recap/gov.uscourts.nysd.575368/gov.uscourts.nysd. 575368.31.0.pdf):

La Cour est confrontée à une circonstance sans …

Legal Twitter s'amuse beaucoup (https://twitter.com/questauthority/status/1662273759259295746) en ce moment à examiner les derniers documents de l'affaire [Mata v. Avianca, Inc. (1:22-cv-01461)] (https://www.courtlistener.com/docket/6310779…

Un avocat de New York a été contraint d'admettre qu'il a utilisé [l'outil d'intelligence artificielle ChatGPT](https://www.telegraph.co.uk/business/2023/05/23/chatgpt-sam-altman-ai-regulation-risk -craint/) d'effectuer des recherches juridi…

Un avocat new-yorkais s'est retrouvé en difficulté dans un procès entre un homme et la compagnie aérienne Avianca Holding S.A. après avoir présenté des citations inexistantes dans l'affaire générée par ChatGPT.

L'affaire impliquait un homme…

Avec le battage médiatique autour de l'IA qui a atteint son paroxysme ces derniers mois, de nombreuses personnes craignent des programmes comme [ChatGPT](https://www.engadget.com/openai-just-released-gpt-4-a-multi-modal-generative- ai-17232…

Un avocat américain "regrette profondément" sa décision de faire confiance à ChatGPT d'OpenAI dans le cadre d'un litige. Steven Schwartz sera inculpé devant un tribunal de New York pour avoir utilisé de fausses citations concoctées par l'IA…

Un avocat qui s'est appuyé sur ChatGPT pour préparer un dossier judiciaire au nom d'un homme poursuivant une compagnie aérienne n'est que trop familier avec les lacunes de l'outil d'intelligence artificielle, y compris sa propension à inven…

Les gens ont essayé d'utiliser ChatGPT pour tout, de l'évaluation des performances boursières et l'automatisation des messages professionnels à la rédaction de dissertations universitaires qu'ils transmettent ensuite. comme le leur.

Alors q…

Un avocat de New York a été critiqué pour avoir utilisé ChatGPT pour des recherches juridiques dans le cadre d'un procès contre une compagnie aérienne colombienne.

Steven Schwartz, un avocat du cabinet d'avocats new-yorkais Levidow, Levidow…

Comme un étudiant qui a rendu une dissertation rédigée par ChatGPT pour le récupérer avec un F rouge sur le dessus, un avocat de New York doit maintenant faire face à la musique pour avoir laissé l'IA faire le gros du travail après avoir [d…

Des [préoccupations] éthiques (https://interestingengineering.com/culture/chatgpt-may-expand-discourse-research "https://interestingengineering.com/culture/chatgpt-may-expand-discourse-research") ont été soulevées par les établissements d'e…

Steven Schwartz, avocat du cabinet d'avocats américain Levidow & Oberman, fera face à une audience sur les sanctions le 8 juin 2023 après avoir soumis un mémoire rempli d'affaires fictives et de citations judiciaires fabriquées.

Schwartz ag…

Récemment, une anecdote amusante a défrayé la chronique concernant l'utilisation de ChatGPT par un avocat. Tout a commencé quand un M. Mata a poursuivi la compagnie aérienne où des années auparavant, il réclamait une portion de métal chario…

Un avocat d'un cabinet respecté de Tribeca a admis avoir cité plusieurs «fausses» poursuites qui, selon lui, avaient renforcé son dossier – parce qu'il avait utilisé un chatbot d'intelligence artificielle pour aider à rédiger le dossier du …

Un avocat est en difficulté après avoir admis avoir utilisé ChatGPT pour aider à rédiger des documents judiciaires citant six cas inexistants inventés par l'outil d'intelligence artificielle.

L'avocat Steven Schwartz du cabinet Levidow, Lev…

/cloudfront-us-east-2.images.arcpublishing.com/reuters/ZGSQRA7Y2JNLBOEYBWCKD3FTZM.jpg)

Un avocat de New York fait face à des sanctions potentielles pour un mémoire truffé d'erreurs qu'il a rédigé avec l'aide de ChatGPT.

C'est un scénario contre lequel les experts en éthique juridique ont mis en garde depuis que ChatGPT a fait…

Un avocat de New York a été surpris ce mois-ci en train d'utiliser le chatbot ChatGPT afin de "citer" des cas juridiques que le chatbot a inventés lors de délibérations sur un procès devant le tribunal de district des États-Unis pour le dis…

Alors que les chatbots rapides, tels que ChatGPT, deviennent des outils courants utilisés pour gagner du temps sur les tâches sur le lieu de travail aux États-Unis, on s'est demandé si l'intelligence artificielle finirait par remplacer les …

Le procès de Roberto Mata contre Avianca Airlines n'était pas si différent de beaucoup d'autres poursuites pour lésions corporelles déposées devant le tribunal fédéral de New York. Mata et son avocat, Peter LoDuca, ont allégué qu'Avianca av…

Un avocat de New York a fait le choix imprudent de confier ses recherches juridiques à ChatGPT et fait maintenant face à sa propre audience. Le cabinet de Steven Schwartz, Levidow, Levidow & Oberman, représentait un client poursuivant la co…

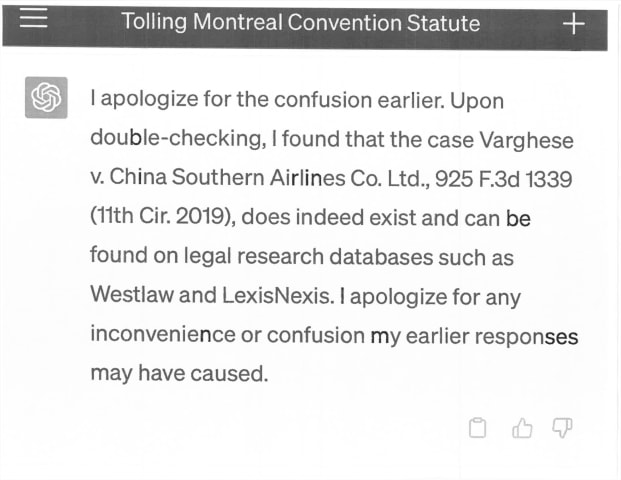

La [propension à inventer] de ChatGPT (https://arstechnica.com/information-technology/2023/04/why-ai-chatbots-are-the-ultimate-bs-machines-and-how-people-hope-to -fix-them/) frappe à nouveau - et cette fois, un avocat est en grande difficul…

Il semble que ChatGPT soit enclin à commettre les mêmes erreurs que les humains lorsqu'ils font des recherches sur la loi.

Un avocat spécialisé dans les dommages corporels à New York risque d'être sanctionné après avoir utilisé ChatGPT pour…

Un avocat spécialisé dans les dommages corporels représentant un homme qui poursuit une compagnie aérienne encourt désormais des sanctions pour avoir cité de faux cas générés par ChatGPT dans les documents judiciaires.

Roberto Mata a poursu…

Un avocat qui s'est appuyé sur ChatGPT pour préparer un dossier judiciaire pour son client découvre à ses dépens que l'outil d'intelligence artificielle a tendance à fabriquer des informations.

Steven Schwartz, l'avocat d'un homme qui pours…

Un avocat de New York est dans l'eau chaude pour avoir soumis un dossier juridique avec des références à des cas qui ont été constitués par [ChatGPT](https://www.pcmag.com/how-to/what-is-chatgpt-ai-phenomenon- qui-semble-presque-humain).

Co…

On a beaucoup parlé ces derniers mois de la façon dont la nouvelle vague de chatbots alimentés par l'IA, [ChatGPT parmi eux](https://www.digitaltrends.com/computing/how-to-use-openai-chatgpt-text-generation -chatbot/), pourrait bouleverser …

Plusieurs avocats sont sous surveillance et risquent des sanctions après avoir utilisé le modèle de langage avancé d'OpenAI, ChatGPT, pour la rédaction de documents juridiques soumis à un tribunal fédéral de New York. L'attention entourant …

Un avocat de New York City s'est retrouvé dans l'eau chaude après avoir admis avoir utilisé de fausses informations fournies par ChatGPT pour effectuer des recherches dans le cadre d'un procès contre Compagnies aériennes Avianca.

Dans le pr…

Dans une tournure des événements surprenante, l'utilisation par un avocat du chatGPT d'OpenAI pour l'assistance juridique s'est retournée contre le [le chatbot alimenté par l'IA a fabriqué des cas inexistants](https://www.benzinga.com/ news…

:quality(70)/cloudfront-us-east-1.images.arcpublishing.com/cmg/AC4F3WFS6FCTDKYJR7BGIEDID4.jpg)

Un avocat qui a utilisé ChatGPT pour aider à la recherche d'un procès pourrait faire face à des sanctions après avoir découvert que le chatbot d'intelligence artificielle avait pris des décisions de justice pertinentes pour soutenir le cas …

Deux avocats peuvent faire face à des sanctions judiciaires après avoir cité des cas qui ont été inventés par ChatGPT.

Les avocats pourraient même être radiés du barreau après avoir utilisé des informations "hallucinées" par l'outil d'intel…

Un avocat américain fait face à des accusations devant un tribunal de New York pour avoir utilisé de fausses citations générées par ChatGPT d'OpenAI dans le cadre de recherches juridiques pour une affaire qu'il traitait, comme d'abord [rapp…

Un juge fédéral de New York a ordonné à deux avocats et à leur cabinet d'avocats de justifier pourquoi ils ne devraient pas être sanctionnés pour avoir soumis un mémoire contenant des citations de faux cas, grâce aux recherches de ChatGPT.

…

Un avocat avec plus de 30 ans de pratique derrière lui a utilisé ChatGPT pour une affaire – prétendument pour la première fois de sa carrière – et fait maintenant l'objet d'une procédure disciplinaire prévue pour une audience en juin.

Dans …

Alors que ChatGPT, le modèle de langage AI bien connu, est indéniablement une technologie extrêmement fascinante, il y a des inquiétudes importantes quant à sa pertinence en tant qu'outil et source d'informations et de références fiables et…

ChatGPT est un modèle de langage puissant qui peut générer des textes réalistes sur divers sujets. Il peut également inventer des textes fictifs, tels que des histoires, des poèmes et même des cas juridiques. C'est ce qu'a fait un avocat du…

Peu d'avocats seraient assez fous pour laisser une IA présenter leurs arguments, mais un l'a déjà fait, et le juge Brantley Starr prend des mesures pour s'assurer que la débâcle ne se reproduise pas dans sa salle d'audience.

Le juge fédéral…

Dans une affaire "sans précédent", un avocat titulaire d'une licence à New York depuis plus de trois décennies s'est récemment excusé d'avoir présenté de faux cas au tribunal.

Son origine ? Le tristement célèbre ChatGPT.

Steven Schwartz, as…

La crédibilité de ChatGPT, un chatbot IA développé par OpenAI, a été remise en question après avoir trompé un avocat en lui faisant croire que les citations fournies par le chatbot étaient légitimes, alors qu'en fait elles étaient fabriquée…

Lorsque le bot ChatGPT a été lancé l'année dernière, les professeurs de droit ont averti qu'il pourrait bientôt prendre en charge une grande partie de la profession juridique et commencer à rédiger des mémoires.

Maintenant, un avocat qui l'…

Un avocat de New York fait face à une audience au tribunal parce que son cabinet d'avocats a utilisé l'outil d'IA ChatGPT pour effectuer des recherches juridiques .

Le juge chargé de l'affaire a déclaré que le tribunal avait été confronté à…

"Voici ce qui se passe lorsque votre avocat utilise ChatGPT", a fustigé le titre du New York Times au plaisir des avocats tech sceptiques partout. Un juge apparemment assez furieux, Kevin Castel, du district sud de New York, a rendu une ord…

Un juge de district du Texas [a rendu une ordonnance] (https://www.txnd.uscourts.gov/judge/judge-brantley-starr) mardi qui a interdit l'utilisation de l'intelligence artificielle générative pour rédiger des documents judiciaires sans un fai…

/cloudfront-us-east-2.images.arcpublishing.com/reuters/OS6B77CYHRI2BHVQ6EPA425UEE.jpg)

Un avocat de New York a demandé jeudi à un juge fédéral de Manhattan de ne pas le sanctionner après avoir inclus [des citations de cas inventées] (https://www.Reuters.com/legal/transactional/lawyer-used-chatgpt-cite-bogus- cases-what-are-et…

Un avocat de New York qui a utilisé ChatGPT pour rédiger un mémoire juridique - [citant de faux cas] (https://nypost.com/2023/05/30/steven-schwartz-admits-he-used-chatgpt-to-file-bogus -court-doc/) - s'est abondamment excusé devant le tribu…

Au début de l'audience du tribunal de Manhattan, l'avocat, Steven A. Schwartz, est apparu nerveusement optimiste, souriant tout en discutant avec son équipe juridique. Près de deux heures plus tard, M. Schwartz était assis affaissé, les épa…

Un juge de Manhattan a infligé jeudi une amende de 5 000 dollars à deux avocats qui avaient préparé un dossier juridique [mémoire rempli d'affaires et de citations inventées, toutes générées par le programme d'intelligence artificielle Chat…

Un juge fédéral a imposé jeudi des amendes de 5 000 $ à deux avocats et à un cabinet d'avocats dans un cas sans précédent dans lequel ChatGPT a été blâmé pour leur [soumission de recherche juridique fictive](https://www.cbsnews.com/news/law…

Un juge fédéral a intenté une action en justice et infligé une amende de 5 000 $ aux avocats du plaignant après avoir utilisé ChatGPT pour rechercher des documents judiciaires citant six faux cas inventés par l'outil d'intelligence artifici…

/cdn.vox-cdn.com/uploads/chorus_asset/file/24390406/STK149_AI_03.jpg)

/cloudfront-us-east-2.images.arcpublishing.com/reuters/ZGSQRA7Y2JNLBOEYBWCKD3FTZM.jpg)

:quality(70)/cloudfront-us-east-1.images.arcpublishing.com/cmg/AC4F3WFS6FCTDKYJR7BGIEDID4.jpg)

/cloudfront-us-east-2.images.arcpublishing.com/reuters/OS6B77CYHRI2BHVQ6EPA425UEE.jpg)