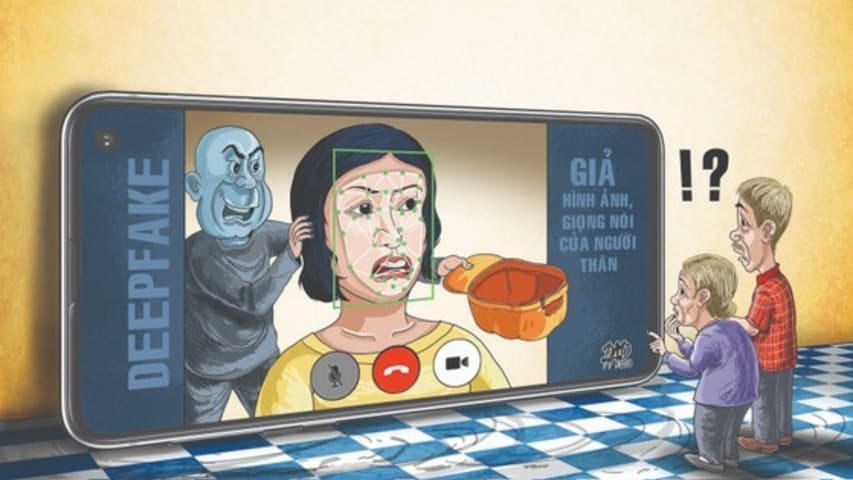

Incident 509: Au Vietnam, des escrocs ont falsifié des vidéos de proches de victimes demandant des fonds sur Facebook.

Outils

Entités

Voir toutes les entitésClassifications de taxonomie CSETv1

Détails de la taxonomieIncident Number

509

Special Interest Intangible Harm

maybe

Date of Incident Year

2023

Date of Incident Month

03

Date of Incident Day

Estimated Date

No

Risk Subdomain

4.3. Fraud, scams, and targeted manipulation

Risk Domain

- Malicious Actors & Misuse

Entity

Human

Timing

Post-deployment

Intent

Intentional

Rapports d'incidents

Chronologie du rapport

(DTTCO) - Après l'arnaque par SMS grâce au transfert d'argent, maintenant les escrocs appliquent rapidement d'autres tactiques plus sophistiquées, à travers de faux appels vidéo grâce à la technologie Deepfake.

Tromper les utilisateurs

Aprè…

Après avoir été détectés avec des astuces pour envoyer des messages à l'argent approprié, les escrocs utilisent maintenant un outil encore plus sophistiqué appelé Deepfake pour passer de faux appels vidéo aux victimes et demander un transfe…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents