Incident 398: Le pilote automatique Tesla a mal identifié une calèche sur route

Outils

Entités

Voir toutes les entitésStatistiques d'incidents

Risk Subdomain

7.3. Lack of capability or robustness

Risk Domain

- AI system safety, failures, and limitations

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

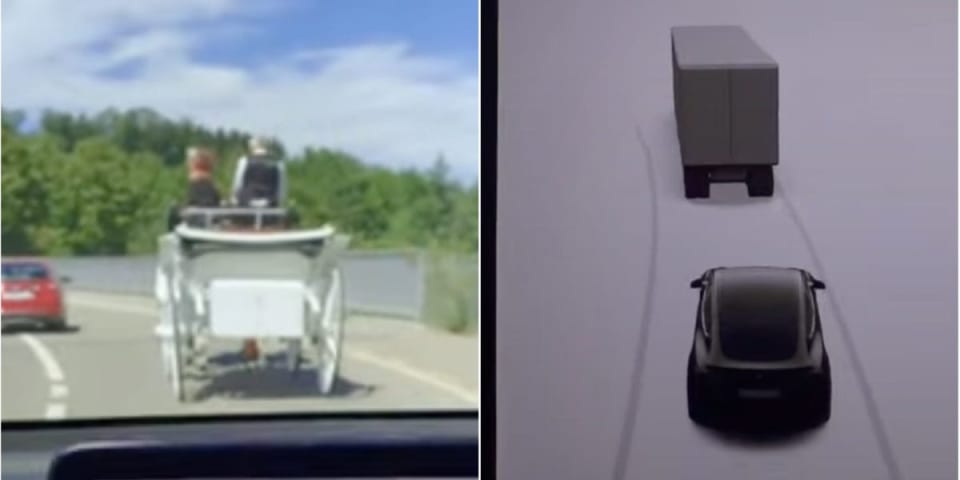

Une vidéo publiée par un conducteur de Tesla semble montrer que le système de pilote automatique de sa voiture confond une calèche avec un camion.

La vidéo, publiée par le YouTuber suisse RealRusty, montre sa Tesla s'approchant d'une calèch…

Un ami vient de me le partager. Un excellent exemple de la difficulté des modèles d'apprentissage en profondeur avec des données non distribuées.

Je me demande combien de voitures le modèle a vu pendant l'entraînement 😅

Tesla, le géant de l'automobile et le leader du marché des véhicules électriques grâce à sa technologie de conduite de pointe, y compris la fonction de "conduite autonome/pilote automatique", s'est retrouvé la cible de remarques sarcastique…