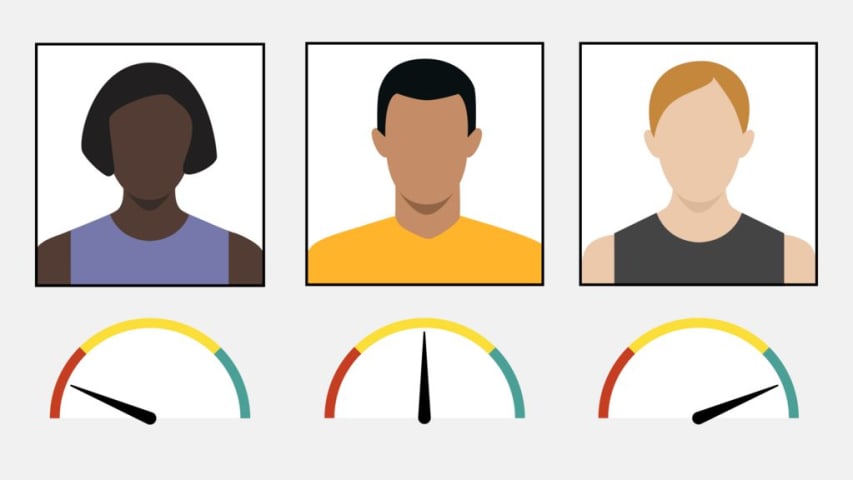

Incident 1258: Une vidéo truquée (deepfake) imite une diffusion de RTÉ annonçant faussement le retrait de la candidate à la présidence irlandaise Catherine Connolly.

Entités

Voir toutes les entitésStatistiques d'incidents

Rapports d'incidents

Chronologie du rapport

La candidate à la présidence irlandaise, Catherine Connolly, a déposé une plainte officielle auprès de la Commission électorale concernant une vidéo truquée malveillante réalisée par intelligence artificielle.

La vidéo, apparue en ligne mar…

Catherine Connolly a condamné une vidéo truquée (deepfake) générée par une intelligence artificielle (IA) qui la montrait faussement se retirer de l'élection présidentielle.

La vidéo, conçue pour ressembler à un bulletin d'information de la…

La campagne pour l'élection présidentielle irlandaise a été perturbée par une vidéo truquée (deepfake) générée par intelligence artificielle, montrant la candidate Catherine Connolly annonçant son « retrait » de la course.

« C'est avec un p…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents