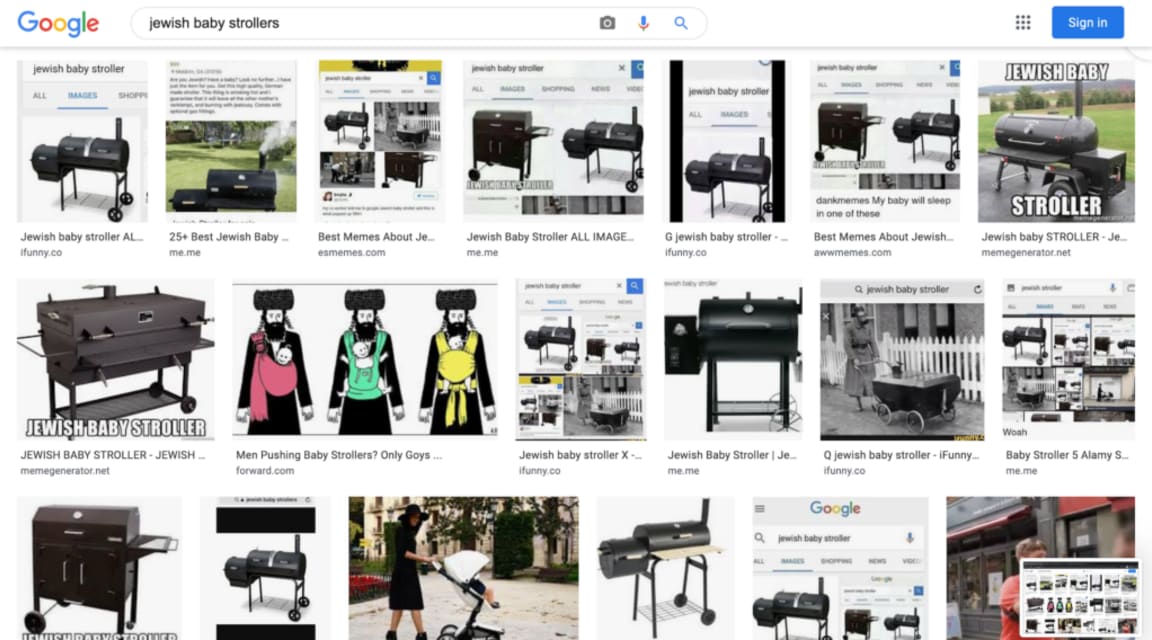

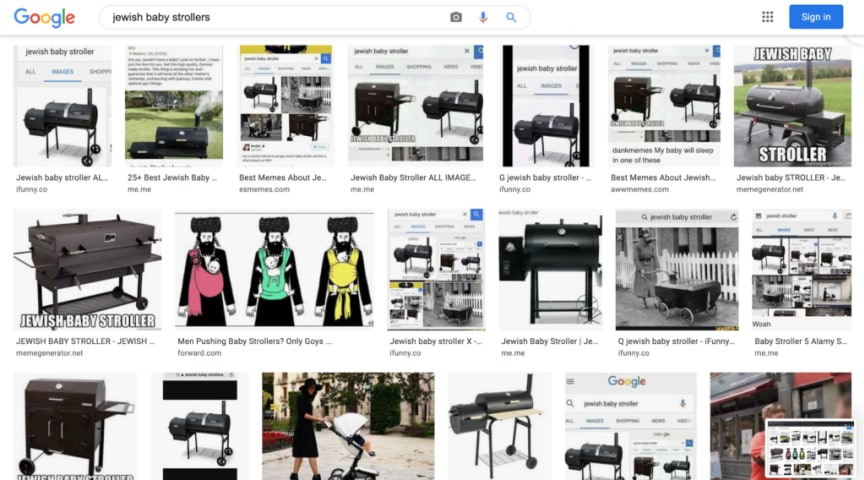

Incident 1057: Des « poussettes juives » ont fourni des images antisémites sur Google, résultant prétendument d'une campagne de discours de haine

Description: Les résultats des recherches Google Images pour « poussettes juives » auraient montré des résultats offensants et antisémites, prétendument le résultat d'une campagne coordonnée de discours de haine impliquant des acteurs malveillants sur 4chan.

Entités

Voir toutes les entitésPrésumé : Un système d'IA développé et mis en œuvre par Google et Google Images, a endommagé Jewish people et Google Images users.

Système d'IA présumé impliqué: Google Images

Statistiques d'incidents

ID

1057

Nombre de rapports

2

Date de l'incident

2017-08-15

Editeurs

Sean McGregor, Khoa Lam, Daniel Atherton

Applied Taxonomies

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

4.1. Disinformation, surveillance, and influence at scale

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Malicious Actors & Misuse

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

Rapports d'incidents

Chronologie du rapport

Loading...

(JTA) — Les résultats de Google sont choquants : faites une recherche d'image pour "poussettes juives" et vous verrez des rangées de fours portables — une allusion offensante au Holocauste.

Google dit qu'il examine les résultats de recherch…

Loading...

Le mouvement antisémite est en hausse coordonné par un groupe en ligne nommé « raid ». Ils fonctionnent en manipulant les résultats du moteur de recherche d'images Google en joignant des images abusives étiquetées avec des mots-clés innocen…

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents