Incident 1034: Une vidéo manipulée par l'IA montre Donald Trump soutenant Peter Obi et critiquant Bola Tinubu.

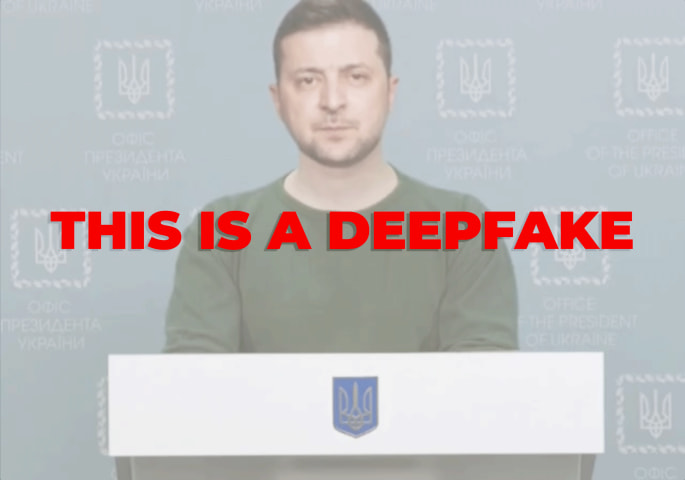

Description: Une vidéo largement diffusée représenterait faussement Donald Trump soutenant l'homme politique nigérian Peter Obi et critiquant le président Bola Tinubu. FactCheckAfrica a confirmé que la vidéo était fausse, tirée d'une interview présidentielle américaine de 2017 sur les 100 premiers jours de Trump au pouvoir. Des sons générés par l'IA et des images modifiées auraient été utilisés pour fabriquer une déclaration à connotation politique, sans rapport avec le contenu original.

Editor Notes: Timeline notes: This video was reportedly in circulation sometime in August 2024. It was included in the database on April 21, 2025.

Entités

Voir toutes les entitésAlleged: Unknown deepfake technology developers et Unknown voice cloning technology developers developed an AI system deployed by Unknown actors, which harmed Peter Obi , Media integrity , General public of Nigeria , Electoral integrity , Donald Trump et Bola Tinubu.

Systèmes d'IA présumés impliqués: Unknown voice cloning technology et Unknown deepfake technology

Statistiques d'incidents

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

4.1. Disinformation, surveillance, and influence at scale

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Malicious Actors & Misuse

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

Rapports d'incidents

Chronologie du rapport

Loading...

Allégation :

Donald Trump s'oppose à Tinubu et soutient Peter Obi.

Verdict :

Faux ! La vidéo est un deepfake et provient d'une interview présidentielle de Donald Trump en 2017, où il évoque ses 100 premiers jours au pouvoir.

Texte intégral …

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir �été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents