Incident 1013: Un homme de l'Essex condamné à cinq ans de prison pour avoir généré et partagé de la pornographie deepfake d'au moins 20 femmes et d'un mineur

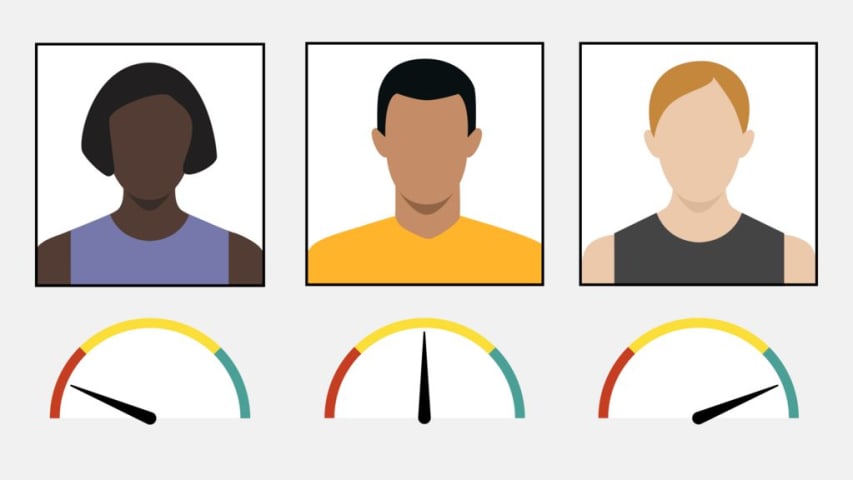

Description: Entre mars 2023 et mai 2024, Brandon Tyler, originaire de l'Essex, a utilisé l'IA pour générer des deepfakes pornographiques explicites d'au moins 20 femmes qu'il connaissait personnellement, dont une adolescente de 16 ans. Il a manipulé leurs photos sur les réseaux sociaux et les a partagées, accompagnées de leurs informations personnelles, sur des forums en ligne faisant la promotion de la violence sexuelle. Il a été condamné à cinq ans de prison en avril 2025 en vertu du droit pénal britannique pour le partage de deepfakes sexuellement explicites, à l'issue de ce qui constitue l'une des premières poursuites majeures de ce type.

Editor Notes: Notes on the timeline: Brandon Tyler's actions reportedly began sometime in March 2023 and continued until May 2024, which is when he was arrested. He was sentenced on April 4, 2025 (which is the incident date selected for this incident ID). It is also the date when reporting seemingly emerged for this incident.

Outils

Nouveau rapportNouvelle RéponseDécouvrirVoir l'historique

Le Moniteur des incidents et risques liés à l'IA de l'OCDE (AIM) collecte et classe automatiquement les incidents et risques liés à l'IA en temps réel à partir de sources d'information réputées dans le monde entier.

Entités

Voir toutes les entitésAlleged: Unknown deepfake technology developers developed an AI system deployed by Brandon Tyler, which harmed Victims of Brandon Tyler et General public.

Système d'IA présumé impliqué: Unknown deepfake technology

Statistiques d'incidents

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

4.3. Fraud, scams, and targeted manipulation

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Malicious Actors & Misuse

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

Rapports d'incidents

Chronologie du rapport

Loading...

Un cybercriminel ayant utilisé l'intelligence artificielle (IA) pour créer des images pornographiques truquées de femmes qu'il connaissait a été condamné à cinq ans de prison.

Brandon Tyler, 26 ans, a manipulé des images de réseaux sociaux …

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents