Incidente 40: Según los informes, el algoritmo COMPAS tiene un rendimiento deficiente en la predicción de la reincidencia delictiva.

Entidades

Ver todas las entidadesClasificaciones de la Taxonomía CSETv0

Detalles de la TaxonomíaProblem Nature

Unknown/unclear

Physical System

Software only

Level of Autonomy

Medium

Nature of End User

Amateur

Public Sector Deployment

Yes

Data Inputs

Questionnaire consisting of 137 factors like age, prior convictions, criminal records

Clasificaciones de la Taxonomía CSETv1

Detalles de la TaxonomíaIncident Number

40

AI Tangible Harm Level Notes

CSET considers wrongful detention, wrongful imprisonment, and wrongful differential/disproportionate imprisonment amounts to be tangible harm, because of the loss of physical freedom and autonomy.

Risk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Informes del Incidente

Cronología de Informes

← Leer la historia

En todo el país, los jueces y los oficiales de libertad condicional utilizan cada vez más algoritmos para evaluar la probabilidad de que un acusado de un delito se convierta en reincidente, un término que se usa para desc…

Fue una historia impactante. “Machine Bias”, decía el titular, y el adelanto proclamaba: “Hay software utilizado en todo el país para predecir futuros delincuentes. Y está sesgado contra los negros”.

ProPublica, una organización de noticias…

El sistema de justicia penal se está automatizando. En cada etapa, desde la vigilancia y las investigaciones hasta la fianza, las pruebas, la sentencia y la libertad condicional, los sistemas informáticos desempeñan un papel. La inteligenci…

Predecir el futuro no es solo la procedencia de los adivinos o los expertos de los medios. Los algoritmos predictivos, basados en amplios conjuntos de datos y estadísticas, han superado las operaciones mayoristas y minoristas como sabe cual…

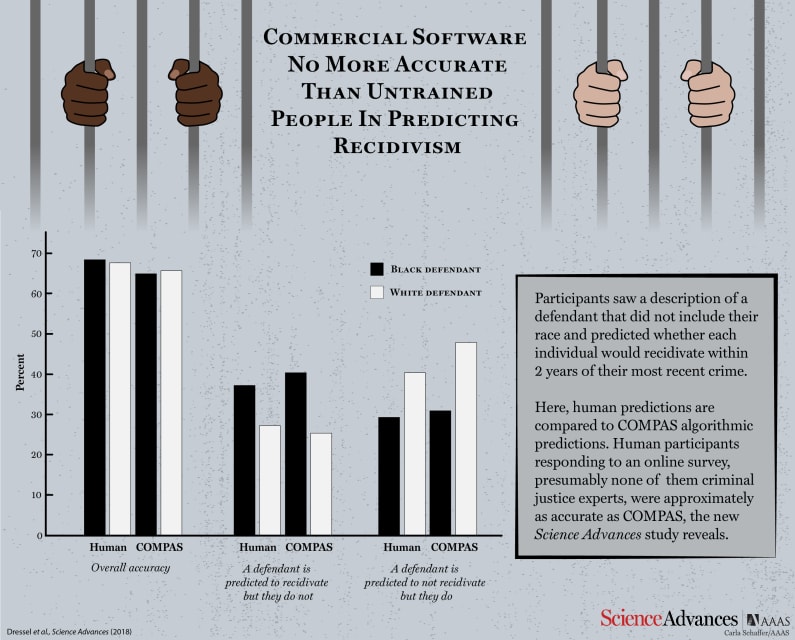

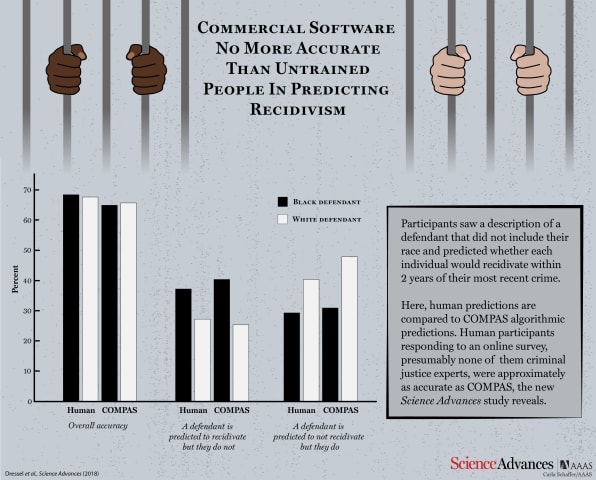

Nuestros algoritmos de predicción de delitos más sofisticados pueden no ser tan buenos como pensábamos. Un estudio publicado hoy en Science Advances analiza el popular algoritmo COMPAS, utilizado para evaluar la probabilidad de que un acusa…

De hecho, se justifica la precaución, según Julia Dressel y Hany Farid de Dartmouth College. En un nuevo estudio, demostraron que COMPAS no es mejor para predecir el riesgo de reincidencia de un individuo que los voluntarios reclutados al a…

EN AMÉRICA, las computadoras se han utilizado para ayudar en las decisiones sobre fianzas y sentencias durante muchos años. Sus defensores argumentan que la lógica rigurosa de un algoritmo, entrenado con una gran cantidad de datos, puede em…

Los algoritmos para predecir la reincidencia se utilizan comúnmente para evaluar la probabilidad de que un acusado de un delito cometa un delito. Estas predicciones se utilizan en decisiones previas al juicio, libertad condicional y sentenc…

El programa utilizado para evaluar a más de un millón de acusados en EE. UU. puede no ser lo suficientemente preciso para tomar decisiones que podrían cambiar la vida, dicen los expertos

La credibilidad de un programa de computadora utiliza…

Los algoritmos que evalúan la probabilidad de que las personas vuelvan a delinquir como parte del proceso de fijación de fianzas en casos penales son, para ser sinceros, realmente aterradores.

No sabemos mucho acerca de cómo funcionan, las …

Una herramienta de software de computadora ampliamente utilizada puede no ser más precisa o justa para predecir el comportamiento delictivo repetido que las personas sin experiencia en justicia penal, según un estudio de Dartmouth College.

…

Al igual que un chef profesional o un cirujano cardíaco, un algoritmo de aprendizaje automático es tan bueno como la capacitación que recibe. Y a medida que los algoritmos toman cada vez más las riendas y toman decisiones por los humanos, d…

Predicción de la reincidencia

La reincidencia es la probabilidad de que una persona condenada por un delito vuelva a delinquir. Actualmente, esta tasa está determinada por algoritmos predictivos. El resultado puede afectar todo, desde las d…

En un estudio publicado el miércoles, un par de investigadores de Dartmouth descubrieron que un popular algoritmo de evaluación de riesgos no era mejor para predecir la probabilidad de reincidencia de un delincuente que una encuesta en Inte…

Reciba correos electrónicos sobre los próximos programas de NOVA y contenido relacionado, así como informes destacados sobre eventos actuales a través de una lente científica. Dirección de correo electrónico Código postal Suscríbete

Un algo…

Aunque las tasas de criminalidad han disminuido constantemente desde la década de 1990, las tasas de reincidencia siguen siendo un factor tanto en las áreas de seguridad pública como en el manejo de prisioneros. El Instituto Nacional de Jus…

(Foto: Joe Raedle/Getty Images)

Docenas de personas llenaron un tribunal de Filadelfia el 6 de junio para expresar sus objeciones a un algoritmo de justicia penal propuesto. El algoritmo, desarrollado por la Comisión de Sentencias de Pensil…

Cuando Netflix se equivoca al recomendar una película, probablemente pienses que no es gran cosa. Del mismo modo, cuando tus zapatillas favoritas no aparecen en la lista de productos recomendados de Amazon, probablemente no sea el fin del m…

En un estudio de COMPAS, una herramienta algorítmica utilizada en el sistema de justicia penal de EE. UU., los investigadores de Dartmouth College, Julia Dressel y Hany Farid, descubrieron que el algoritmo no funcionaba mejor que los volunt…

DECLARACIÓN PRELIMINAR Y DECLARACIÓN DE INTERÉS La revisión independiente y contradictoria del software utilizado en el sistema legal penal es necesaria para proteger a los tribunales de evidencia poco confiable y para garantizar que la int…

La evaluación del riesgo de reincidencia es el proceso de determinar la probabilidad de que una persona acusada, condenada o encarcelada reincida. El proceso tiene por objeto coadyuvar en la determinación de la debida limitación a la libert…

Variantes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Northpointe Risk Models

Predictive Policing Biases of PredPol

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Northpointe Risk Models