Incidente 395: Amazon impuso el despliegue forzado de cámaras con inteligencia artificial en los conductores de reparto

Entidades

Ver todas las entidadesEstadísticas de incidentes

Risk Subdomain

2.1. Compromise of privacy by obtaining, leaking or correctly inferring sensitive information

Risk Domain

- Privacy & Security

Entity

Human

Timing

Post-deployment

Intent

Intentional

Informes del Incidente

Cronología de Informes

On the Clock es el informe de Motherboard sobre el movimiento laboral organizado, el trabajo por encargo, la automatización y el futuro del trabajo.

Amazon planea instalar cámaras de vigilancia dentro de los vehículos de su flota de entrega…

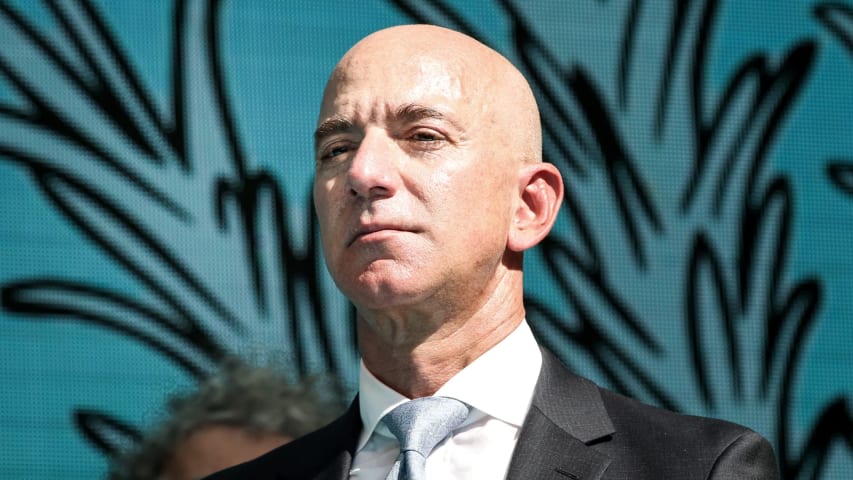

Cinco senadores están pidiendo al CEO de Amazon, Jeff Bezos, que brinde más información sobre el reciente despliegue de "cámaras de vigilancia" de la compañía en vehículos utilizados por repartidores contratados.

En [una carta](https://www.…

19 de marzo (Fundación Thomson Reuters) – Cuando Vic comenzó a entregar paquetes para Amazon en 2019, lo disfrutó: el trabajo era físico, le gustaba la autonomía y le permitía explorar nuevos vecindarios en Denver, Colorado.

Pero a Vic, que…

On the Clock es el informe de Motherboard sobre el movimiento laboral organizado, el trabajo por encargo, la automatización y el futuro del trabajo.

Los conductores de entrega de Amazon en todo el país deben firmar un formulario de "consent…

Variantes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents